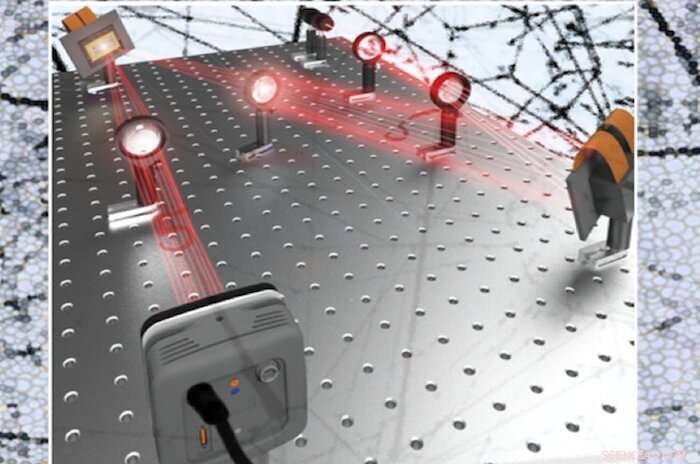

Ett massivt parallellt amplitud-enbart Fourier-neuralt nätverk. Kredit:George Washington University

Forskare vid George Washington University, tillsammans med forskare vid University of California, Los Angeles, och den djupteknologiska venture-startupen Optelligence LLC, har utvecklat en optisk konvolutionell neural nätverksaccelerator som kan bearbeta stora mängder information, i storleksordningen petabyte, per sekund. Denna innovation, som utnyttjar ljusets massiva parallellitet, förebådar en ny era av optisk signalbehandling för maskininlärning med många applikationer, inklusive i självkörande bilar, 5G-nätverk, datacenter, biomedicinsk diagnostik, datasäkerhet med mera.

Den globala efterfrågan på maskinvara för maskininlärning överskrider dramatiskt nuvarande datorströmförsörjning. Toppmodern elektronisk hårdvara, såsom grafikbehandlingsenheter och tensorprocessoracceleratorer, hjälpa till att mildra detta, men utmanas i sig av seriell databehandling som kräver iterativ databehandling och stöter på förseningar från ledningar och kretsbegränsningar. Optiska alternativ till elektronisk hårdvara kan hjälpa till att påskynda maskininlärningsprocesser genom att förenkla hur information bearbetas på ett icke-iterativt sätt. Dock, fotonikbaserad maskininlärning är vanligtvis begränsad av antalet komponenter som kan placeras på fotoniska integrerade kretsar, begränsa sammankopplingen, medan spatiala ljusmodulatorer för ledigt utrymme är begränsade till låga programmeringshastigheter.

För att uppnå ett genombrott i detta optiska maskininlärningssystem, forskarna ersatte rumsliga ljusmodulatorer med digital spegelbaserad teknologi, därmed utveckla ett system över 100 gånger snabbare. Den icke-iterativa timingen för denna processor, i kombination med snabb programmerbarhet och massiv parallellisering, gör det möjligt för detta optiska maskininlärningssystem att överträffa även de förstklassiga grafikbehandlingsenheterna med över en storleksordning, med utrymme för ytterligare optimering utöver den ursprungliga prototypen.

Till skillnad från det nuvarande paradigmet inom elektronisk maskininlärningshårdvara som bearbetar information sekventiellt, denna processor använder Fourier-optik, ett koncept med frekvensfiltrering som gör det möjligt att utföra de erforderliga faltningarna av det neurala nätverket som mycket enklare elementvisa multiplikationer med den digitala spegeltekniken.

"Denna massivt parallella amplitud-endast Fourier optiska processor förebådar en ny era för informationsbearbetning och maskininlärning. Vi visar att träning av detta neurala nätverk kan förklara bristen på fasinformation, säger Volker Sorger, docent i el- och datateknik vid George Washington University.

"Optik möjliggör bearbetning av storskaliga matriser i ett enda tidssteg, vilket möjliggör nya skalningsvektorer för att utföra faltningar optiskt. Detta kan ha betydande potential för maskininlärningstillämpningar som visas här, " säger Puneet Gupta, professor och vice ordförande i datateknik vid University of California, Los Angeles.

"Denna prototypdemonstration visar en kommersiell väg för optiska acceleratorer redo för ett antal applikationer som nätverkskantsbehandling, datacenter och högpresterande datorsystem, " säger Hamed Dalir, medgrundare, Optelligence LLC.

Pappret, "Massively Parallel Amplitude-Only Fourier Neural Network" publicerades idag i tidskriften Optica .