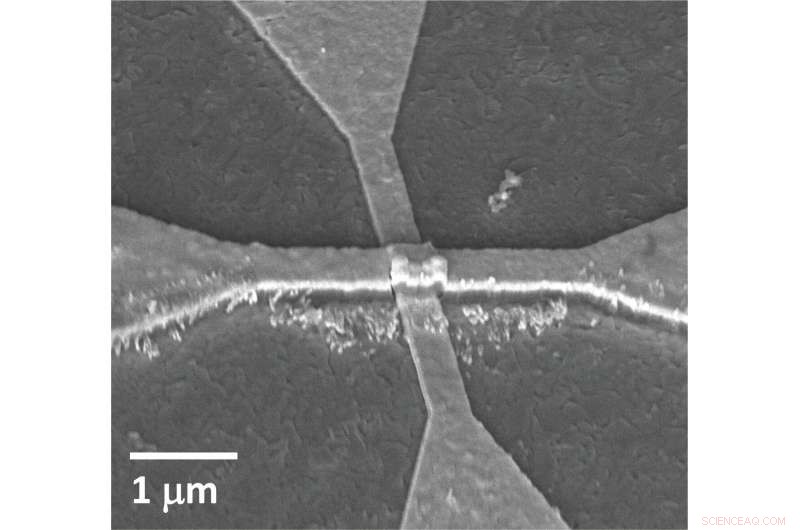

SEM-bild av den artificiella neuronanordningen. Kredit:Sangheon Oh/Nature Nanotechnology

Att träna neurala nätverk för att utföra uppgifter, som att känna igen bilder eller navigera i självkörande bilar, kan en dag kräva mindre datorkraft och hårdvara tack vare en ny artificiell neuronenhet utvecklad av forskare vid University of California San Diego. Enheten kan köra neurala nätverksberäkningar med 100 till 1000 gånger mindre energi och yta än befintlig CMOS-baserad hårdvara.

Forskare rapporterar sitt arbete i en artikel publicerad 18 mars Naturens nanoteknik .

Neurala nätverk är en serie sammankopplade lager av artificiella neuroner, där utdata från ett lager ger input till nästa. Att generera den inmatningen görs genom att tillämpa en matematisk beräkning som kallas en icke-linjär aktiveringsfunktion. Detta är en kritisk del av att driva ett neuralt nätverk. Men att tillämpa den här funktionen kräver mycket datorkraft och kretsar eftersom det innebär överföring av data fram och tillbaka mellan två separata enheter – minnet och en extern processor.

Nu, UC San Diego-forskare har utvecklat en nanometerstor enhet som effektivt kan utföra aktiveringsfunktionen.

"Neurala nätverksberäkningar i hårdvara blir allt mer ineffektiva när de neurala nätverksmodellerna blir större och mer komplexa, " sa Duygu Kuzum, en professor i el- och datorteknik vid UC San Diego Jacobs School of Engineering. "Vi utvecklade en enda nanoskala artificiell neuronenhet som implementerar dessa beräkningar i hårdvara på ett mycket områdes- och energieffektivt sätt."

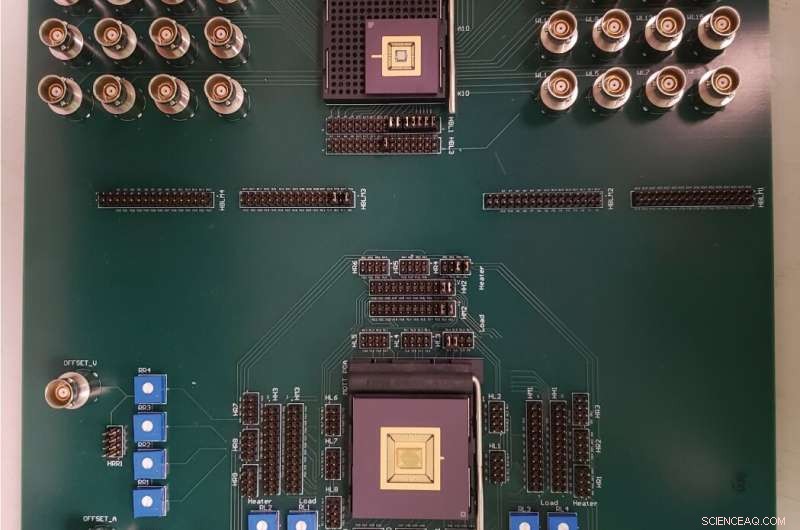

Ett anpassat kretskort byggt med en rad aktiverings- (eller neuron-) enheter och en synaptisk enhetsuppsättning. Kredit:Sangheon Oh/Nature Nanotechnology

Den nya studien, ledd av Kuzum och hennes Ph.D. student Sangheon Åh, utfördes i samarbete med ett DOE Energy Frontier Research Center ledd av UC San Diego fysikprofessor Ivan Schuller, som fokuserar på att utveckla hårdvaruimplementationer av energieffektiva artificiella neurala nätverk.

Enheten implementerar en av de mest använda aktiveringsfunktionerna i neurala nätverksträning som kallas en likriktad linjär enhet. Det som är speciellt med den här funktionen är att den behöver hårdvara som kan genomgå en gradvis förändring i motståndet för att fungera. Och det är precis vad UC San Diego-forskarna konstruerade sin enhet för att göra – den kan gradvis byta från ett isolerande till ett ledande tillstånd, och det gör den med hjälp av lite värme.

Denna switch är vad som kallas en Mott-övergång. Det sker i ett nanometertunt lager av vanadindioxid. Ovanför detta lager finns en nanotrådsvärmare gjord av titan och guld. När ström flyter genom nanotråden, vanadindioxidskiktet värms långsamt upp, orsakar en långsam, kontrollerad växling från isolerande till ledande.

"Denna enhetsarkitektur är mycket intressant och innovativ, " sa Åh, vem är studiens första författare. Vanligtvis, material i en Mott-övergång upplever en abrupt övergång från isolerande till ledande eftersom strömmen flyter direkt genom materialet, han förklarade. "I detta fall, vi flyter ström genom en nanotråd ovanpå materialet för att värma det och inducera en mycket gradvis resistansförändring."

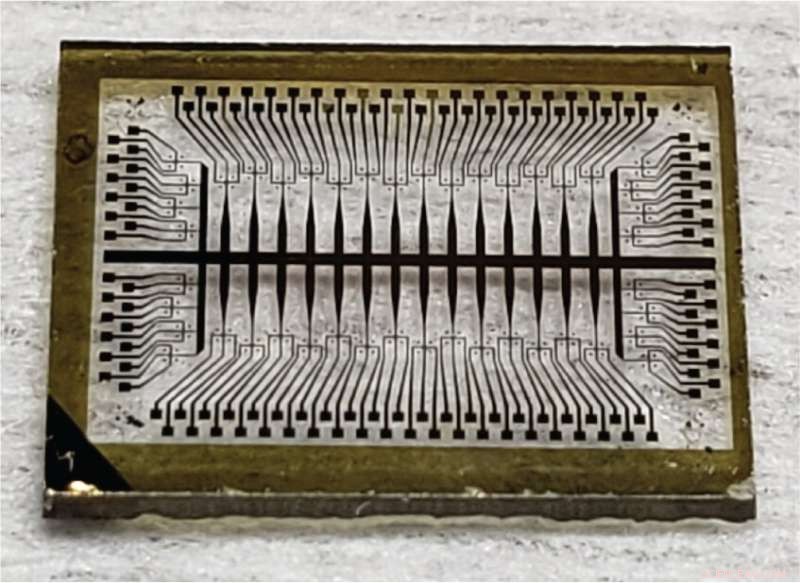

En uppsättning av aktiverings (eller neuron) enheter. Kredit:Sangheon Oh/Nature Nanotechnology

För att implementera enheten, forskarna tillverkade först en uppsättning av dessa så kallade aktiveringsanordningar (eller neuron), tillsammans med en synaptisk enhetsuppsättning. Sedan integrerade de de två arrayerna på ett anpassat kretskort och kopplade ihop dem för att skapa en hårdvaruversion av ett neuralt nätverk.

Forskarna använde nätverket för att bearbeta en bild - i det här fallet, en bild av Geisel Library vid UC San Diego. Nätverket utförde en typ av bildbehandling som kallas kantdetektering, som identifierar konturerna eller kanterna på objekt i en bild. Detta experiment visade att det integrerade hårdvarusystemet kan utföra faltningsoperationer som är väsentliga för många typer av djupa neurala nätverk.

Forskarna säger att tekniken kan skalas upp ytterligare för att göra mer komplexa uppgifter som ansikts- och objektigenkänning i självkörande bilar. Med intresse och samarbete från industrin, detta kan hända, noterade Kuzum.

"Just nu, detta är ett bevis på konceptet, " Kuzum sa. "Det är ett litet system där vi bara staplade ett synapslager med ett aktiveringslager. Genom att stapla fler av dessa tillsammans, du kan göra ett mer komplext system för olika applikationer."