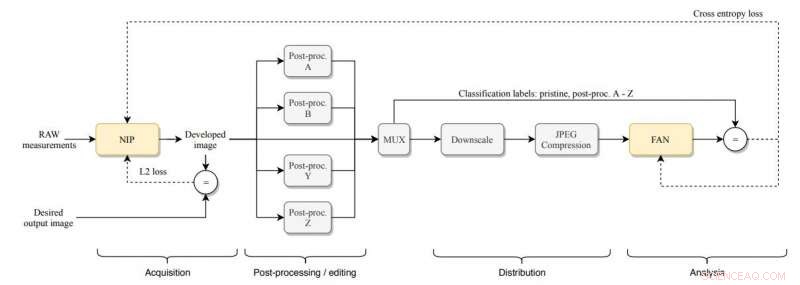

Optimering av bildanskaffnings- och distributionskanalen för att underlätta analys av fotohärkomst. Neural imaging pipeline (NIP) är tränad att framkalla bilder som både liknar de önskade målbilderna, men också behålla meningsfulla kriminaltekniska ledtrådar i slutet av komplexa distributionskanaler. Kredit:arXiv:1902.10707 [cs.CV] https://arxiv.org/abs/1902.10707

Vi ser fotoförfalskningens fantasifulla bedrifter; nu måste vi ta reda på vad vi ska göra åt dem. Att kunna skilja falskt från verkligt är målet, men hur tar man sig dit? Forensics är nyckelverktyget för att leta efter falska foton och det verkar inte vara en lätt uppgift att få det verktyget att fungera bra.

"En av de svåraste sakerna med att upptäcka manipulerade bilder, eller 'deepfakes', ' är att digitala fotofiler inte är kodade för att vara manipuleringssäkra, sa Lily Hay Newman in Trådbunden .

Vad har experterna åstadkommit, sedan? Rättsmedicinska analytiker kom på hur man upptäcker några digitala egenskaper för att upptäcka inblandning, "men dessa indikatorer ger inte alltid en tillförlitlig bild, " Hon sa.

Och även dessa ledtrådar kanske inte hjälper, som "många vanliga typer av efterbearbetning, som filkomprimering för att ladda upp och dela foton online, ta bort dessa ledtrådar ändå."

Men håll ut. Ett par forskare från Tandon School of Engineering vid New York University hade en vad-om-en manipuleringssäker tätning från själva kameran.

Deras papper som diskuterar denna idé finns uppe på arXiv, och den heter, "Rörledningar för neural avbildning – kriminalteknikens gissel eller hopp?" Författarna är Pawel Korus och Nasir Memon.

"Vi visar att ett neuralt nätverk kan tränas för att ersätta hela fotoframkallningspipelinen, och gemensamt optimerad för högfientlig fotorendering och pålitlig härkomstanalys. En sådan optimerad neural avbildningspipeline gjorde det möjligt för oss att öka detekteringsnoggrannheten för bildmanipulation från ca. 45 % till över 90 %. Nätverket lär sig att introducera noggrant utformade artefakter, liknande digitala vattenstämplar, som underlättar efterföljande manipulationsdetektering. Analys av prestationsavvägningar indikerar att de flesta av vinsterna kan erhållas med endast mindre snedvridning."

Trådbunden förklarade vad författarna föreslog:att träna ett neuralt nätverk för att driva fotoframkallningsprocessen som äger rum inuti kamerorna. "Sensorerna tolkar ljuset som träffar linsen och förvandlar det till en högkvalitativ bild, det neurala nätverket är också tränat att markera filen med outplånliga indikatorer som kan kontrolleras senare, om det behövs, av rättsmedicinska analytiker, " skrev Newman.

Hon citerade forskaren Nasir Memon som kommenterade att kolla efter förfalskningar på detta sätt. Han sa att "man måste gå nära källan där bilden är tagad."

Han sa vidare att i detta arbete "skapar vi en bild som är kriminalteknisk vänlig, vilket kommer att möjliggöra bättre kriminalteknisk analys än en vanlig bild. Det är ett proaktivt tillvägagångssätt snarare än att bara skapa bilder för deras visuella kvalitet och sedan hoppas att kriminaltekniska tekniker fungerar i efterhand."

Melanie Ehrenkranz i Gizmodo klargjorde också vad forskarna försökte åstadkomma, för att nå framgång inom kriminalteknik med hjälp av maskininlärning för kriminaltekniska ändamål, och baka in en detekteringsmetod rakt in i kameran.

Ehrencranz:"De beskriver en metod där ett neuralt nätverk ersätter fotoframkallningsprocessen så att den ursprungliga bilden som tas markeras med något som en digital vattenstämpel för att indikera bildens härkomst i en digital kriminalteknisk analys. Med andra ord, processen identifierar ett fotos ursprung och om det har manipulerats sedan dess ursprungliga tillstånd."

Nyhetsmeddelandet från NYU Tandon School of Engineering hade en särskilt bra sammanfattning av vad dessa forskare har uppnått. Deras tillvägagångssätt "ersätter den typiska fotoframkallningspipelinen med ett neuralt nätverk - en form av AI - som introducerar noggrant utformade artefakter direkt i bilden i ögonblicket för bildanskaffning. Dessa artefakter, liknande "digitala vattenstämplar", "är extremt känsliga för manipulation."

"Till skillnad från tidigare använda vattenmärkningstekniker, dessa AI-lärda artefakter kan avslöja inte bara förekomsten av fotomanipulationer, men också deras karaktär, sa Korus.

Processen är optimerad för inbäddning i kameran och kan överleva bildförvrängning som appliceras av fotodelningstjänster online.

Diskussionen har handlat om rättsmedicinsk vattenmärkning på bilder. Hur är det med video? Trådbunden sa att videon var något som forskarna sa att de inte tog upp ännu, men att det skulle vara teoretiskt möjligt.

"Vi anser att det är absolut nödvändigt att överväga nya möjligheter för säkerhetsorienterad design av kameror och multimediaspridningskanaler som kommer med införandet av neurala bildbehandlingsprocessorer."

Faktiskt, deras verktygslåda för neural avbildning finns på GitHub. Den beskrivs som en "Python-verktygslåda för optimering av neurala bildrörledningar för detektering av fotomanipulation."

NYU Tandon-utgåvan gjorde poängen att under de kommande åren, "AI-drivna processer kommer sannolikt att helt ersätta de traditionella digitala bildbehandlingspipelines." Memon sa att när denna övergång äger rum, "vi har möjlighet att dramatiskt förändra kapaciteten hos nästa generations enheter när det kommer till bildintegritet och autentisering. Imaging pipelines som är optimerade för kriminalteknik kan hjälpa till att återställa ett element av förtroende i områden där gränsen mellan äkta och falsk kan vara svår att dra med tillförsikt."

© 2019 Science X Network