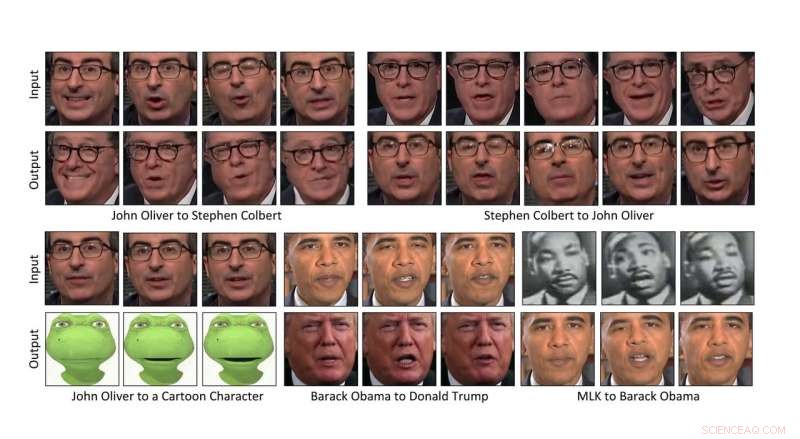

Forskare vid Carnegie Mellon University har utarbetat ett sätt att automatiskt omvandla innehållet i en video till en annans stil, gör det möjligt att överföra en persons ansiktsuttryck till en annan persons video, eller till och med en seriefigur. Kredit:Carnegie Mellon University

Forskare vid Carnegie Mellon University har utarbetat ett sätt att automatiskt omvandla innehållet i en video till en annans stil, vilket gör det möjligt att överföra ansiktsuttrycken av komikern John Oliver till de av en seriefigur, eller att få en påsklilja att blomma på ungefär samma sätt som en hibiskus skulle.

Eftersom den datadrivna metoden inte kräver mänskligt ingripande, det kan snabbt omvandla stora mängder video, vilket gör det till en välsignelse för filmproduktion. Den kan också användas för att konvertera svartvita filmer till färg och för att skapa innehåll för virtuell verklighetsupplevelser.

"Jag tror att det finns många historier att berätta, sa Aayush Bansal, en doktorsexamen student i CMU:s Robotics Institute. Filmproduktion var hans främsta motivation för att hjälpa till att utforma metoden, han förklarade, gör att filmer kan produceras snabbare och billigare. "Det är ett verktyg för konstnären som ger dem en första modell som de sedan kan förbättra, " han lade till.

Tekniken har också potential att användas för så kallade "djupa förfalskningar, " videor där en persons bild infogas utan tillstånd, få det att verka som om personen har gjort eller sagt saker som är ur karaktär, Bansal erkände.

"Det var en ögonöppnare för oss alla i fältet att sådana förfalskningar skulle skapas och ha en sådan inverkan, ", sa han. "Att hitta sätt att upptäcka dem kommer att vara viktigt framåt."

Bansal kommer att presentera metoden idag på ECCV 2018, Europeiska konferensen om datorsyn, i München. Hans medförfattare inkluderar Deva Ramanan, CMU docent i robotik.

Att överföra innehåll från en video till en annans stil bygger på artificiell intelligens. Särskilt, en klass av algoritmer som kallas generative adversarial networks (GAN) har gjort det lättare för datorer att förstå hur man tillämpar stilen för en bild på en annan, särskilt när de inte har matchats noggrant.

I en GAN, två modeller skapas:en diskriminator som lär sig att upptäcka vad som överensstämmer med stilen på en bild eller video, och en generator som lär sig hur man skapar bilder eller videor som matchar en viss stil. När de två arbetar konkurrenskraftigt - generatorn som försöker lura diskriminatorn och diskriminatorn som gör generatorns effektivitet - lär sig systemet så småningom hur innehåll kan omvandlas till en viss stil.

En variant, kallas cykel-GAN, avslutar slingan, ungefär som att översätta engelska tal till spanska och sedan spanska tillbaka till engelska och sedan utvärdera om det två gånger översatta talet fortfarande är vettigt. Att använda cycle-GAN för att analysera bilders rumsliga egenskaper har visat sig vara effektivt för att omvandla en bild till en annans stil.

Den rumsliga metoden lämnar fortfarande något övrigt att önska för video, med oönskade artefakter och brister som dyker upp i hela cykeln av översättningar. För att mildra problemet, forskarna utvecklade en teknik, kallas Recycle-GAN, som inte bara innefattar rumslig, men tidsinformation. Denna ytterligare information, ta hänsyn till förändringar över tid, begränsar processen ytterligare och ger bättre resultat.

Forskarna visade att Recycle-GAN kan användas för att omvandla video av Oliver till vad som verkar vara komikern Stephen Colbert och tillbaka till Oliver. Eller video av John Olivers ansikte kan förvandlas till en seriefigur. Recycle-GAN tillåter inte bara ansiktsuttryck att kopieras, men också föreställningens rörelser och kadens.

Effekterna är inte begränsade till ansikten, eller till och med kroppar. Forskarna visade att video av en blommande blomma kan användas för att manipulera bilden av andra typer av blommor. Eller moln som snabbt korsar himlen en blåsig dag kan bromsas för att ge intrycket av lugnare väder.

Sådana effekter kan vara användbara för att utveckla självkörande bilar som kan navigera på natten eller i dåligt väder, sa Bansal. Det kan vara svårt att få tag på video av nattscener eller stormigt väder där föremål kan identifieras och märkas, han förklarade. Recycle-GAN, å andra sidan, kan förvandla lätt erhållna och märkta dagtidsscener till nattliga eller stormiga scener, tillhandahåller bilder som kan användas för att träna bilar att köra under dessa förhållanden.