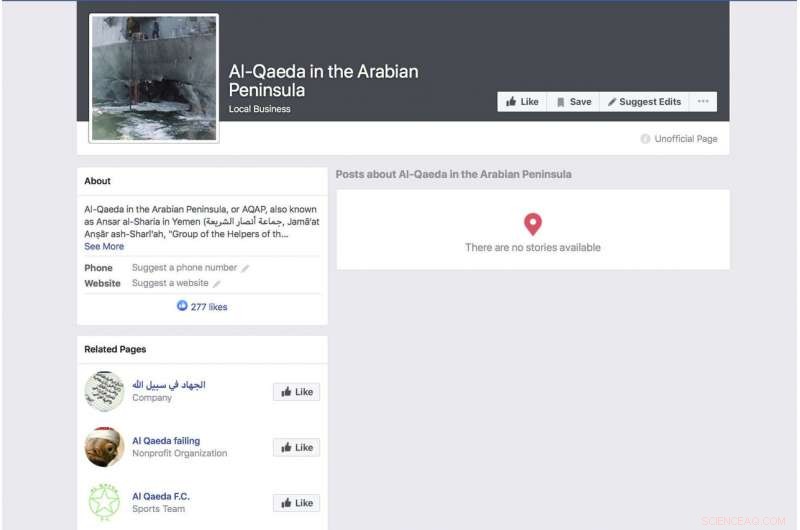

En automatiskt genererad Facebook-sida för en grupp som identifierar sig som terrorgruppen "Al-Qaida på den arabiska halvön" visar ett foto av det bombade amerikanska flottans krigsfartyg USS Cole. Sidan var fortfarande aktiv från och med tisdagen, 7 maj, 2019, när skärmgreppet gjordes. Facebook säger att de har robusta system på plats för att ta bort innehåll från extremistgrupper, men en förseglad whistleblower-klagomål som granskats av AP säger att förbjudet innehåll finns kvar på webben och lätt att hitta. (Facebook via AP)

Frågan dyker upp om och om igen, med extremistiskt material, hattal, valinblandning och integritetsintrång. Varför kan inte Facebook bara fixa det?

Det är komplicerat, med anledningar som inkluderar Facebooks storlek, dess affärsmodell och tekniska begränsningar, för att inte tala om år av okontrollerad tillväxt. Åh, och elementet i den mänskliga naturen.

Det senaste avslöjandet:Facebook skapar oavsiktligt firande videor med extremistiskt innehåll och autogenererar affärssidor för sådana som ISIS och Al Qaida. Företaget säger att man arbetar med lösningar och att problemen blir bättre. Det är sant, men kritiker säger att bättre inte är tillräckligt bra när masskjutningar livestreamas och onlinemobber sprider rykten som leder till dödligt våld.

"De har varit frustrerande långsamma med att hantera allt från sexuella övergrepp mot barn till terrorism, vit överlägsenhet, mobbning, porr utan samtycke" och saker som att tillåta annonsörer att rikta in sig på kategorier som "judhatare, " helt enkelt för att vissa användare hade listat termen som ett "intresse, sa Hany Farid, en digital forensicsexpert vid University of California, Berkeley.

När nya problem dyker upp, Facebooks formel har varit att be om ursäkt och lova att göra ändringar, ibland också noterade att den inte förutsåg hur illvilliga aktörer så lätt kunde missbruka dess plattform. På senare tid, företaget har också betonat hur mycket det förbättras, både tekniskt i sin användning av artificiell intelligens för att upptäcka problem och i termer av att fokusera mer pengar och ansträngning på att åtgärda dem.

En banner med texten "Den islamiska staten" visas på Facebook-sidan för en användare som identifierar sig som Nawan Al-Farancsa. Sidan var fortfarande live på tisdag, 7 maj, 2019, när skärmgreppet gjordes. Facebook säger att de har robusta system på plats för att ta bort innehåll från extremistgrupper, men en förseglad whistleblower-klagomål som granskats av AP säger att förbjudet innehåll finns kvar på webben och är lätt att hitta. (Facebook via AP)

"Efter att ha gjort stora investeringar, vi upptäcker och tar bort terrorisminnehåll med en mycket högre framgångsfrekvens än till och med två år går, " Facebook sa i onsdags som svar på avslöjandena om de automatiskt genererade sidorna. "Vi gör inte anspråk på att hitta allt, och vi förblir vaksamma i våra ansträngningar mot terroristgrupper runt om i världen."

Det har sett en viss framgång. I slutet av 2016 VD Mark Zuckerberg avfärdade ökänt som "ganska galen" idén att falska nyheter på hans tjänst kunde ha påverkat valet. Senare backade han, och sedan dess har företaget minskat mängden felaktig information som delas på sin tjänst, mätt av flera oberoende studier.

Zuckerberg har också, i stort sett, undvek liknande misstag genom att medge misstag och be om ursäkter till allmänheten och till lagstiftare.

Men även när företaget löser ett problem, andra dyker upp. Anledningen till det kan vara inbakad i dess DNA. Och det beror inte bara på att dess affärsmodell är beroende av att så många människor som möjligt använder den så mycket som möjligt, lämnar efter sig personliga uppgifter som sedan kan riktas mot av annonsörer.

I denna torsdag, 29 mars, 2018, fil foto, logotypen för Facebook visas på skärmarna på Nasdaq MarketSite, på New Yorks Times Square. Frågan dyker upp om och om igen, med extremistiskt material, hattal, valinblandning, integritetsintrång, bostadsdiskriminering. Varför kan inte Facebook bara fixa det? (AP Photo/Richard Drew, Fil)

I denna 11 april, 2018, fil foto, Facebooks vd Mark Zuckerberg vittnar inför en utfrågning av House Energy and Commerce på Capitol Hill i Washington. Facebook ger intrycket att det stoppar de allra flesta extremistiska inlägg innan användarna någonsin ser dem. Men ett konfidentiellt whistleblower-klagomål till Securities and Exchange Commission som erhållits av Associated Press hävdar att företaget för sociala medier har överdrivit sin framgång. (AP Photo/Andrew Harnik, Fil)

"Nästan allt som Facebook har designat har designats för bra människor. Människor som är trevliga mot varandra, som har födelsedagar att fira, som har nya valpar och i allmänhet gillar att behandla andra väl, " sa Siva Vaidhyanathan, chef för Center for Media and Citizenship vid University of Virginia. "Facebook är i grund och botten gjord för en bättre art än vår. Om den vore gjord för golden retrievers, allt skulle vara bra."

Men om bara 1 % av de 2,4 miljarderna på Facebook vill göra hemska saker mot andra, det är 24 miljoner människor.

"Varannan vecka, vi hör om Facebook som slår ner besvärliga sidor, ge löften om att anställa fler, bygga AI och så vidare, " sa Vaidhyanathan. "Men i Facebooks skala, inget av det spelar någon roll. Vi har i princip fastnat med allt det här skräpet."

Chris Hughes, en medgrundare av Facebook, efterlyste en upplösning av sociala mediejätten i en torsdagsuppsats. Vaidhyanathan tror också att stark statlig reglering kan vara svaret, till exempel lagar som "begränsar företags möjlighet att suga upp all vår data och använda den för att rikta annonsering."

"Vi borde verkligen ta itu med baksidan av Facebook, sa han. Det är det du måste attackera.

© 2019 Associated Press. Alla rättigheter förbehållna.