| Experimentell uppställning och tidsvikt bildöversikt. Kreditera: Nature Photonics (2018). DOI:10.1038/s41566-018-0234-0

MIT -forskare har utvecklat ny fotograferingsoptik som tar bilder baserat på tidpunkten för reflekterande ljus inuti optiken, istället för det traditionella tillvägagångssättet som bygger på arrangemanget av optiska komponenter. Dessa nya principer, forskarna säger, öppna dörrar till nya funktioner för tids- eller djupkänsliga kameror, som inte är möjliga med konventionell fotograferingsoptik.

Specifikt, forskarna designade ny optik för en ultrasnabb sensor som kallas streak-kamera som löser bilder från ultrakorta ljuspulser. Streak-kameror och andra supersnabba kameror har använts för att göra en biljard-bild-per-sekund-video, skanna igenom stängda böcker, och ge djupkarta över en 3D-scen, bland andra applikationer. Sådana kameror har förlitat sig på konventionell optik, som har olika designbegränsningar. Till exempel, ett objektiv med en given brännvidd, mätt i millimeter eller centimeter, måste sitta på ett avstånd från en bildsensor som är lika med eller större än den brännvidden för att fånga en bild. Detta betyder i princip att linserna måste vara väldigt långa.

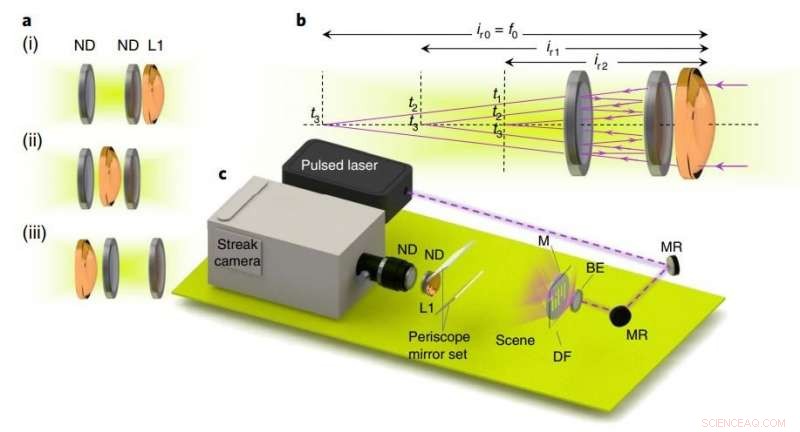

I en tidning publicerad i veckans Nature Photonics , MIT Media Labs forskare beskriver en teknik som får en ljussignal att reflektera fram och tillbaka från noggrant placerade speglar inuti linssystemet. En snabb bildsensor tar en separat bild vid varje reflektionstid. Resultatet är en bildsekvens - var och en motsvarar en annan tidpunkt, och till ett annat avstånd från linsen. Varje bild kan nås vid sin specifika tidpunkt. Forskarna har myntat denna teknik "tidsvikt optik".

"När du har en snabb sensorkamera, för att lösa ljus som passerar genom optik, du kan byta tid med utrymme, "säger Barmak Heshmat, första författaren på tidningen. "Det är kärnkonceptet med tidsvikning ... Du tittar på optiken vid rätt tidpunkt, och den tiden är lika med att titta på den på rätt avstånd. Du kan sedan ordna optik på nya sätt som har funktioner som inte var möjliga tidigare. "

I deras studie, forskarna visar tre användningsområden för tidsviktad optik för ultrasnabba kameror och andra djupkänsliga bildanordningar. Dessa kameror, även kallade "time-of-flight"-kameror, mäta den tid det tar för en ljuspuls att reflektera från en scen och återgå till en sensor, för att uppskatta djupet av 3D-scenen.

Den nya optikarkitekturen innehåller en uppsättning semireflekterande parallella speglar som minskar, eller "vik, "brännvidden varje gång ljuset reflekterar mellan speglarna. Genom att placera uppsättningen speglar mellan linsen och sensorn, forskarna kondenserade avståndet mellan optikarrangemang med en storleksordning medan de fortfarande tog en bild av scenen.

Medförfattare till tidningen är Matthew Tancik, en doktorand i MIT Computer Science and Artificial Intelligence Laboratory; Guy Satat, en Ph.D. student i kamerakulturgruppen på Media Lab; och Ramesh Raskar, en docent i mediekonst och vetenskap och chef för Camera Culture Group.

Vik den optiska vägen i tid

Forskarnas system består av en komponent som projicerar en femtosekund (kvadrilliondel av en sekund) laserpuls in i en scen för att belysa målobjekt. Traditionell fotograferingsoptik ändrar ljussignalens form när den färdas genom de böjda glasögonen. Denna formändring skapar en bild på sensorn.

Men, med forskarnas optik, istället för att gå rätt till sensorn, signalen studsar först fram och tillbaka mellan speglar som är exakt anordnade för att fånga och reflektera ljus. Var och en av dessa reflektioner kallas en "rundresa". Vid varje rundresa, en del ljus fångas upp av sensorn som är programmerad att avbilda vid ett visst tidsintervall, t.ex. en ögonblicksbild på 1 nanosekund var 30:e nanosekund.

En viktig innovation är att varje rundresa av ljus flyttar brännpunkten – där en sensor är placerad för att ta en bild – närmare linsen. Detta gör att linsen kan kondenseras drastiskt. Säg att en radkamera vill ta en bild med den långa brännvidden för ett traditionellt objektiv. Med tidsvikt optik, den första rundresan drar fokuspunkten ungefär dubbelt så lång som spegeluppsättningen närmare linsen, och varje efterföljande rundresa för brännpunkten närmare och närmare fortfarande. Beroende på antalet rundresor, en sensor kan sedan placeras mycket nära linsen.

Genom att placera sensorn på en exakt brännpunkt, bestäms av totala rundresor, kameran kan ta en skarp slutlig bild, liksom olika stadier av ljussignalen, var och en kodad vid en annan tid, när signalen ändrar form för att producera bilden. (De första bilderna blir suddiga, men efter flera rundor kommer målobjektet att hamna i fokus.)

I deras tidning, forskarna visar detta genom att avbilda en femtosekund ljuspuls genom en mask graverad med "MIT, " ställ in 53 centimeter från objektivets bländare. För att ta bilden, den traditionella 20 centimeter brännviddslinsen måste sitta cirka 32 centimeter från sensorn. Den tidsviktade optiken, dock, tog bilden i fokus efter fem rundresor, med endast 3,1 centimeter objektivsensoravstånd.

Detta kan vara användbart, Heshmat säger, för att designa mer kompakta teleskoplinser som fångar, säga, ultrasnabba signaler från rymden, eller för att designa mindre och lättare linser för satelliter för att avbilda markytan.

Multizoom och flerfärgad

Forskarna avbildade sedan två mönster med ett avstånd på cirka 50 centimeter från varandra, men varje inom räckhåll för kameran. Ett "X" -mönster var 55 centimeter från linsen, och ett "II" -mönster var 4 centimeter från linsen. Genom att justera om optiken – delvis, genom att placera linsen mellan de två speglarna – de formade ljuset på ett sätt att varje tur och retur skapade en ny förstoring i en enda bildinsamling. På det sättet, det är som om kameran zoomar in vid varje tur och retur. När de sköt lasern in i scenen, resultatet blev två separata, fokuserade bilder, skapat i ett skott - X-mönstret som fångades på den första rundresan, och II -mönstret fångat på den andra rundresan.

Forskarna demonstrerade sedan en ultrasnabb multispektral (eller flerfärgad) kamera. De designade två färgreflekterande speglar och en bredbandsspegel – en inställd för att reflektera en färg, ställ dig närmare linsen, och en inställd för att återspegla en andra färg, placeras längre bak från linsen. De avbildade en mask med "A" och "B, "med A belyste den andra färgen och B belyste den första färgen, båda för några tiondelar av en picosekund.

När ljuset gick in i kameran, våglängder för den första färgen reflekteras omedelbart fram och tillbaka i den första kaviteten, och klockan klockades av sensorn. Våglängder för den andra färgen, dock, passerade genom det första hålrummet, in i det andra, något försenar sin tid till sensorn. Eftersom forskarna visste vilken våglängd som skulle träffa sensorn vid vilken tidpunkt, de överlagrade sedan respektive färger på bilden - den första våglängden var den första färgen, och den andra var den andra färgen. Detta kan användas i djupavkännande kameror, som för närvarande bara spelar in infrarött, Säger Heshmat.

En nyckelfunktion i tidningen, Heshmat säger, är det öppnar dörrar för många olika optikdesigner genom att justera kavitetsavståndet, eller genom att använda olika typer av håligheter, sensorer, och linser. "Kärnbudskapet är att när du har en kamera som är snabb, eller har en djupgivare, du behöver inte designa optik som du gjorde för gamla kameror. Du kan göra mycket mer med optiken genom att titta på dem vid rätt tidpunkt, "Säger Heshmat.