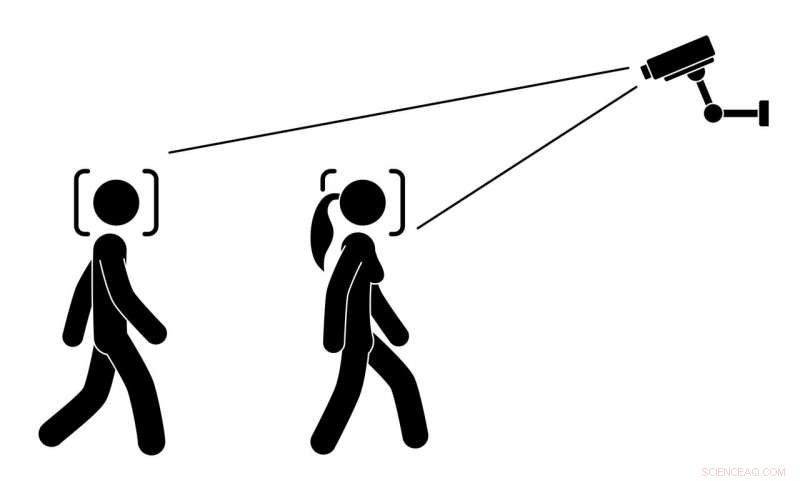

Ska en algoritm försöka gissa vilket kön människor är efter hur de ser ut? Upphovsman:all_is_magic/Shutterstock.com

Tänk dig att gå ner på gatan och se reklamskärmar ändra sitt innehåll baserat på hur du går, hur du pratar, eller till och med bröstets form. Dessa skärmar är beroende av dolda kameror, mikrofoner och datorer för att gissa om du är man eller kvinna. Det här kan låta futuristiskt, men kunder i en norsk pizzeria upptäckte att det var precis vad som hände:Kvinnor såg annonser för sallad och män såg annonser för köttalternativ. Programvaran som kör en digital reklambräda spillde bönorna när den kraschade och visade sin underliggande kod. Motiveringen bakom att använda denna teknik kan ha varit att förbättra reklamkvaliteten eller användarupplevelsen. Ändå, många kunder blev obehagligt överraskade av det.

Den här situationen är inte bara läskig och invasiv. Det är värre:Ansträngningar för automatiskt könsigenkänning - att använda algoritmer för att gissa en persons kön baserat på bilder, video eller ljud - väcka betydande sociala och etiska problem som ännu inte är helt utforskade. Mest aktuell forskning om automatisk teknik för genusigenkänning fokuserar istället på tekniska detaljer.

Vår senaste forskning visade att människor med olika könsidentiteter, inklusive de som identifierar sig som transpersoner eller icke -binära kön, är särskilt oroliga för att dessa system kan kategorisera dem fel. Människor som uttrycker sitt kön annorlunda än stereotypa manliga och kvinnliga normer upplever redan diskriminering och skada till följd av att de är felkategoriserade eller missförstådda. Helst, tekniska designers bör utveckla system för att göra dessa problem mindre vanliga, inte mer.

Använda algoritmer för att klassificera människor

När digital teknik blir mer kraftfull och sofistikerad, deras designers försöker använda dem för att identifiera och kategorisera komplexa mänskliga egenskaper, såsom sexuell läggning, kön och etnicitet. Tanken är att med tillräckligt med utbildning om riklig användardata, algoritmer kan lära sig att analysera människors utseende och beteende - och kanske en dag karakterisera människor såväl som, eller ännu bättre än, andra människor gör.

Kön är ett svårt ämne för människor att hantera. Det är ett komplext koncept med viktiga roller både som en kulturell konstruktion och en kärnaspekt av en individs identitet. Forskare, forskare och aktivister avslöjar alltmer de olika, flytande och mångfacetterade aspekter av kön. I processen, de finner att ignorering av denna mångfald kan leda till både skadliga upplevelser och social orättvisa. Till exempel, enligt 2016 National Transgender Survey, 47 procent av transpersonerna uppgav att de upplevt någon form av diskriminering på sin arbetsplats på grund av sin könsidentitet. Mer än hälften av transpersoner som trakasserades, överfallit eller utvisats på grund av deras könsidentitet hade försökt begå självmord.

Många människor har, någon gång, blivit förvånad, eller förvirrad eller till och med arg för att finna sig misstas för en person av ett annat kön. När det händer någon som är transgender - som uppskattningsvis 0,6 procent av amerikanerna, eller 1,4 miljoner människor, är - det kan orsaka betydande stress och ångest.

Effekter av automatiskt könsigenkänning

I vår senaste forskning, vi intervjuade 13 transpersoner och könsbristande, om deras allmänna intryck av automatisk teknik för genusigenkänning. Vi bad dem också att beskriva deras svar på imaginära framtida scenarier där de kan stöta på det. Alla 13 deltagare var oroliga för denna teknik och tvivlade på om det skulle kunna erbjuda deras samhälle några fördelar.

Särskilt oroande var möjligheten att bli könsbeställd av den. i deras erfarenhet, kön är till stor del ett internt, subjektiv egenskap, inte något som nödvändigtvis eller helt uttrycks utåt. Därför, varken människor eller algoritmer kan exakt läsa kön genom fysiska funktioner, som ansiktet, kropp eller röst.

De beskrev hur det kan bli sämre att bli felaktig av algoritmer än om människor skulle göra det. Teknik uppfattas ofta eller anses vara objektiv och opartisk, så att felaktigt kategoriseras av en algoritm skulle betona den missuppfattning att en transgenderidentitet är oäkta. En deltagare beskrev hur de skulle känna sig sårade om en "miljon dollar mjukvara som utvecklats av hur många som helst" bestämde sig för att de inte är som de själva tror att de är.

Sekretess och transparens

Personerna vi intervjuade delade allmänhetens oro över att automatiserade kameror kan användas för övervakning utan deras samtycke eller vetskap. i åratal, forskare och aktivister har lyft röda flaggor om ökande hot mot integriteten i en värld befolkad av sensorer och kameror.

Men våra deltagare beskrev hur effekterna av denna teknik kan vara större för transpersoner. Till exempel, de kan pekas ut som ovanliga eftersom de ser ut eller beter sig annorlunda än vad de underliggande algoritmerna förväntar sig. Vissa deltagare var till och med oroliga för att system felaktigt skulle kunna avgöra att de försöker vara någon annan och lura systemet.

Deras oro gällde även cisgender som kan se ut eller agera annorlunda än majoriteten, som människor av olika raser, människor som algoritmerna uppfattar som androgyne, och människor med unika ansiktsstrukturer. Detta händer redan för människor med minoriteters ras- och etnisk bakgrund, som regelbundet felidentifieras av teknik för ansiktsigenkänning. Till exempel, befintlig ansiktsigenkänningsteknik i vissa kameror misslyckas med att korrekt upptäcka ansikten hos asiatiska användare och skickar meddelanden för att de ska sluta blinka eller öppna ögonen.

Våra intervjuade ville veta mer om hur automatiska könsigenkänningssystem fungerar och vad de används till. De ville inte veta djupa tekniska detaljer, men ville se till att tekniken inte skulle äventyra deras integritet eller identitet. De ville också ha fler transpersoner involverade i de tidiga stadierna av design och utveckling av dessa system, långt innan de distribueras.

Skapa inkluderande automatiska system

Våra resultat visar hur konstruktörer av automatisk kategoriseringsteknik oavsiktligt kan orsaka skada genom att göra antaganden om enkelhet och förutsägbarhet hos mänskliga egenskaper. Vår forskning bidrar till ett växande arbete som försöker mer genomtänkt integrera kön i teknik.

Minoriteter har historiskt lämnats utanför samtal om storskalig teknikutplacering, inklusive etniska minoriteter och personer med funktionsnedsättning. Än, både forskare och designers vet att inkluderande input från minoritetsgrupper under designprocessen kan leda till tekniska innovationer som gynnar alla människor. Vi förespråkar ett mer könsinkluderande och människocentrerat tillvägagångssätt för automatisering som innehåller olika perspektiv.

När digital teknik utvecklas och mognar, de kan leda till imponerande innovationer. Men som människor styr det arbetet, de bör undvika att förstärka mänskliga fördomar och fördomar som är negativa och begränsande. Vid automatiskt könsigenkänning, vi drar inte nödvändigtvis slutsatsen att dessa algoritmer bör överges. Snarare, konstruktörer av dessa system bör inkludera, och känslig för, mångfalden och komplexiteten hos den mänskliga identiteten.

Denna artikel publicerades ursprungligen på The Conversation. Läs originalartikeln.