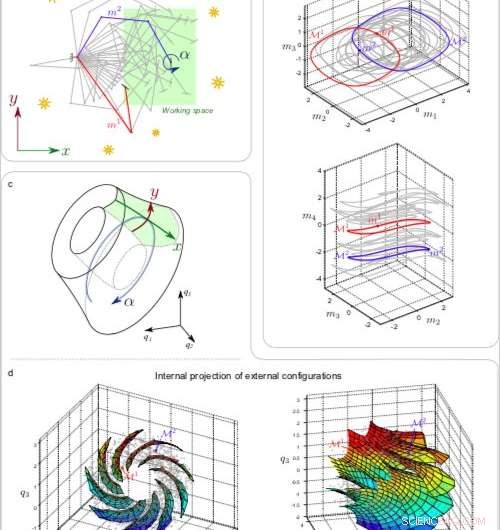

a) 1 % av de 2 500 konfigurationerna av utforskande armar mi . b) Två 3D-projektioner av 1% av uppsättningarna Mi inbäddade i 4D-motorutrymmet. c) Schematisk beskrivning av det projicerade grenröret och infångning av externa parametrar. d) Projektion i 3D av de 2500 grenrören Mi (gråpunkter) med ytor som motsvarar översättningar i arbetsutrymmet för olika näthinneorientering. Kredit:Laflaquière et al.

Forskare vid Sorbonne Universités och CNRS har nyligen undersökt förutsättningarna för uppkomsten av förenklade rumsliga föreställningar i robotsystem, baserat på en robots sensorimotoriska flöde. Deras studie, förpublicerad på arXiv, är en del av ett större projekt, där de undersökte hur grundläggande perceptuella föreställningar (t.ex. kropp, Plats, objekt, Färg, etc.) skulle kunna ingjutas i biologiska eller artificiella system.

Än så länge, designen av robotsystem har huvudsakligen speglat hur människor uppfattar världen. Designa robotar som enbart styrs av mänsklig intuition, dock, skulle kunna begränsa deras uppfattningar till de som upplevs av människor.

För att designa helt autonoma robotar, forskare kan därför behöva gå bort från människorelaterade konstruktioner, låter robotagenter utveckla sitt eget sätt att uppfatta världen. Enligt teamet av forskare vid Sorbonne Universités och CNRS, en robot bör gradvis utveckla sina egna perceptuella föreställningar uteslutande genom att analysera sina sensorimotoriska upplevelser och identifiera meningsfulla mönster.

"Den allmänna hypotesen är att ingen ger uppfattningar om biologiska organismer, "Alexander Terekhov, en av forskarna som genomförde studien, berättade för TechXplore. "Dessa koncept utvecklas istället över tid, som användbara verktyg som hjälper dem att förstå den enorma sensorimotoriska data de ständigt utsätts för. Som en konsekvens, en grodas uppfattning om rymden kommer med största sannolikhet att skilja sig från en fladdermus, som i sin tur kommer att skilja sig från människors. Så när man bygger en robot, vilken föreställning om utrymme ska vi ge det? Förmodligen ingen av dessa. Om vi vill att robotar ska vara riktigt intelligenta, vi bör inte bygga dem med abstrakta föreställningar, men istället, förse dem med algoritmer som gör det möjligt för dem att själva utveckla sådana föreställningar."

Terekhov och hans kollegor visade att begreppet rymden som miljöoberoende inte kan härledas endast genom exteroceptiv information, eftersom denna information varierar mycket beroende på vad som finns i miljön. Denna uppfattning skulle kunna definieras bättre genom att titta på funktioner som kopplar motoriska kommandon till förändringar i stimuli som är externa för medlet.

"Viktig insikt kom från en gammal studie av den berömda franske matematikern Henri Poincare, som var intresserad av hur matematik i allmänhet och geometri i synnerhet kunde komma ur mänsklig perception, ", sa Terekhov. "Han föreslog att sammanträffandet i sensoriska input kan spela en avgörande roll."

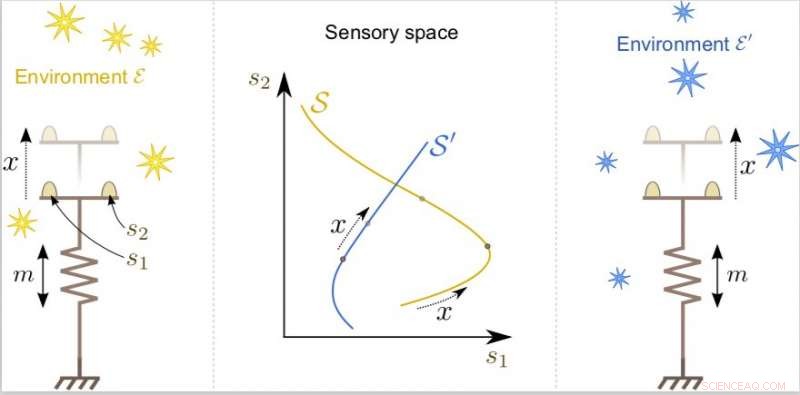

Agenten kan flytta sina sensorer i det yttre utrymmet med hjälp av sin motor. Även om den externa agentens konfiguration x kan vara densamma, dess sensoriska upplevelse varierar mycket beroende på omgivningens struktur. Kredit:Laflaquière et al.

De idéer som Poincare introducerade kan bättre förklaras med ett enkelt exempel. När vi tittar på ett visst föremål, ögonen fångar en viss bild, vilket kommer att ändras om objektet flyttas 10 cm åt vänster. Dock, om vi flyttar 10 cm vänster, bilden vi ser kommer att förbli nästan exakt densamma.

"Den här egenskapen verkar mirakulös om du tänker på hur många receptorer människokroppen har, ", sa Terekhov. "Det är nästan omöjligt att ha samma input två gånger under en livstid, ändå upplever vi det hela tiden. Dessa händelser med låg sannolikhet kan användas av hjärnan för att konstruera allmänna perceptuella föreställningar."

För att tillämpa dessa idéer på design av robotsystem, forskarna programmerade en virtuell robotarm med en kamera i spetsen. Roboten noterade mätningarna som kom från armens leder varje gång den fick samma visuella input. "Genom att associera alla dessa mätningar, roboten bygger en abstraktion som är matematiskt likvärdig med kamerans position och orientering, även om den inte har någon uttrycklig tillgång till denna information, " sa Terekhov. "Det viktigaste är att även om denna abstrakta föreställning lärs in baserat på den visuella input, det slutar med att det blir oberoende av det, och fungerar därmed för alla miljöer; på samma sätt som vår uppfattning om rymden inte beror på den speciella scen vi ser."

Att tillämpa samma princip i en annan studie, forskarna fick framgångsrikt en robot att kompensera för en optisk förvrängning orsakad av en lins framför kameran. Vanligtvis, detta skulle uppnås genom att träna algoritmer på par av förvrängda och oförvrängda bilder.

"Den knepiga delen av vår studie var att roboten var tvungen att slutföra denna uppgift genom att bara titta på de förvrängda bilderna, precis som människor lär sig att kompensera för snedvridningen av glasögon, ", sa Terekhov. "Vi tror att principerna som infördes av Poincare, som är grunden för våra algoritmer, kan vara mer generella och används av hjärnan på flera nivåer. Vi undersöker för närvarande möjligheten att använda dessa principer för att bygga neurala nätverk som inte lider av katastrofal glömska och som gradvis kan ackumulera kunskap."

© 2018 Tech Xplore