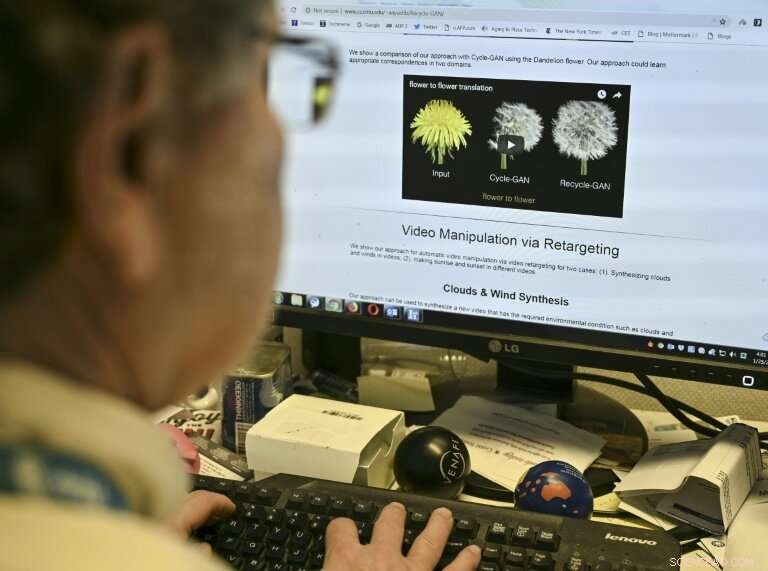

Paul Scharre från Center for a New American Security tittar på en "deepfake" video av USA:s förre president Barack Obama manipulerad för att visa honom tala ord från skådespelaren Jordan Peele den 24 januari, 2019, i Washington

Om du ser en video av en politiker som säger ord som han aldrig skulle uttala, eller en Hollywoodstjärna som osannolikt förekommer i en billig vuxenfilm, justera inte din TV - du kanske bara ser framtiden för "falska nyheter".

"Deepfake"-videor som manipulerar verkligheten blir mer sofistikerade på grund av framstegen inom artificiell intelligens, skapar potential för nya typer av desinformation med förödande konsekvenser.

Allt eftersom tekniken går framåt, oron växer för hur deepfakes kan användas för skändliga syften av hackare eller statliga aktörer.

"Vi har inte riktigt kommit till det stadium där vi ser deepfakes beväpnas, men det ögonblicket kommer, "Robert Chesney, en juridikprofessor vid University of Texas som har forskat i ämnet, sa till AFP.

Chesney hävdar att deepfakes kan lägga till den nuvarande turbulensen över desinformation och påverka verksamheten.

"En vältajmad och eftertänksam manus eller serie av deepfakes kan tippa ett val, utlösa våld i en stad förberedd för civila oroligheter, stärka upproriska berättelser om en fiendes förmodade grymheter, eller förvärra politiska klyftor i ett samhälle, "Chesney och University of Maryland professor Danielle Citron sa i ett blogginlägg för Council on Foreign Relations.

Paul Scharre, en senior stipendiat vid Center for a New American Security, en tankesmedja specialiserad på AI och säkerhetsfrågor, sa att det nästan var oundvikligt att deepfakes skulle användas i kommande val.

Digital manipulation kan vara bra för Hollywood men nya "deepfake"-tekniker kan skapa en ny typ av desinformation, enligt forskare

En falsk video kan användas för att smutskasta en kandidat, Scharre sa, eller för att göra det möjligt för människor att förneka faktiska händelser som fångats på autentisk video.

Med trovärdiga falska videor i omlopp, han lade till, "Människor kan välja att tro vilken version eller berättelse de vill, och det är ett verkligt bekymmer."

Chaplins återkomst?

Videomanipulation har funnits i decennier och kan vara ofarligt eller till och med underhållande – som i det digitalt understödda framträdandet av Peter Cushing i 2016 års "Rogue One:A Star Wars Story, "22 år efter hans död.

Forskare från Carnegie Mellon University avslöjade förra året tekniker som gör det lättare att producera deepfakes via maskininlärning för att sluta sig till saknad data.

I filmbranschen, "förhoppningen är att vi kan få gamla filmstjärnor som Charlie Chaplin att komma tillbaka, " sa Aayush Bansal.

Experter säger att ett viktigt sätt att hantera deepfakes är att öka allmänhetens medvetenhet, gör folk mer skeptiska till vad som brukade betraktas som ett obestridligt bevis

Populariseringen av appar som gör realistiska falska videor hotar att undergräva föreställningen om sanning i nyhetsmedia, brottsprocesser och många andra områden, påpekar forskare.

"Om vi kan lägga några ord i någons mun, det är ganska läskigt, " säger Siwei Lyu, en professor i datavetenskap vid State University of New York i Albany, som forskar om deepfake-detektion.

"Det suddar ut gränsen mellan vad som är sant och vad som är falskt. Om vi inte riktigt kan lita på att information är autentisk är det inte bättre än att inte ha någon information alls."

Representanten Adam Schiff och två andra lagstiftare skickade nyligen ett brev till National Intelligence Director Dan Coats och bad om information om vad regeringen gör för att bekämpa deepfakes.

"Smidda videor, bilder eller ljud kan användas för att rikta in sig på individer för utpressning eller för andra skändliga ändamål, " skrev lagstiftarna.

"Av större oro för nationell säkerhet, de kan också användas av utländska eller inhemska aktörer för att sprida desinformation."

Producenterna av "Rogue One:A Star Wars Story, " digitalt återskapade skådespelarna Peter Cushing och Carrie Fisher efter deras död med tekniker som liknar de som används för "deepfake" videor

Att skilja falskt från verkligt

Forskare har arbetat med bättre detektionsmetoder under en tid, med stöd från privata företag som Google och statliga enheter som Pentagon's Defense Advanced Research Projects Agency (DARPA), som startade ett mediekriminaltekniskt initiativ 2015.

Lyus forskning har fokuserat på att upptäcka förfalskningar, delvis genom att analysera graden av blinkning av en individs ögon.

Men han erkänner att det kanske inte är tillräckligt att upptäcka förfalskningar, om en video blir viral och leder till kaos.

"Det är viktigare att störa processen än att analysera videorna, " sa Lyu.

Medan deepfakes har utvecklats i flera år, ämnet hamnade i fokus med skapandet i april förra året av video som visades för att visa förre presidenten Barack Obama använda ett förbannelseord för att beskriva sin efterträdare Donald Trump – ett koordinerat jippo från filmskaparen Jordan Peele och BuzzFeed.

En AFP-journalist ser ett exempel på en "deepfake" video manipulerad med hjälp av artificiell intelligens, av forskare från Carnegie Mellon University

Även under 2018, en spridning av "ansiktsbyte"-porrfilmer som använde bilder av Emma Watson, Scarlett Johansson och andra kändisar föranledde förbud mot deepfakes av Reddit, Twitter och Pornhub, även om det förblev oklart om de kunde genomdriva policyerna.

Scharre said there is "an arms race between those who are creating these videos and security researchers who are trying to build effective tools of detection."

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " han sa.

© 2019 AFP