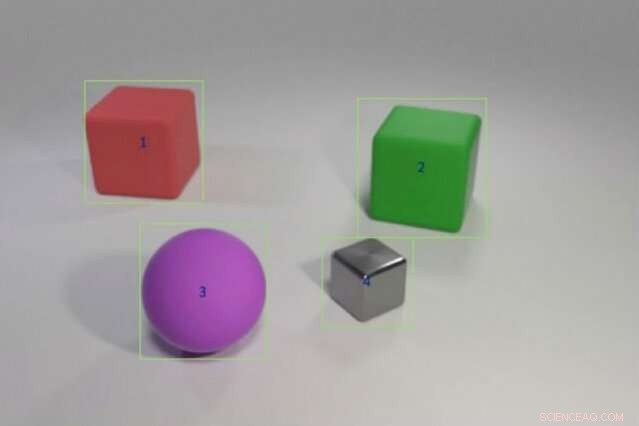

Forskare utbildade en hybrid AI -modell för att svara på frågor som "Har det röda objektet kvar på den gröna kuben samma form som den lila matten?" genom att ge den exempel på objektfärger och former följt av mer komplexa scenarier som involverar jämförelse av flera objekt. Modellen kan överföra denna kunskap till nya scenarier såväl som eller bättre än toppmoderna modeller med hjälp av en bråkdel av utbildningsdata. Upphovsman:Justin Johnson

Ett barn som aldrig har sett en rosa elefant kan fortfarande beskriva en - till skillnad från en dator. "Datorn lär sig av data, "säger Jiajun Wu, en doktorsexamen student på MIT. "Möjligheten att generalisera och känna igen något du aldrig sett förut - en rosa elefant - är mycket svår för maskiner."

Deep learning -system tolkar världen genom att plocka ut statistiska mönster i data. Denna form av maskininlärning finns nu överallt, automatiskt tagga vänner på Facebook, berättar Alexas senaste väderprognos, och leverera roliga fakta via Google -sökning. Men statistiskt lärande har sina gränser. Det kräver massor av data, har svårt att förklara sina beslut, och är hemsk på att tillämpa tidigare kunskap på nya situationer; Den kan inte förstå en elefant som är rosa istället för grå.

För att ge datorer möjlighet att resonera mer som oss, artificiell intelligens (AI) forskare återgår till abstrakt, eller symbolisk, programmering. Populärt på 1950- och 1960 -talen, symboliska AI -trådar i reglerna och logiken som gör att maskiner kan göra jämförelser och tolka hur objekt och enheter förhåller sig. Symbolisk AI använder mindre data, registrerar kedjan av steg som krävs för att nå ett beslut, och i kombination med den brutala processorkraften hos statistiska neurala nätverk, det kan till och med slå människor i ett komplicerat bildförståelsestest.

En ny studie av ett team av forskare vid MIT, MIT-IBM Watson AI Lab, och DeepMind visar löftet att slå samman statistisk och symbolisk AI. Under ledning av Wu och Joshua Tenenbaum, professor vid MIT:s institution för hjärn- och kognitiv vetenskap och datavetenskap och artificiell intelligenslaboratorium, teamet visar att dess hybridmodell kan lära sig objektrelaterade koncept som färg och form, och utnyttja den kunskapen för att tolka komplexa objektrelationer i en scen. Med minimal träningsdata och ingen tydlig programmering, deras modell kan överföra koncept till större scener och svara på allt svårare frågor såväl som eller bättre än dess toppmoderna kamrater. Teamet presenterar sina resultat på den internationella konferensen om inlärningsrepresentationer i maj.

"Ett sätt barn lär sig begrepp är genom att koppla ihop ord med bilder, "säger studiens huvudförfattare Jiayuan Mao, en kandidatexamen vid Tsinghua University som arbetade på projektet som en besökande stipendiat på MIT. "En maskin som kan lära sig på samma sätt behöver mycket mindre data, och kan bättre överföra sin kunskap till nya scenarier. "

Studien är ett starkt argument för att gå tillbaka mot abstrakta programmetoder, säger Jacob Andreas, nyutexaminerad från University of California i Berkeley, som börjar på MIT som biträdande professor i höstas och inte var inblandad i arbetet. "Tricket, det visar sig, är att lägga till mer symbolisk struktur, och för att mata de neurala nätverken en representation av världen som är indelad i objekt och egenskaper snarare än att ge den råa bilder, "säger han." Detta arbete ger oss inblick i vad maskiner behöver förstå innan språkinlärning är möjlig. "

Teamet tränade sin modell på bilder i par med relaterade frågor och svar, del av CLEVR -bildförståelsestestet utvecklat vid Stanford University. Som modellen lär sig, frågorna blir allt svårare, från, "Vad är föremålets färg?" till "Hur många föremål är båda till höger om den gröna cylindern och har samma material som den lilla blå bollen?" När koncept på objektnivå behärskar modellen går vidare till att lära sig att relatera objekt och deras egenskaper till varandra.

Liksom andra hybrid AI -modeller, MIT:s fungerar genom att dela upp uppgiften. En uppfattningsmodul av neurala nätverk kraschar pixlarna i varje bild och kartlägger objekten. En språkmodul, också gjorda av neurala nät, extraherar en mening från orden i varje mening och skapar symboliska program, eller instruktioner, som berättar för maskinen hur man svarar på frågan. En tredje resonemangsmodul kör de symboliska programmen på scenen och ger ett svar, uppdatera modellen när den gör misstag.

Nyckeln till teamets tillvägagångssätt är en uppfattningsmodul som översätter bilden till en objektbaserad representation, att göra programmen enklare att utföra. Unikt är också vad de kallar läroplaner, eller selektivt träna modellen på koncept och scener som blir allt svårare. Det visar sig att mata maskindata på ett logiskt sätt, snarare än slumpmässigt, hjälper modellen att lära sig snabbare samtidigt som precisionen förbättras.

När modellen väl har en solid grund, det kan tolka nya scener och koncept, och allt svårare frågor, nästan perfekt. Ombedd att svara på en okänd fråga som, "Vad är formen på den stora gula saken?" det överträffade sina kamrater på Stanford och närliggande MIT Lincoln Laboratory med en bråkdel av data.

Medan andra modeller utbildade sig på hela CLEVR -datasetet på 70, 000 bilder och 700, 000 frågor, MIT-IBM-modellen används 5, 000 bilder och 100, 000 frågor. Eftersom modellen byggde på tidigare inlärda koncept, det absorberade programmen bakom varje fråga, påskynda utbildningsprocessen.

Även om det är statistiskt, djupinlärningsmodeller är nu inbäddade i det dagliga livet, mycket av deras beslutsprocess förblir dolt från syn. Denna brist på transparens gör det svårt att förutse var systemet är mottagligt för manipulation, fel, eller partiskhet. Att lägga till ett symboliskt lager kan öppna den svarta rutan, förklarar det växande intresset för hybrid -AI -system.

"Att dela upp uppgiften och låta program göra en del av arbetet är nyckeln till att bygga tolkbarhet till djupa inlärningsmodeller, "säger Lincoln Laboratory -forskaren David Mascharka, vars hybridmodell, Transparens genom designnätverk, är riktmärke i MIT-IBM-studien.

MIT-IBM-teamet arbetar nu med att förbättra modellens prestanda på verkliga foton och utvidga det till videoförståelse och robotmanipulation. Andra författare till studien är Chuang Gan och Pushmeet Kohli, forskare vid MIT-IBM Watson AI Lab och DeepMind, respektive.

Denna artikel publiceras på nytt med tillstånd av MIT News (web.mit.edu/newsoffice/), en populär webbplats som täcker nyheter om MIT -forskning, innovation och undervisning.