Brendan Bena presenterar sitt arbete på en konferens. Kredit:UC Colorado Springs.

Under de senaste decennierna, forskare har utvecklat alltmer avancerade verktyg för artificiell intelligens (AI) och beräkningstekniker som kan tillämpas i en mängd olika miljöer. Bland dessa, tekniker som kan generera skrivna eller talade språk har väckt stor uppmärksamhet, särskilt med introduktionen av nya röstassistenter, robotar och nya interaktiva enheter.

Forskare vid University of Colorado (UC) - Colorado Springs och Drury University har nyligen utvecklat ett unikt språkgenereringssystem som kan producera kreativa poesiverser. Deras system, presenteras i en tidning förpublicerad på arXiv, är en finjusterad anpassning av GPT-2, en förtränad språkmodell utvecklad av OpenAI.

Jugal Kalita, professorn vid UC Colorado Springs som övervakar den senaste studien, har bedrivit forskning om att skapa naturliga språk under de senaste 30 åren, från sin examen vid University of Pennsylvania. Hans första artikel om naturligt språkgenerering, publicerades 1988, syftade till att producera textstycken som kan förekomma i en typisk tidskrift, efter en grundläggande uppsättning regler. På senare tid, inspirerad av framsteg inom artificiella neurala nätverk för naturlig språkbehandling (NLP), Prof. Kalita och hans studenter började utveckla tekniker för djupinlärning för generering av korta artiklar, dialoger och kreativt skrivande.

"Idén att undersöka ämnet automatisk poesigenerering kom till i början av sommaren 2019, när Brendan Bena, en sommarforskare vid University of Colorado, Colorado Springs, från Missouri's Drury University, visade intresse för att automatiskt generera sångtexter, " Prof. Kalita berättade för TechXplore. "Han ville ursprungligen titta på att skapa ett system som skulle försöka efterlikna de känslor som framkallas genom sångtexter."

Eftersom de flesta sångtexter är skyddade av upphovsrätt, Det kan vara mycket utmanande att hitta stora datamängder för att träna modeller för djupinlärning för att skapa texter. Bena och Prof. Kalita bestämde sig därför för att utveckla ett verktyg för djupinlärning för poesigenerering istället. Men istället för att fokusera på egenskaper som diktens struktur eller rytm, som de flesta tidigare poesigenerationsstudier, de utforskade dess mer känslomässiga och kreativa aspekter.

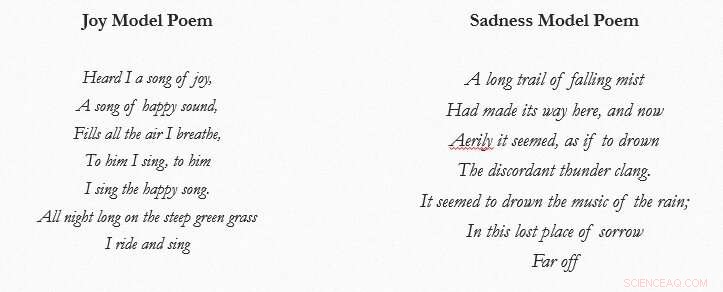

Exempel på poesi som väcker känslor som produceras av forskarnas språkgenereringssystem. Kredit:Bena &Kalita.

"Efter att ha insett att det fanns en mycket större del av forskning, såväl som data, inom området för poesigenerering, vi flyttade vårt fokus till just detta ämne, " Bena berättade för TechXplore. "Arbetet var till stor del baserat på den övergripande uppgiften att skapa text som kom med mycket tidigare forskning. Dock, till skillnad från tidigare ansträngningar, vi ville fokusera mer på innehållet, textens känslor och kreativitet, i motsats till strukturen eller rytmen som finns i tidigare studier av poesigeneration."

För att utveckla sitt poesigenereringssystem, Bena och Prof. Kalita samlade först en stor korpus av text från databaserna Project Gutenberg och UC-Santa Cruz Dreambank. De bläddrade igenom Gutenberg-databasen och letade efter ord som ingår i EmoLex, ett känslolexikon-dataset utvecklat av National Research Council of Canada.

Forskarna delar sedan upp den resulterande datamängden i olika "känslokategorier", " tittar på antalet EmoLex-ord som finns i varje utdrag, och använde dessa data för att träna ett djupt neuralt nätverk. Modellen de tränade är en anpassning av GPT-2, en arkitektur som lär sig att generera nya fragment av text genom att modellera språkstilen som används i data som den tränas på.

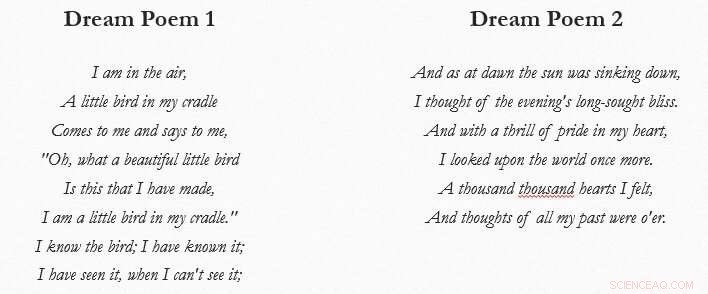

"Vi matade också vårt artificiella neurala nätverk med en kombination av drömdata och poesi för att skapa vad som kallas "drömpoesi", "" förklarade Bena. "Till slut, vi hade fem separata känslomodeller för känslor av glädje, sorg, förtroende, ilska och förväntan, men vi hade också en drömpoesimodell. Detta system, som sagt tidigare, fokuserar mindre på strukturen som finns i många poesigenereringsarbeten och mer på en poesistil med fria verser som ser ut att imitera och reproducera finessen och kreativiteten hos riktiga poeter."

Forskarna bad mänskliga användare att utvärdera dikterna som skapats av deras system, samtidigt som man använder Coh-Metrix-verktyget för att bedöma kvaliteten på de verser det genererade. De fann att den producerade dikter som effektivt framkallade sorg och glädje 87,5 % och 85 % av gångerna, respektive. Dessutom, när de tränas på både drömdata och poesi, deras system genererade unika "drömlika" poesiverser som fångade delar av vad som kallas "drömpoesi" med en poäng på 3,2 på Likert-skalan.

Exempel på drömpoesi producerad av forskarnas språkgenereringssystem. Kredit:Bena &Kalita.

"Våra resultat tyder på att text kan, faktiskt, skapas så att det väcker känslor hos läsarna och att det kan likna de typer av kreativitet som konstnärer vill injicera i sitt arbete, ", sa Bena. "Vi tror att vår forskning är ett nytt verk inom området kreativ poesigenerering och hoppas att vår studie kommer att öppna dörren till framtida arbete inom detta område."

Bena och Prof. Kalita är bland de första som visar första glimtar av maskinkreativitet i poesigenerering. I sina nästa studier, forskarna planerar att förbättra kvaliteten på dikterna som komponeras av deras system, samtidigt som de tillämpar sitt förhållningssätt till att skapa poesi på andra språk.

"Om vi kurerar träningsdata lite mer, vi tror att en neural nätverksarkitektur bättre skulle kunna fånga de känslor och drömliknande aspekter av poesin vi försöker skapa, " sa Bena. "Faktiskt, medan EmoLex-ordboken är en mycket användbar datauppsättning, dess vokabulär står inte för all den äldre engelska som finns i en del av Gutenberg-poesin."

I framtiden, forskarna hoppas kunna replikera sitt experiment med fokus på lexikon på fras- eller segmentnivå, eftersom detta skulle kunna göra det möjligt för dem att fånga beroenden i känslobaserad text mer effektivt. Deras studie kan också upprepas med en mer sofistikerad neural nätverksbaserad arkitektur, vilket kan förbättra kvaliteten på den framställda poesin både när det gäller grammatik och meningsstruktur.

Eftersom Bena och Prof. Kalita redan har använt sitt system för att producera drömpoesiverser, de skulle så småningom kunna tillämpa det på andra kreativa stilar också, som raderingspoesi. Raderingspoesi produceras genom att ta specifika eller slumpmässiga ord från en befintlig text och sedan använda dem för att bilda nya verser.

"Till sist, vi arbetar också med att skapa poesi på olika språk med hjälp av transfer learning, " sa Prof. Kalita. "Till exempel, Shaun Tucker, en masterstudent vid UC-Colorado Springs har skapat poesi på ett antal indoeuropeiska språk med hjälp av OpenAI:s förtränade GPT-2-modell. Än så länge, vi har skapat dikter på engelska, spanska, ukrainska, hindi, bengaliska och assamiska och fann att den generativa modellen för djupinlärning GPT-2, som har förutbildats med en stor mängd engelsk text, kan tränas med prosa och dikter på alla dessa språk för att skapa poesi."

© 2020 Science X Network