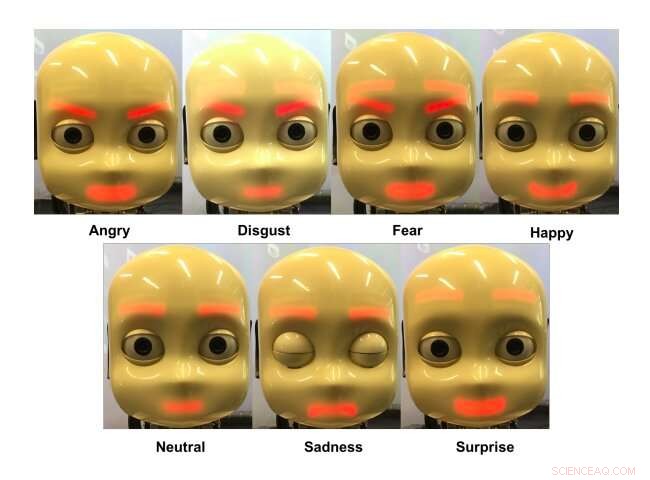

iCub-roboten uttrycker olika känslor. Kredit:Churamani et al.

När robotar tar sig in i en mängd olika miljöer och börjar interagera med människor på en regelbunden basis, de ska kunna kommunicera med användarna så effektivt som möjligt. Under det senaste decenniet eller så, Forskare över hela världen har därför utvecklat maskininlärningsbaserade modeller och andra beräkningstekniker som kan förbättra kommunikationen mellan människa och robot.

Ett sätt att förbättra hur robotar kommunicerar med mänskliga användare är att träna dem att uttrycka grundläggande känslor, såsom sorg, lycka, rädsla och ilska. Förmågan att uttrycka känslor skulle i slutändan tillåta robotar att förmedla budskap mer effektivt, på sätt som är anpassade till en given situation.

Forskare vid universitetet i Hamburg i Tyskland har nyligen utvecklat en maskininlärningsbaserad metod för att lära robotar hur man förmedlar det som tidigare definierats som de sju universella känslorna, nämligen ilska, avsky, rädsla, lycka, sorg, överraskning och ett neutralt tillstånd. I deras tidning, förpublicerad på arXiv, de tillämpade och testade sin teknik på en humanoid robot som heter iCub.

Det nya tillvägagångssättet som forskarna föreslår hämtar inspiration från ett tidigare utvecklat ramverk kallat TAMER. TAMER är en algoritm som kan användas för att träna multilayer perceptrons (MLPs), en klass av artificiella neurala nätverk (ANN).

I den senaste studien, TAMER-ramverket anpassades för att träna en maskininlärningsbaserad modell för att förmedla olika mänskliga känslor genom att producera olika ansiktsuttryck i iCub-roboten. iCub är en robotplattform med öppen källkod utvecklad av ett forskarteam vid det italienska tekniska institutet (IIT) som en del av EU-projektet RobotCub, som ofta används inom robotforskning för att utvärdera maskininlärningsalgoritmer.

"Roboten använder en kombination av ett konvolutionellt neuralt nätverk (CNN) och en självorganiserande karta (SOM) för att känna igen en känsla och lär sig sedan att uttrycka densamma med en MLP, " skrev forskarna i sin uppsats. "Vårt mål var att lära en robot att reagera adekvat på en användares uppfattning av känslor och lära sig att uttrycka olika känslor."

CNN som forskarna använder analyserar bilder av en mänsklig användares ansiktsuttryck, fångad av iCub-roboten. De ansiktsrepresentationer som produceras av denna analys matas sedan till en SOM, som avslöjar särskilda mönster i hur användaren uttryckte en viss känsla.

Senare, dessa mönster är modellerade och används för att träna en MLP för att förutsäga hur iCubs ansiktsdrag kan anpassas för att på bästa sätt efterlikna användarens ansiktsuttryck. Den mänskliga användaren belönar sedan roboten baserat på hur exakt den uttryckte en given känsla.

"När iCub utför och agerar, användaren förväntas belöna det, vilket ger det ett målvärde att uppnå, " förklarade forskarna i sin uppsats. "Detta görs genom att be användaren att härma roboten, ge den information om hur mycket den utförda åtgärden skiljer sig från den avsedda åtgärden."

Över tid, baserat på belöningarna den får från mänskliga användare, det ramverk som forskarna tagit fram bör lära sig att uttrycka var och en av de sju universella känslorna. Än så länge, Tekniken har utvärderats i en serie preliminära experiment med iCub-robotplattformen, uppnå ganska lovande resultat.

"Även om resultaten var lovande och det minskade tiden som behövs för träning avsevärt, vår metod krävde fortfarande mer än 100 interaktioner per användare för att lära sig meningsfulla uttryck, ", sa forskarna. "Detta antal förväntas minska med förbättringar av träningsmetoder och genom att samla in mer data för träning."

© 2020 Science X Network