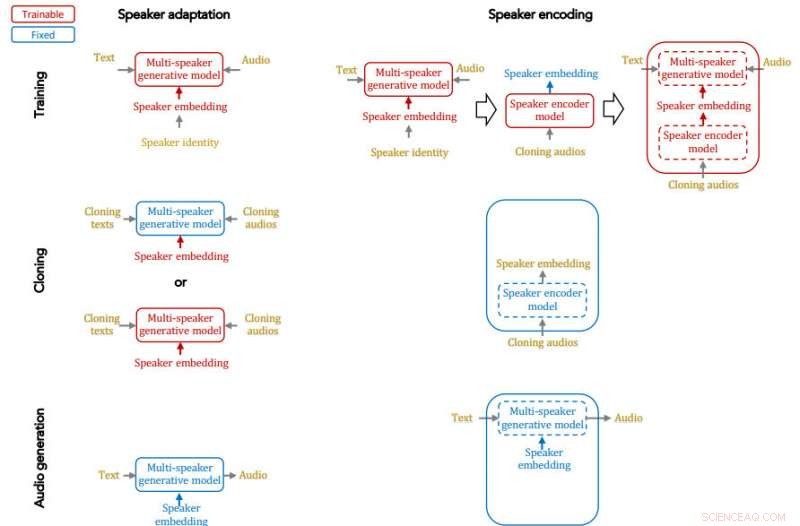

Högtalaranpassning och högtalarkodningsmetoder för utbildning, kloning och ljudgenerering. Kredit:arXiv:1802.06006 [cs.CL]

Via whitepaper som de har laddat upp till arXiv preprint server, ett team på Baidu (Kinas svar på Google) har meddelat en uppgradering av deras text-till-tal-applikation som heter Deep Voice. Nu, istället för att ta en halvtimme eller längre tid att analysera en persons röst och replikera den, systemet kan göra det på mindre än en minut. Det neurala nätverksbaserade systemet är en del av ett försök från teamet på Baidu att få maskiner att låta mer som människor när de "talar" till oss.

Det finns två delar i systemet. Den första handlar om att spela in röstprover för att låta systemet lära sig hur personens röst låter. Den andra delen läser användardefinierad text högt med ämnets röst.

Flera grupper har arbetat med projekt som syftar till att replikera ljudet av en enskild persons röst, skenbart för att låta robotassistenter låta som verkliga mänskliga assistenter. Således, ett program som omvandlar text till ord som låter som du, din granne, Donald Trump eller Englands drottning förväntas inte erbjuda mycket i vägen för en slutprodukt – även om Baidu föreslår att den kan användas av människor som har tappat användningen av sin röst. Istället, det är tänkt som ett språngbräde till större saker. Det nya systemet, laget rapporterar, fungerar optimalt när det ges 100 fem-sekunders röstsampel. Det kan också manipulera en röst, låta människor höra hur de låter, till exempel, med brittisk accent, eller som någon av det motsatta könet. Det blir också bättre på att härma röster, och kan nu lura röstigenkänningsprogramvara 95 procent av tiden – och ett mänskligt test gav systemet ett genomsnittligt betyg på 3,16 av 4.

Men, som många i pressen har noterat, tekniken kan orsaka problem. Bandade förhör av polisen skulle kunna bli värdelösa om någon med en smartphone kunde generera samma konversation. Det finns också problemet med identitetsstöld. Om en tjuv kan stjäla din data och din röst, du kanske aldrig får tillbaka det. Eller överväg att politiska agenter släpper falska inspelningar av politiker som har konversationer som kan påverka ett val.

© 2018 Tech Xplore