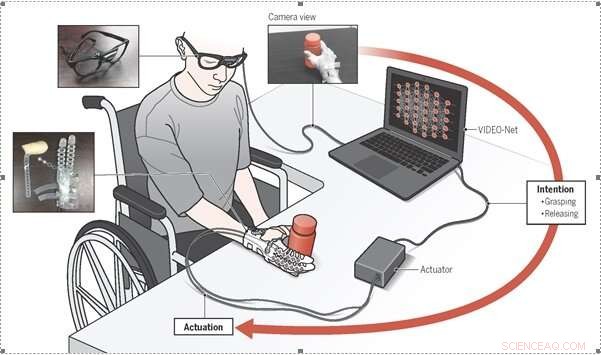

Ett koreanskt forskarlag skapade en bärbar handrobot som kan hjälpa funktionshindrade som tappade handrörlighet. Roboten kan upptäcka användarens avsikt genom att samla in beteenden med maskininlärningsalgoritm. Kredit:Soft Robotics Research Center, Seouls nationella universitet

Ett koreanskt forskarlag har föreslagit ett nytt paradigm för en bärbar handrobot som kan hjälpa människor med förlorade handrörlighet. Handroboten samlar in användarbeteenden med en maskininlärningsalgoritm för att bestämma användarens avsikt.

Professor Sungho Jo (KAIST) och Kyu-Jin Cho (Seoul National University) har föreslagit ett nytt paradigm för avsiktsdetektering för bärbara handrobotar. Det föreslagna paradigmet förutspår att greppa/släppa avsikter baserat på användarbeteenden, gör det möjligt för patienter med ryggmärgsskada (SCI) med förlorad handrörlighet att plocka och placera föremål.

De utvecklade metoden baserad på en maskininlärningsalgoritm som förutsäger användarens avsikter via en förstapersonskamera. Deras utveckling är baserad på hypotesen att användarens avsikter kan härledas genom insamling av användararmbeteenden och hand-objekt-interaktioner.

Maskininlärningsmodellen som används i denna studie, Vision-baserat Intention Detection-nätverk från en EgOcentric-vy (VIDEO-Net), är utformad utifrån denna hypotes. VIDEO-Net består av rumsliga och tidsmässiga delnätverk, som känner igen användararmbeteenden, och ett rumsligt undernätverk som känner igen hand-objekt-interaktioner.

En SCI-patient som bär Exo-Glove Poly II, en mjuk bärbar handrobot, framgångsrikt plockat och placerat olika föremål och utfört viktiga aktiviteter i det dagliga livet, som att dricka kaffe, utan ytterligare hjälp.

Denna utveckling är fördelaktig genom att den upptäcker användarens avsikter utan att kräva några person-till-person-kalibreringar eller ytterligare åtgärder. Detta gör det möjligt för en människa att använda den bärbara handroboten sömlöst.

Intervju med professor Kyu-Jin Cho

F:Hur fungerar det här systemet?

S:Denna teknik syftar till att förutsäga användarnas avsikter, specifikt greppa och släppa uppsåt mot ett målobjekt, genom att använda en förstapersonskamera monterad på glasögon. VIDEONet, en djupinlärningsbaserad algoritm, är utformad för att förutsäga användarens avsikter från kameran baserat på användararmbeteenden och hand-objekt-interaktioner. Istället för att använda biosignaler, som ofta används för avsiktsdetektering av funktionshindrade, vi använder en enkel kamera för att ta reda på om personen försöker greppa eller inte. Detta fungerar eftersom målanvändarna kan röra sin arm, men inte deras händer. Vi kan förutsäga användarens avsikt att greppa genom att observera armrörelsen och avståndet från föremålet och handen, och tolka observationen med hjälp av maskininlärning.

F:Vem drar nytta av denna teknik?

A:Som nämnts tidigare, denna teknik upptäcker användarens avsikter från mänskliga armbeteenden och hand-objekt-interaktioner. Denna teknik kan användas av alla med förlorad handrörlighet på grund av ryggmärgsskada, stroke, cerebral pares eller något annat tillstånd, så länge de kan röra sin arm frivilligt.

F:Vilka är begränsningarna och framtida arbeten?

S:De flesta av begränsningarna kommer från nackdelarna med att använda en monokulär kamera. Till exempel, om ett målobjekt är blockerat av ett annat objekt, prestandan för denna teknik minskar. Också, om användarens handgester inte kan ses i kamerascenen, tekniken är inte användbar. För att övervinna bristen på allmänhet på grund av dessa problem, Algoritmen behöver förbättras genom att införliva annan sensorinformation eller andra befintliga metoder för avsiktsdetektering, som att använda en elektromyografisensor eller spåra ögonblick.

F:För att använda denna teknik i det dagliga livet, vad behöver du?

S:För att denna teknik ska kunna användas i det dagliga livet, en användare behöver en bärbar handrobot med en aktiveringsmodul, en datorenhet, och glasögon med en kamera monterad. Vi strävar efter att minska storleken och vikten på datorenheten så att roboten kan vara portabel för att användas i det dagliga livet. Vi använde en kompakt datorenhet som uppfyller våra krav, men vi förväntar oss att neuromorfa chips som kan utföra djupinlärningsberäkningar kommer att vara kommersiellt tillgängliga.