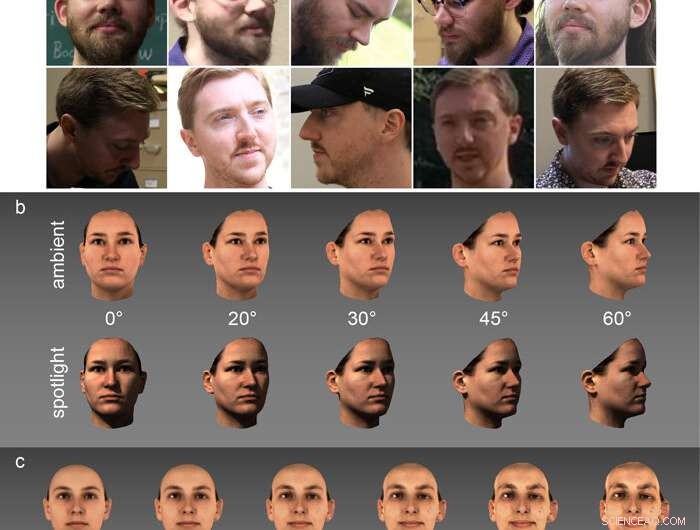

Verkliga världen, fria bilder som dessa (a) används för att träna ansiktsigenkänningsnätverk. Testning för studien gjordes på mycket kontrollerade laserskanningsdata som varierade efter synvinkel (b, kolumner), belysning (b, rader) och karikatyrliknande identitetsstyrka (c). Kredit:University of Texas i Dallas

Tekniken för ansiktsigenkänning har utvecklats snabbt under de senaste fem åren. När forskare vid University of Texas i Dallas försöker avgöra hur datorer har blivit lika bra som människor i uppgiften, de belyser också hur den mänskliga hjärnan sorterar information.

Forskare från UT Dallas har analyserat prestandan för den senaste nivån av ansiktsigenkänningsalgoritmer, avslöjar det överraskande sättet dessa program – som är baserade på maskininlärning – fungerar. Deras studie, publicerad online 12 november in Nature Machine Intelligence , visar att dessa sofistikerade datorprogram – kallade deep convolutional neural networks (DCNN) – kom på hur man identifierade ansikten annorlunda än forskarna förväntade sig.

"Under de senaste 30 åren, människor har antagit att datorbaserade visuella system gör sig av med all bildspecifik information – vinkel, belysning, uttryck och så vidare, " sa Dr Alice O'Toole, senior författare till studien och Aage och Margareta Møller professor vid School of Behavioral and Brain Sciences. "Istället, Algoritmerna behåller den informationen samtidigt som den gör identiteten viktigare, vilket är ett i grunden nytt sätt att tänka på problemet."

I maskininlärning, datorer analyserar stora mängder data för att lära sig känna igen mönster, med målet att kunna fatta beslut med minimal mänsklig insats. O'Toole sa att de framsteg som gjorts av maskininlärning för ansiktsigenkänning sedan 2014 har "förändrat allt med kvantsprång."

"Saker som aldrig var genomförbara förut, som har hindrat datorseendeteknik i 30 år, blev inte bara genomförbart, men ganska lätt, "Sade O'Toole. "Fångsten är att ingen förstod hur det fungerar."

Tidigare generationers algoritmer var effektiva för att känna igen ansikten som endast hade små förändringar från bilden de redan kände. Nuvarande teknik, dock, känner en identitet tillräckligt väl för att övervinna förändringar i uttryck, synvinkel eller utseende, som att ta bort glasögon.

"Dessa nya algoritmer fungerar mer som du och jag, "O'Toole sa. "Det beror delvis på att de har samlat på sig en enorm mängd erfarenhet med variationer i hur en identitet kan se ut. Men det är inte hela bilden."

O'Tooles team började lära sig hur inlärningsalgoritmerna fungerar – både för att underbygga förtroendet för deras resultat och, som huvudförfattaren Matthew Hill förklarade, för att belysa hur den mänskliga hjärnans visuella cortex utför samma uppgift.

"Strukturen av den här typen av neurala nätverk inspirerades ursprungligen av hur hjärnan bearbetar visuell information, sa Hill, doktorand i kognition och neurovetenskap. "Eftersom den utmärker sig på att lösa samma problem som hjärnan gör, det kan ge insikt i hur hjärnan löser problemet."

Ursprunget till den typ av neurala nätverksalgoritmer som teamet studerade går tillbaka till 1980, men kraften hos neurala nätverk växte exponentiellt mer än 30 år senare.

"Tidigt i detta decennium, två saker hände:Internet gav det här programmet miljontals bilder och identiteter att arbeta med – otroliga mängder lättillgänglig data – och datorkraften växte, så att, istället för att ha två eller tre lager av "neuroner" i det neurala nätverket, du kan ha mer än 100 lager, som detta system nu gör, " sa O'Toole.

Trots algoritmens avsedda syfte, omfattningen av dess beräkningar – som uppgår till åtminstone tiotals miljoner – betyder att forskare inte kan förstå allt som den gör.

"Även om algoritmen utformades för att modellera neuronbeteende i hjärnan, vi kan inte hålla reda på allt som görs mellan input och output, sa Connor Parde, en författare till uppsatsen och en doktorand i kognition och neurovetenskap. "Så vi måste fokusera vår forskning på resultatet."

För att visa algoritmens kapacitet, laget använde karikatyrer, extrema versioner av en identitet, som Y. Ivette Colón BS'17, en forskningsassistent och en annan författare till studien, beskrivs som "den mest 'du'-versionen av dig."

"Karikatyrer överdriver din unika identitet i förhållande till alla andras, " sa O'Toole. "På ett sätt, det är precis vad algoritmen vill göra:framhäva det som gör dig annorlunda från alla andra."

Till forskarnas förvåning, DCNN utmärkte sig faktiskt med att koppla karikatyrer till deras motsvarande identiteter.

"Med tanke på dessa förvrängda bilder med funktioner ur proportion, nätverket förstår att dessa är samma egenskaper som gör en identitet särskiljande och korrekt kopplar karikatyren till identiteten, "O'Toole sa. "Den ser den distinkta identiteten på ett sätt som ingen av oss hade förutsett."

Så, när datorsystemen börjar bli lika — och, vid tillfälle, överträffa – människors ansiktsigenkänningsprestanda, kan algoritmens grund för att sortera information likna det som den mänskliga hjärnan gör?

Att få reda på, det behövs en bättre förståelse av den mänskliga visuella cortex. Den mest detaljerade informationen som finns tillgänglig är via bilder erhållna via funktionell MR, som kan användas för att avbilda hjärnans aktivitet medan en person utför en mental uppgift. Hill beskrev fMRI som "för bullriga" för att se de små detaljerna.

"Upplösningen av en fMRI är inte i närheten av vad du behöver för att se vad som händer med aktiviteten hos enskilda neuroner, " sa Hill. "Med dessa nätverk, du har alla beräkningar. Det låter oss fråga:Kan identiteter organiseras på detta sätt i våra sinnen?"

O'Tooles labb kommer att ta itu med den frågan härnäst, tack vare ett nyligen anslag på mer än 1,5 miljoner USD under fyra år från National Eye Institute of the National Institutes of Health.

"NIH har gett oss den biologiska frågan:Hur relevanta är dessa resultat för mänsklig visuell perception?" Hon sa. "Vi har fyra års finansiering på oss att hitta ett svar."