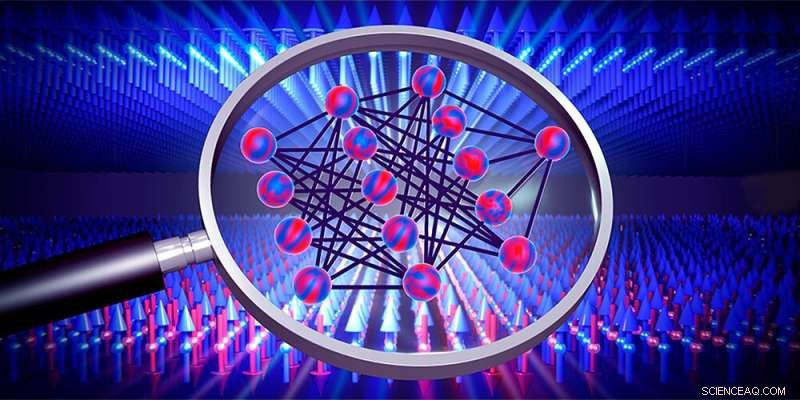

Neurala nätverk (mitten) kan användas för att undersöka fasövergångar, till exempel av magnetiska material (pilar). Kredit:Institutionen för fysik, universitetet i Basel

Neurala nätverk är inlärningsalgoritmer som approximerar lösningen på en uppgift genom att träna med tillgänglig data. Det är dock vanligtvis oklart hur exakt de åstadkommer detta. Två unga Basel-fysiker har nu härlett matematiska uttryck som gör att man kan beräkna den optimala lösningen utan att träna ett nätverk. Deras resultat ger inte bara insikt i hur dessa inlärningsalgoritmer fungerar, utan kan också hjälpa till att upptäcka okända fasövergångar i fysiska system i framtiden.

Neurala nätverk är baserade på principen om hjärnans funktion. Sådana datoralgoritmer lär sig lösa problem genom upprepad träning och kan till exempel urskilja objekt eller bearbeta talat språk.

Sedan flera år tillbaka har fysiker försökt använda neurala nätverk för att upptäcka fasövergångar också. Fasövergångar är bekanta för oss från vardagliga erfarenheter, till exempel när vatten fryser till is, men de sker också i mer komplex form mellan olika faser av magnetiska material eller kvantsystem, där de ofta är svåra att upptäcka.

Julian Arnold och Frank Schäfer, två Ph.D. studenter i forskargruppen av professor Dr. Christoph Bruder vid universitetet i Basel, har nu på egen hand härlett matematiska uttryck med vilka sådana fasövergångar kan upptäckas snabbare än tidigare. De publicerade nyligen sina resultat i Physical Review X .

Hoppa över utbildning sparar tid

Ett neuralt nätverk lär sig genom att systematiskt variera parametrar i många träningsomgångar för att få de förutsägelser som beräknas av nätverket att matcha träningsdata som matas in i det mer och mer. Den träningsdatan kan vara bildpunkterna eller i själva verket resultaten av mätningar på ett fysiskt system som uppvisar fasövergångar som man skulle vilja lära sig något om.

"Neurala nätverk har redan blivit ganska bra på att upptäcka fasövergångar", säger Arnold, "men exakt hur de gör det är vanligtvis helt oklart." För att förändra den situationen och skina lite ljus i ett neuralt nätverks "svarta låda" tittade Arnold och Schäfer på specialfallet med nätverk med ett oändligt antal parametrar som i princip också går igenom oändligt många träningsrundor.

Generellt har det varit känt under lång tid att förutsägelser av sådana nätverk alltid tenderar mot en viss optimal lösning. Arnold och Schäfer tog detta som en utgångspunkt för att härleda matematiska formler som gör att man direkt kan beräkna den optimala lösningen utan att egentligen behöva träna nätverket. "Den genväg minskar beräkningstiden enormt", förklarar Arnold:"Tiden det tar att beräkna vår lösning är bara så lång som en enda träningsomgång i ett litet nätverk."

Insikt i nätverket

Förutom att spara tid har den metod som utvecklats av Basel-fysikerna också fördelen att de härledda ekvationerna ger en viss inblick i hur de neurala nätverken fungerar och därmed de fysiska systemen som undersöks.

Hittills har Arnold och Schäfer testat sin metod på datorgenererad data. Snart vill man även tillämpa metoden på riktiga mätdata. I framtiden skulle detta kunna göra det möjligt att upptäcka ännu okända fasövergångar, till exempel i kvantsimulatorer eller i nya material. + Utforska vidare