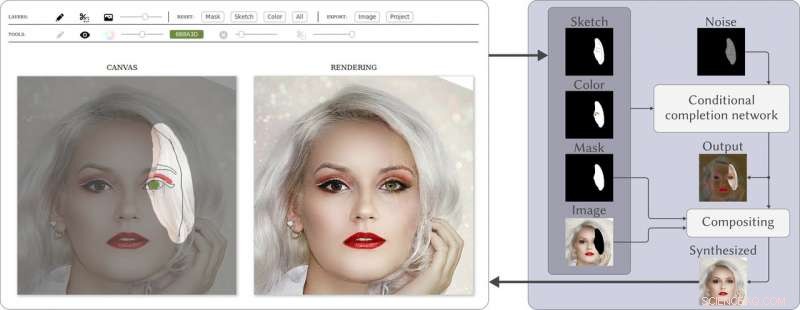

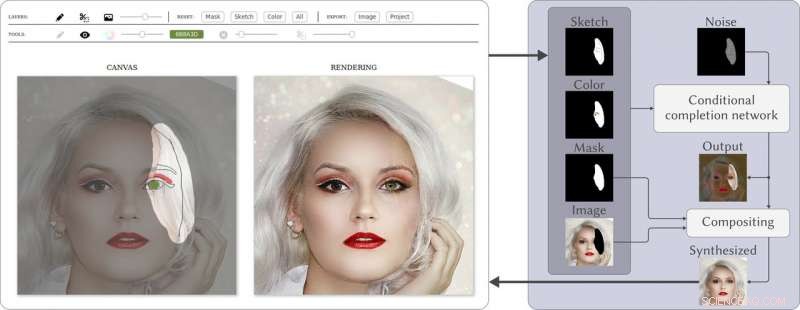

Faceshop består av ett webbaserat användargränssnitt (vänster) som gör det möjligt för en användare att ange en region som ska redigeras. Dessutom, användaren kan rita streck och färgklotter för att styra redigeringsprocessen. Kärnan i baksidan (höger) är ett nätverk för djup bildkomplettering som tar användarens input och originalbilden för att syntetisera det redigerade resultatet. Kredit:Tiziano Protenier

På populära sociala medieplattformar, användare lägger upp otaliga bilder varje dag. Bara på Instagram, det finns mer än 40 miljarder uppladdade foton – en siffra som skjuter i höjden med 95 miljoner dagligen. Detta ger ett tydligt behov av intuitiva men robusta fotoredigeringsverktyg som gör att den genomsnittliga användaren kan utföra avancerade redigeringsfunktioner.

Och även om det finns ett definitivt behov av interaktiv bildredigering med avseende på sociala medier, förbättrade redigeringsverktyg och system förblir också en viktig aspekt av datorgrafik och datorseende. Dock, det finns en brist på verktyg som har mer komplexa redigeringsfunktioner för oerfarna användare, som att ändra ansiktsuttrycket i ett foto.

Ett forskarlag, ledd av datavetare från University of Bern-Switzerland och University of Maryland-College Park, har utarbetat ett skissbaserat redigeringsramverk som gör det möjligt för en användare att redigera sina bilder genom att "skissa" några drag ovanpå dem. Deras system, kallas FaceShop, erbjuder även en copy-paste-funktion, som tillåter användare att redigera vilken del av ett foto som helst genom att kopiera och klistra in delen som ska redigeras från ett annat (bättre) foto, eliminerar behovet av att handrita eller skissa någonting alls.

Teamets tillvägagångssätt bygger på maskininlärningstekniker, som, i slutet, ge användarna mer kontroll över sina önskade redigeringar i realtid och producera mer realistiska resultat.

"De flesta andra tillvägagångssätt förlitar sig på mer traditionella, handgjorda tekniker, som medför vissa begränsningar. Till exempel, dessa system är antingen [av design] begränsade till begränsade uppsättningar av fördefinierade redigeringsoperationer, eller så är de väldigt flexibla men svåra att använda och kräver att erfarna användare lägger ner en avsevärd tid på att utföra ganska grundläggande redigeringar, " säger Tiziano Protenier, huvudförfattare till verket och Ph.D. kandidat vid universitetet i Bern. "I kontrast, vårt system är mycket flexibelt och låter otränade användare utföra komplexa redigeringar inom några minuter med hjälp av ett intuitivt gränssnitt."

Faceshop består av ett webbaserat användargränssnitt (vänster) som gör det möjligt för en användare att ange en region som ska redigeras. Dessutom, användaren kan rita streck och färgklotter för att styra redigeringsprocessen. Kärnan i baksidan (höger) är ett nätverk för djup bildkomplettering som tar användarens input och originalbilden för att syntetisera det redigerade resultatet. Kredit:Tiziano Protenier

Protenier utvecklade det nya systemet tillsammans med medarbetare Qiyang Hu, Attila Szabó, Siavash Arjomand Bigdeli och Paolo Favaro från universitetet i Bern, och Matthias Zwicker från University of Maryland. Teamet kommer att presentera sitt arbete på SIGGRAPH 2018, hölls 12-16 augusti i Vancouver, British Columbia. Denna årliga sammankomst visar upp världens ledande proffs, akademiker, och kreativa hjärnor i framkant av datorgrafik och interaktiva tekniker.

I deras tidning, "FaceShop:Deep Sketch-baserad ansiktsbildredigering, " forskarna demonstrerar sitt nya system genom flera exempel. I ett, en kvinnas näsa är något manipulerad, och ett hårstrå redigeras så att det trycks bort från hennes ansikte, ta bort en mörk skugga som hade dykt upp på bara ena sidan av hennes ansikte på originalfotot. Ett annat foto visar hur en användare kan förbättra en kvinnas ögonsmink och få fram färgen på hennes ögon. Exemplen som lyfts fram i tidningen visar hur det nya systemet fungerar, intuitivt, och producerar hög kvalitet, realistiska resultat.

Teamets metod är baserad på generativa adversariella neurala nätverk (GAN), en form av artificiell intelligens (AI) som, de senaste åren, har väckt stort forskningsintresse för sin förmåga att generera realistiska bilder. Dessa GAN består av två AI:er som kämpar mot varandra. Den första komponenten försöker skilja de genererade bilderna från äkta bilder, medan den andra komponenten försöker producera bilder som lurar den andra AI. Under träning, de två komponenterna lär sig av varandra, så småningom resulterade i ett system som självständigt lärde sig att producera realistiska bilder, utan något mänskligt omdöme i slingan.

Till skillnad från andra AI-drivna bildredigeringsmetoder, när systemet har tränats, användare har mer kontroll över redigeringarna av sina foton. "Vårt system har en optimal grad av kontroll, vilket gör det mycket intressant ur tillämpningssynpunkt, " noterar Portenier. "Andra tekniker som försöker införliva användarkontroll är antingen begränsade i omfattningen av möjliga redigeringar eller har visat sig fungera bra på den data som användes för att träna systemen, men misslyckas med att producera övertygande resultat med verklig användarinput. Vi presenterar en teknik som mildrar detta problem, vilket resulterar i ett system som fungerar förvånansvärt bra i praktiken."

I framtida arbete, forskarna har för avsikt att utforska ytterligare verktyg för användarinteraktion att lägga till deras ramverk, och fundera på hur man kan utnyttja AI för skissbaserad redigering av videor.