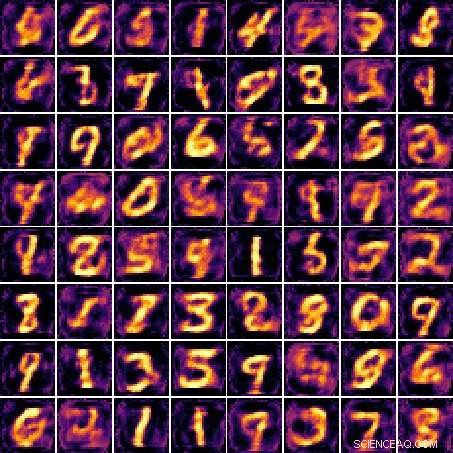

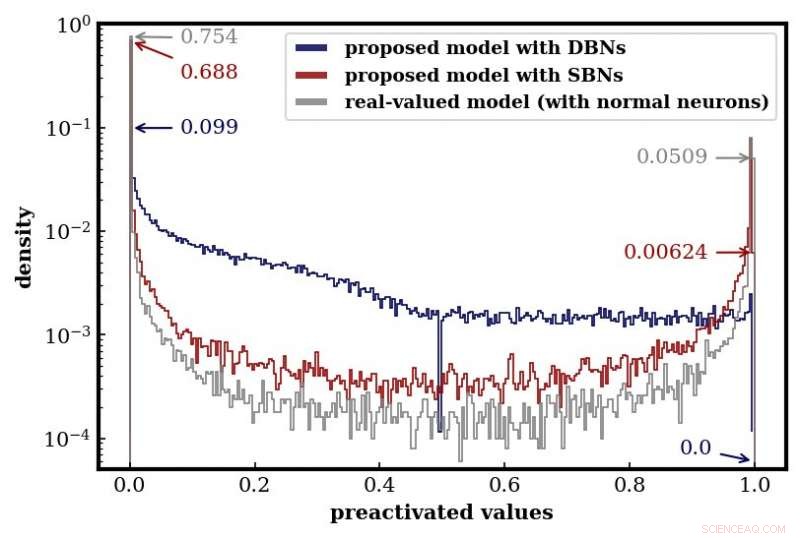

Föraktiverade utgångar (dvs. de verkligt värderade, mellanvärden precis före binariseringsoperationen; se avsnitt 2.2) för den föreslagna modellen implementerad av MLP:er och utbildad med WGAN-GP-målet. Föreslagen modell med DBN (föraktiverad). Kredit:Dong och Yang.

Forskare vid Research Centre for IT Innovation of Academia Sinica, I Taiwan, har nyligen utvecklat ett nytt generativt adversarialt nätverk (GAN) som har binära neuroner vid generatorns utgångsskikt. Den här modellen, presenterad i ett papper som för publicerats på arXiv, kan direkt generera binärvärderade förutsägelser vid testtiden.

Än så länge, GAN -tillvägagångssätt har uppnått anmärkningsvärda resultat när det gäller modellering av kontinuerliga distributioner. Ändå, att tillämpa GAN på diskreta data har hittills varit något utmanande, särskilt på grund av svårigheter att optimera modellfördelningen mot måldatadistributionen i ett högdimensionellt diskret utrymme.

Hao-Wen Dong, en av forskarna som genomförde studien, berättade Tech Xplore , "Jag arbetar för närvarande med musikgenerering i Music and AI Lab på Academia Sinica. Enligt min mening, att komponera kan tolkas som en serie beslut – t.ex. angående instrumentering, ackord och till och med exakta toner som ska användas. För att gå mot att uppnå den stora visionen om en solid AI-kompositör, Jag är särskilt intresserad av om djupa generativa modeller som GAN:er kan fatta beslut. Därför, detta arbete undersökte om vi kan träna en GAN som använder binära neuroner för att fatta binära beslut med hjälp av backpropagation, standard träningsalgoritm. "

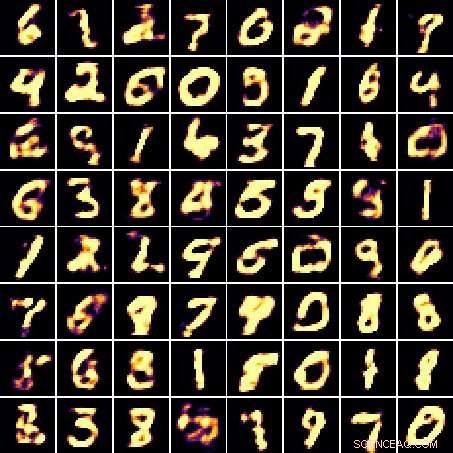

Dong och hans rådgivare Yi-Hsuan Yang utvecklade en modell som direkt kan generera binärt värderade förutsägelser vid testtillfället. De använde det sedan för att generera binära MNIST-siffror och jämföra prestanda för olika typer av binära neuroner, GAN-mål och nätverksarkitekturer.

Provgenererade siffror och föraktiverade utdata (dvs. de verkligt värderade, mellanvärden precis före binariseringsoperationen; se avsnitt 2.2) för den föreslagna modellen implementerad av MLP:er och utbildad med WGAN-GP-målet. Föreslagen modell med SBN (föraktiverad). Kredit:Dong och Yang.

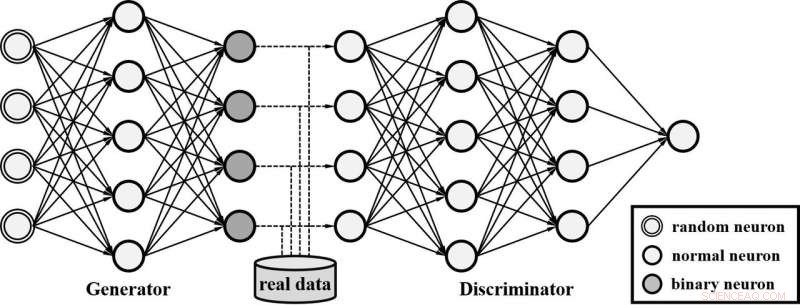

"I ett nötskal, BinaryGAN är ett GAN som antar binära neuroner, neuroner som matar ut antingen en etta eller en nolla, vid generatorns utgångsskikt, "Sade Dong." Ett GAN har två huvudkomponenter:generator och diskriminator. Generatorn syftar till att producera falska dataprover som kan lura diskriminatorn att klassificera genererade prover som verkliga. Å andra sidan, målet för diskriminatorn är att skilja falsk från verklig data. Återkopplingen från diskriminatorn används sedan för att förbättra generatorn. Efter utbildningen, generatorn kan sedan användas för att generera nya dataprov."

Forskarna kunde effektivt träna BinaryGAN, deras generativa modell med binära neuroner. Deras resultat tyder också på att användningen av gradientestimatorer kan vara ett lovande tillvägagångssätt för att modellera diskreta distributioner med GAN.

Histogram över de föraktiverade utgångarna för den föreslagna modellen och de probabilistiska förutsägelserna för den verkliga modellen. De två modellerna är båda implementerade av MLP:er och utbildade med WGAN-GP-målet. Kredit:Dong och Yang.

"Med användning av gradientestimatorer, vi kunde träna BinaryGAN, använder backpropagation-algoritmen, " sade Dong. "Dessutom, den binarisering som användes i modellen resulterade i distinkta egenskaper hos de mellanliggande representationerna som lärts av de djupa neurala nätverken. Detta understryker också vikten av att inkludera binariseringsoperationer i utbildningen, så att dessa binäriseringsoperationer också kan optimeras. "

Dong och Yang försöker nu tillämpa ett GAN som antar binära neuroner för att förverkliga en villkorlig beräkningsgraf. I det här fallet, vissa komponenter skulle aktiveras och avaktiveras, enligt de beslut som tas av nätverkets binära neuroner.

Systemdiagram över den föreslagna modellen implementerad av MLP:er. Observera att binära neuroner endast används vid utgångsskiktet av generatorn. Kredit:Dong och Yang.

"Detta är viktigt för det tillåter oss att bygga en mer komplex modell som bygger på beslut som fattas i tidiga lager av nätverket, " sa Dong. "Till exempel, vi skulle kunna bygga en AI -kompositör som lär sig att först bestämma instrumenteringen och ackorden och sedan komponera därefter. "

© 2018 Tech Xplore