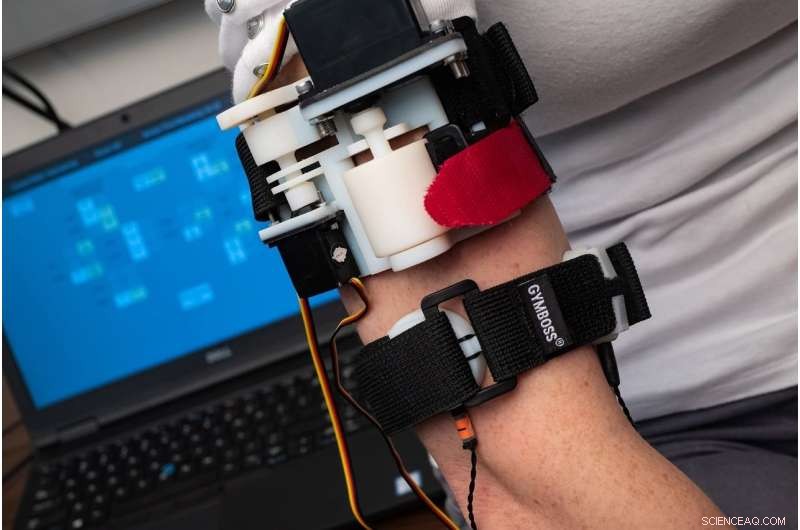

En ny studie av forskare från Rice University’s Mechatronics and Haptic Interfaces Laboratory fann att användare behövde mindre än två timmars utbildning för att lära sig ”känna” de flesta ord som överfördes av ett haptiskt armband som kommunicerar med signaler som består av kläm, stretch och vibrationer. Upphovsman:Jeff Fitlow/Rice University

Föreställ dig paniken. Brandlarm bläser. Rök fyller rummet, och du är kvar med känslan, känner sig desperat längs väggarna när du försöker hitta dörren.

Föreställ dig nu teknik som styr dig genom beröringskänsla. Din smartklocka, varnas av samma larm, börjar "tala" genom din hud, ger vägbeskrivning med kodade vibrationer, klämmer och drar med betydelser så tydliga som talade ord.

Det scenariot kan spela ut i framtiden tack vare teknik under utveckling i laboratoriet hos Rice -maskiningenjören Marcia O'Malley, som har ägnat mer än 15 år åt att studera hur människor kan använda haptiskt förnuft för att interagera med teknik - vare sig det är robotar, protetiska lemmar eller stroke-rehabiliteringsprogram.

"Huden täcker hela vår kropp och har många sorters receptorer i den, och vi ser det som en underutnyttjad informationskanal, "sade O'Malley, chef för Rice Robotics Initiative och Rices Mechatronics and Haptic Interfaces Laboratory (MAHI).

Nödsituationer som brandscenariot som beskrivs ovan är bara ett exempel. O'Malley sa att det finns många "andra situationer där du kanske inte vill titta på en skärm, eller du har redan visat många saker visuellt. Till exempel, en kirurg eller en pilot kan tycka att det är mycket användbart att ha en annan kommunikationskanal. "

Rice University doktorand Nathan Dunkelberger på jobbet i MAHI -labbet. Upphovsman:Jeff Fitlow/Rice University

Med nya medel från National Science Foundation, O'Malley och Stanford University kollaboratör Allison Okamura kommer snart att börja designa och testa mjuk, bärbara enheter som tillåter direkt beröringsbaserad kommunikation från robotar i närheten. Finansieringen, som möjliggörs av National Robotics Initiative, är inriktad på att utveckla nya kommunikationsformer som kringgår visuellt röran och brus för att snabbt och tydligt kommunicera.

"Vissa lager och fabriker har redan fler robotar än mänskliga arbetare, och teknik som självkörande bilar och fysiskt hjälpmedel kommer att göra interaktioner mellan människor och robotar mycket vanligare inom en snar framtid, "sade O'Malley, Rices Stanley C. Moore Professor i maskinteknik och professor i både datavetenskap och el- och datorteknik.

Mjuk, bärbara enheter kan vara en del av en uniform, som en ärm, handske, klockarmband eller bälte. Genom att leverera en rad haptiska signaler - som en hård eller mjuk klämning, eller en sträcka av huden i en viss riktning och plats, O'Malley sa att det kan vara möjligt att bygga ett betydande "ordförråd" av förnimmelser som har specifika betydelser.

"Jag kan se en bils blinkers, men bara om jag tittar på det, "O'Malley sa." Vi vill ha teknik som gör att människor kan känna robotarna runt omkring dem och tydligt förstå vad dessa robotar ska göra och var de ska vara. Helst, om vi gör detta korrekt, ledtrådarna kommer att vara lätta att lära sig och intuitiva. "

Rice University doktorander Jenny Sullivan (vänster) och Nathan Dunkelberger demonstrerar MISSIVE haptic armband i Mechatronics and Haptic Interfaces Laboratory. Upphovsman:Jeff Fitlow/Rice University

Till exempel, i en studie som presenterades denna månad på International Symposium on Wearable Computers (ISWC) i Singapore, MAHI -doktorand Nathan Dunkelberger visade att användare behövde mindre än två timmars utbildning för att lära sig "känna" de flesta ord som överfördes av ett haptiskt armband. Det MAHI-utvecklade "multi-sensoriska gränssnittet för stretch, klämma och integrerade vibrotaktila element, "eller MISSIV, består av två band som passar runt överarmen. En av dessa kan försiktigt klämma, som en blodtrycksmanschett, och kan också lätt sträcka eller dra huden i en riktning. Det andra bandet har vibrotaktila motorer - samma vibrationslarm som används i de flesta mobiltelefoner - längst fram, tillbaka, vänster och höger sida av armen.

Med dessa signaler i kombination, MAHI skapade ett ordförråd med 23 av de vanligaste röstljuden för engelsktalande. Dessa ljud, som kallas fonem, används i kombination för att skapa ord. Till exempel, orden "ouch" och "chow" innehåller samma två fonem, "ow" och "ch, "i olika ordning. O'Malley sa att kommunikationen med fonem är snabbare än att stava ord bokstav för bokstav, och ämnen behöver inte veta hur ett ord stavas, bara hur det uttalas.

Dunkelberger sa att engelsktalande använder 39 fonem, men för proof-of-concept-studien, han och kollegor på MAHI använde 23 av de vanligaste. I tester, ämnen fick begränsad utbildning - bara 1 timme, 40 minuter - vilket innebar att höra det talade fonemet samtidigt som det kändes som visat av MISSIVE. Vid senare tester, försökspersonerna ombads identifiera 150 talade ord som består av två till sex fonem vardera. De testade fick 86 procent av orden korrekta.

"Det här visar är att det är möjligt, med begränsad utbildning, att lära människor ett litet ordförråd med ord som de kan komma ihåg med hög noggrannhet, "Sade O'Malley." Och det finns definitivt saker vi kan optimera. Vi kan göra ledtrådarna mer framträdande. Vi kan förfina träningsprotokollet. Detta var vår prototyp, och det fungerade ganska bra. "

I NSF -projektet hon sa att laget inte kommer att fokusera på att förmedla ord, men förmedla icke-verbal information.

"Det finns många potentiella applikationer för bärbara haptiska återkopplingssystem för att möjliggöra kommunikation mellan individer, mellan individer och robotar eller mellan individer och virtuella agenter som Google maps, "O'Malley sa." Tänk dig en smartwatch som kan förmedla ett helt språk med signaler till dig direkt, och privat, så att du inte behöver titta på din skärm alls. "