Online hat raser fortfarande, ofta i klar syn. Kredit:maxicam/Shutterstock.com

Strax efter synagogan i Pittsburgh, Jag märkte att ordet "judar" var trendigt på Twitter. Som forskare och utbildare i sociala medier, Jag blev orolig för att våldet skulle spridas på nätet, som det har gjort tidigare.

Den påstådda synagogskjutarens aktivitet på Gabs sociala mediasajt har uppmärksammat den sajtens roll som ett hatfyllt alternativ till mer vanliga alternativ som Facebook och Twitter. De är bland de sociala medieplattformarna som har lovat att bekämpa hatretorik och onlinemissbruk på sina webbplatser.

Dock, när jag utforskade onlineaktivitet efter fotograferingen, det stod snabbt klart för mig att problemen inte bara finns på sajter som Gab. Snarare, hatretorik är fortfarande lätt att hitta på vanliga sociala medier, inklusive Twitter. Jag identifierade också några ytterligare åtgärder som företaget kunde vidta.

Ofullständiga svar på nya hattermer

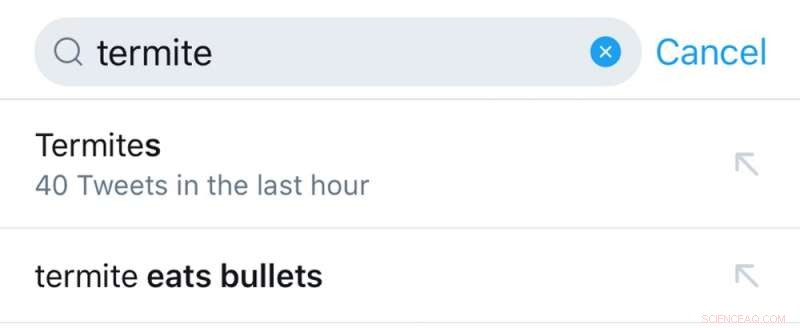

Jag förväntade mig att nya hot skulle dyka upp på nätet kring Pittsburgh -skjutningen, och det fanns tecken som höll på att hända. I en nyligen genomförd antisemitisk attack, Nation of Islam-ledaren Louis Farrakhan använde ordet "termit" för att beskriva judiska människor. Jag sökte efter denna term, att veta att rasister sannolikt kommer att använda det nya talet som ett kodord för att undvika upptäckt när de uttrycker antisemitism.

Twitter hade inte stängt av Farrakhans konto i kölvattnet av ännu ett av hans antisemitiska uttalanden, och Twitters sökfunktion föreslog automatiskt att jag kanske sökte efter frasen "termit äter kulor." Det förvandlar Twitters sökruta till en anslagstavla för hatretorik.

Företaget hade, dock, tydligen justerat några av dess interna algoritmer, eftersom inga tweets med antisemitisk användning av ordet "termit" dök upp i mina sökresultat.

Kredit:Jennifer Grygiel, CC BY-ND

Inlägg obemärkta i flera år

När jag fortsatte mina sökningar efter hatprat och uppmaningar till våld mot judiska människor, Jag hittade ännu mer oroande bevis på brister i Twitters innehållsmodereringssystem. I kölvattnet av det amerikanska valet 2016 och upptäckten att Twitter användes för att påverka valet, företaget sa att det investerar i maskininlärning för att "upptäcka och mildra effekten på användare av falska, samordnade, och automatiserad kontoaktivitet. "Baserat på vad jag hittade, dessa system har inte identifierat ens mycket enkla, tydliga och direkta våldsamma hot och hatretorik som har funnits på dess sajt i flera år.

När jag rapporterade en tweet som postades 2014 som förespråkade att döda judar "för skojs skull, "Twitter tog ner det samma dag – men dess standardautomatiska Twitter-meddelande gav ingen förklaring till varför den hade lämnats orörd i mer än fyra år.

Hatar spel systemet

När jag granskade hatiska tweets som inte hade fångats efter alla dessa år, Jag märkte att många inte innehöll någon text – tweeten var bara en bild. Utan text, tweets är svårare för användare, och Twitters egna hatidentifierande algoritmer, att hitta. Men användare som specifikt letar efter hatretorik på Twitter kan sedan bläddra igenom aktiviteten på kontona de hittar, ser ännu mer hatiska meddelanden.

Twitter verkar vara medvetet om detta problem:Användare som rapporterar en tweet uppmanas att granska några andra tweets från samma konto och skicka dem samtidigt. Detta kommer att ge mer innehåll att granska, men lämnar fortfarande utrymme för några att förbli oupptäckta.

Hjälp till kämpande teknikjättar

När jag hittade tweets som jag trodde bröt mot Twitters policyer, Jag anmälde dem. De flesta av dem togs bort snabbt, även inom en timme. Men vissa uppenbarligen kränkande inlägg tog så lång tid som flera dagar att komma ner. Det finns fortfarande några textbaserade tweets som inte har tagits bort, trots att det klart bryter mot Twitters policy. Det visar att företagets process för innehållsgranskning inte är konsekvent.

Ett exempel på en hatisk tweet som får vara kvar på Twitter i mer än fyra år. Kredit:Jennifer Grygiel, CC BY-ND

Det kan tyckas som att Twitter blir bättre på att ta bort skadligt innehåll och att det tar bort mycket innehåll och memes och stänger av konton, men mycket av den aktiviteten är inte relaterad till hatretorik. Snarare, mycket av Twitters uppmärksamhet har varit på vad företaget kallar "samordnad manipulation, " som bots och nätverk av falska profiler som drivs av statliga propagandaenheter.

Från min synvinkel, företaget kan ta ett betydande steg för att be om hjälp från allmänheten, såväl som forskare och experter som mina kollegor och jag, för att identifiera hatiskt innehåll. Det är vanligt att teknikföretag – inklusive Twitter – erbjuder betalningar till personer som rapporterar säkerhetsbrister i sin programvara. Dock, Allt företaget gör för användare som rapporterar problematiskt innehåll är att skicka ett automatiskt genererat meddelande som säger "tack". Skillnaden i hur Twitter behandlar kodproblem och innehållsrapporter ger ett budskap om att företaget prioriterar sin teknik framför sitt community.

Istället, Twitter kan betala människor för att rapportera innehåll som visar sig bryta mot dess riktlinjer, erbjuda ekonomiska belöningar för att utrota de sociala sårbarheterna i sitt system, precis som om dessa användare hjälpte det att identifiera mjukvaru- eller hårdvaruproblem. En Facebook-chef uttryckte oro över att denna potentiella lösning skulle kunna slå tillbaka och generera mer onlinehat, men jag tror att belöningsprogrammet kan struktureras och utformas på ett sätt för att undvika det problemet.

Mycket mer att göra

Det finns ytterligare problem med Twitter som går utöver vad som publiceras direkt på den egna webbplatsen. Människor som lägger upp hatretorik drar ofta nytta av en nyckelfunktion hos Twitter:möjligheten hos tweets att inkludera länkar till annat internetinnehåll. Den funktionen är central för hur människor använder Twitter, dela innehåll av ömsesidigt intresse från hela webben. Men det är också en metod för att distribuera hatprat.

Till exempel, en tweet kan se helt oskyldig ut, säger "Det här är roligt" och ger en länk. Men länken – till innehåll som inte publicerats på Twitters servrar – ger ett hatfyllt meddelande.

Dessutom, Twitters innehållsmodereringssystem tillåter bara användare att rapportera hatiska och hotfulla tweets – men inte konton vars profiler själva innehåller liknande meddelanden. Några av dessa konton - inklusive sådana med profilbilder av Adolf Hitler, och namn och Twitter-handtag som förespråkar att judar bränns – posta inte ens tweets eller följ andra Twitter-användare. Ibland kan de helt enkelt existera för att hittas när människor söker efter ord i sina profiler, återigen förvandlar Twitters sökruta till ett leveranssystem. Dessa konton kan också – även om det är omöjligt att veta – användas för att kommunicera med andra på Twitter via direktmeddelande, använder plattformen som en hemlig kommunikationskanal.

Utan tweets eller annan offentlig aktivitet, det är omöjligt för användare att rapportera dessa konton via standardsystemet för innehållsrapportering. Men de är lika stötande och skadliga – och måste utvärderas och modereras precis som annat innehåll på sajten. När människor som försöker sprida hat blir allt mer sofistikerade, Twitters riktlinjer för communityn – men ännu viktigare dess genomförandeinsatser – måste komma ikapp, och häng med.

Om sociala medier vill undvika att bli – eller förbli – vektorer för informationskrigföring och plågor av hatiska idéer och memer, de måste öka mycket mer aktivt och, åtminstonde, låta sina tusentals heltidsanställda för innehållsmoderering söka som en professor gjorde under en helg.

Den här artikeln är återpublicerad från The Conversation under en Creative Commons-licens. Läs originalartikeln.