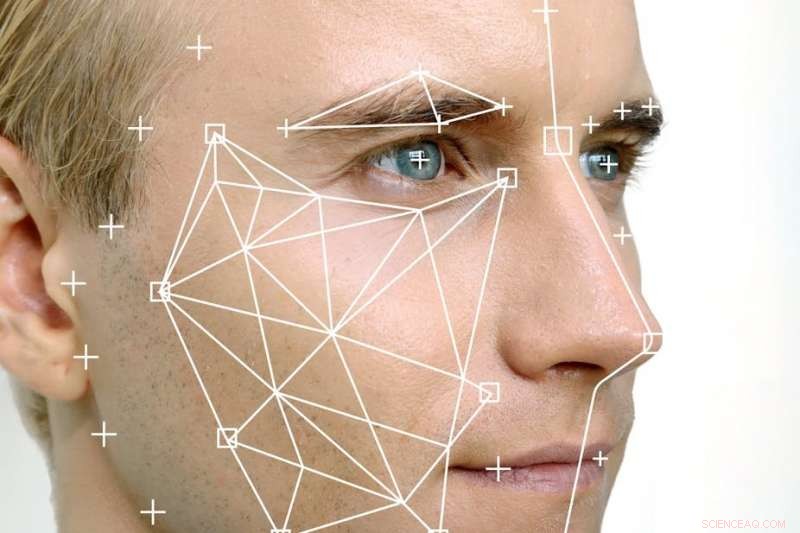

Det finns många frågor om hur ansiktsigenkänningsteknik kan påverka människors integritetsrättigheter och om det kommer att förvärra diskriminering i polisarbete. Upphovsman:Shutterstock

Användningen av automatiserad teknik för ansiktsigenkänning (FRT) blir allt vanligare globalt, särskilt i Kina, Storbritannien och nu Australien.

FRT betyder att vi kan identifiera individer baserat på en analys av deras geometriska ansiktsdrag, göra en jämförelse mellan en algoritm skapad från den tagna bilden och en som redan är lagrad, som körkort, förvaringsbild eller konto på sociala medier.

FRT har många privata och offentliga applikationer när identitetsverifiering behövs. Dessa inkluderar tillgång till ett säkert område, låsa upp en mobil enhet eller gå ombord på ett plan. Det kan också känna igen folks humör, reaktioner och, tydligen, sexualitet.

Och det är mer värdefullt för polisarbete än vanliga CCTV -kameror eftersom det kan identifiera individer i realtid och länka dem till lagrade bilder. Detta är av enormt värde för staten i brottsutredningar, terrorismbekämpning och gränskontroll.

Hur det påverkar rättigheterna till integritet

Men distributionen av FRT, som redan används av AFP och statspolisstyrkor och av privata företag på andra håll (flygplatser, idrottsplatser, banker och köpcentrum), är underreglerat och baserat på tvivelaktiga algoritmer som inte är offentligt transparenta.

Denna teknik har stora konsekvenser för människors integritetsrättigheter, och dess användning kan förvärra befintliga fördomar och diskriminering i polisförfaranden.

Användningen av FRT påverkar integritetsrättigheterna genom att skapa en algoritm med unika personliga egenskaper. Detta i sin tur reducerar människors egenskaper till data och möjliggör deras övervakning och övervakning. Dessa data och bilder kommer också att lagras under en viss tid, öppnar möjligheten att hacka eller bedra.

Dessutom, FRT kan utsätta människor för potentiell diskriminering på två sätt. Först, statliga myndigheter kan missbruka tekniken i förhållande till vissa demografiska grupper, vare sig det är avsiktligt eller på annat sätt.

Och för det andra, forskning tyder på att etniska minoriteter, färgade människor och kvinnor felidentifieras av FRT i högre takt än resten av befolkningen. Denna felaktighet kan leda till att medlemmar i vissa grupper utsätts för hårdhänt polis eller säkerhetsåtgärder och att deras data sparas olämpligt.

Detta är särskilt relevant i förhållande till samhällen som redan är oproportionerligt riktade mot Australien.

Vad lagstiftare försöker göra

Parlamentet har utarbetat ett lagförslag i ett försök att reglera detta utrymme, men det lämnar mycket att önska. Lagförslaget är för närvarande vid andra behandlingen; inget datum har fastställts för omröstning.

Om godkänt, lagförslaget skulle möjliggöra utbyte av identitetsinformation mellan Commonwealth -regeringen, statliga och territoriella regeringar och "icke-statliga enheter" (som inte har specificerats) genom skapandet av ett centralt nav som heter "The Capability", samt National Driver License Facial Recognition Solution, en databas med information som finns i statliga identitetshandlingar, som körkort.

Lagförslaget skulle också bemyndiga avdelningen för inrikes frågor att samla in, använda och dela identifieringsinformation i samband med en rad aktiviteter, såsom förebyggande av bedrägerier, rättsväsende, samhällssäkerhet, och trafiksäkerhet.

Det skulle vara mycket föredraget att sådan lagstiftning endast tillåter identitetsdelning för ett begränsat antal allvarliga brott. Som skrivet, detta lagförslag gäller personer som inte har dömts för brott - och faktiskt, behöver inte misstänkas för något brott.

Också, det australiensiska folket har inte samtyckt till att deras data delas på detta sätt. Sådan delning skulle ha en oproportionerlig effekt på vår rätt till integritet.

Viktigt, kränkningen av rätten till integritet förvärras av det faktum att lagförslaget skulle göra det möjligt för den privata sektorn att få tillgång till identitetstjänsterna. Även om den privata sektorn redan använder bildjämförelse och verifieringsteknik till viss del, som av banker som försöker upptäcka penningtvätt till exempel, lagförslaget skulle förlänga detta. Lagförslaget ger inte tillräckliga skyddsåtgärder eller påföljder för privata enheter om de använder navet eller människors uppgifter på ett olämpligt sätt.

Förekomsten av falskt positiva i identitetsmatchningar

I praktisk mening, Det finns också oro över tillförlitligheten och noggrannheten hos FRT, som utvecklas snabbt men inte är utan större problem. Om dessa problem bara är buggar eller en funktion i FRT återstår att se.

Erfarenheter från Storbritannien illustrerar dessa frågor tydligt. Polisen i södra Wales, den brittiska nationella ledningen för teknik för ansiktsigenkänning, använde systemet som utvecklats av ett privat australiensiskt företag som heter Neoface vid 18 offentliga sammankomster mellan maj 2017 och mars 2018. Det fann att 91% av matchningarna, eller 2, 451 instanser, felaktigt identifierade oskyldiga medlemmar av allmänheten som på en bevakningslista. Manuell övervakning av programmet avslöjade att matchningarna var falskt positiva.

London Metropolitan Police driver också en FRT -pilot. Det registrerade något bättre siffror, men hade fortfarande en falsk-negativ identifieringsgrad på 30% vid Notting Hill Carnival och 22% på Remembrance Day, båda 2017.

De privata företagens centrala roll i utvecklingen av denna teknik är också viktigt att flagga. FRT -algoritmer är patenterade, och det finns ingen allmänt tillgänglig indikation på mätningen eller standarden som representerar en identitet "matchning".

Lagstiftning i en snabb rörelse, Tekniskt drivet utrymme är inte en avundsvärd uppgift. Det finns en viss fördel med en viss flexibilitet i juridiska definitioner och regler så att lagen inte blir statisk och överflödig för tidigt. Men även den mest generösa tolkningen av lagförslaget skulle erkänna att det är ett felaktigt sätt att reglera användningen av en kraftfull och problematisk teknik som är här för att stanna, gillar det eller inte.

Denna artikel publiceras från The Conversation under en Creative Commons -licens. Läs originalartikeln.