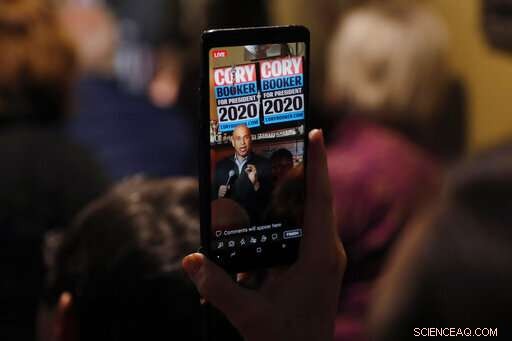

I denna 9 februari, 2019, fil foto, Sen. Cory Booker, D-N.J., ses i en mobiltelefon när han pratar under ett möte och hälsar med lokala invånare i Marshalltown, Iowa. Kongressen börjar visa intresse för att bända upp den "svarta lådan" av teknikföretags artificiella intelligens ungefär på samma sätt som den federala regeringen kontrollerar under bilhuvar och granskar banker. Ett förslag presenterades på onsdagen, 19 april, och medsponsrad av Booker, skulle kräva att stora företag testar den "algoritmiska ansvarsskyldigheten" för sina högrisk-AI-system, såsom teknik som upptäcker ansikten eller fattar viktiga beslut baserat på dina mest känsliga personuppgifter. (AP Photo/Charlie Neibergall, Fil)

Kongressen börjar visa intresse för att bända upp den "svarta lådan" av teknikföretags artificiella intelligens med tillsyn som liknar hur den federala regeringen kontrollerar under bilhuvar och granskar banker.

Ett förslag som presenterades på onsdagen och medsponsrat av en demokratisk presidentkandidat, Sen. Cory Booker, skulle kräva att stora företag testar den "algoritmiska ansvarsskyldigheten" för sina högrisk-AI-system, såsom teknik som upptäcker ansikten eller fattar viktiga beslut baserat på dina mest känsliga personuppgifter.

"Datorer är allt mer involverade i så många av de nyckelbeslut som amerikaner fattar med avseende på deras dagliga liv - om någon kan köpa ett hem, få ett jobb eller till och med gå i fängelse, ", sa senator Ron Wyden i en intervju med The Associated Press. Oregon-demokraten är med och sponsrar lagförslaget.

"När företagen verkligen går in i det här, de kommer att leta efter partiskhet i sina system, " sa Wyden. "Jag tror att de kommer att hitta mycket."

Demokraternas förslag är det första i sitt slag, och kan möta en uppförsbacke i den republikanskledda senaten. Men det återspeglar växande – och tvåpartisk – granskning av den i stort sett oreglerade dataekonomin – allt från flöden i sociala medier, datamäklare online, finansiella algoritmer och självkörande programvara som i allt högre grad påverkar vardagen. Ett lagförslag från två partier från senaten som infördes förra månaden skulle kräva att företag underrättar folk innan de använder mjukvara för ansiktsigenkänning på dem, samtidigt som det kräver testning från tredje part för att kontrollera om det finns biasproblem.

Akademiska studier och verkliga exempel har avslöjat ansiktsigenkänningssystem som felidentifierar mörkare kvinnor, datoriserade låneverktyg som tar ut högre räntor för latino- och svarta låntagare, och jobbrekryteringsverktyg som gynnar män i branscher där de redan dominerar.

I denna 20 mars, 2019, fotoarbetare tar bilder med sina telefoner när president Donald Trump talar på Joint Systems Manufacturing Center i Lima, Ohio. Kongressen börjar visa intresse för att bända upp den "svarta lådan" av teknikföretags artificiella intelligens ungefär på samma sätt som den federala regeringen kontrollerar under bilhuvar och granskar banker. President Donald Trumps administration lägger också märke till och har gjort utvecklingen av "pålitliga" algoritmer till en del av Vita husets nya AI-initiativ. (AP Photo/Michael Conroy, Fil)

"Det finns en myt att algoritmer är så här neutrala, objektiva saker, sa Aaron Rieke, verkställande direktör på påverkansgruppen Upturn. "Maskininlärning tar upp mönster i samhället - vem gör vad, vem köper vad, eller vem som har vilket jobb. Det är mönster som formats av problem som vi har brottats med i decennier."

President Donald Trumps administration lägger också märke till och har gjort utvecklingen av "säkra och pålitliga" algoritmer till ett huvudmål för Vita husets nya AI-initiativ. Men det skulle göra det mestadels genom att stärka en befintlig industridriven process för att skapa tekniska standarder.

"Det finns ett behov av större transparens och datajämförbarhet, "och för att upptäcka och minska bias i dessa system, sa handelssekreterare Walter Copan, som leder National Institute of Standards and Technology. "Konsumenter flyger i princip blinda."

Dussintals utvecklare för ansiktsigenkänning, inklusive varumärkesföretag som Microsoft, förra året lämnade in sina proprietära algoritmer till Copans byrå så att de kunde utvärderas och jämföras mot varandra. Resultaten visade betydande vinster i noggrannhet jämfört med tidigare år.

Men Wyden sa att de frivilliga normerna inte räcker.

"Självregleringen har helt klart misslyckats här, " han sa.

I denna 28 juni, 2018, filfoto Sen. Ron Wyden, D-Ore., rankad medlem av senatens finanskommitté, talar under en utfrågning på Capitol Hill i Washington. Kongressen börjar visa intresse för att bända upp den "svarta lådan" av teknikföretags artificiella intelligens med tillsyn som liknar hur den federala regeringen kontrollerar under bilhuvar och granskar banker. Ett förslag presenterades på onsdagen, 10 april, 2018 och medsponsrad av Wyden skulle kräva att stora företag testar den "algoritmiska ansvarsskyldigheten" för sina AI-system som hjälper till att fatta viktiga straffrättsliga beslut och påverkar människors tillgång till bostäder, kredit och jobb. (AP Photo/Jacquelyn Martin, Fil)

I ett djärvare drag från Trump-administrationen, det federala departementet för bostäder och stadsutveckling har anklagat Facebook för att tillåta hyresvärdar och fastighetsmäklare att systematiskt utesluta grupper som icke-kristna, invandrare och minoriteter från att se annonser för hus och lägenheter.

Bokare, i ett uttalande om sin räkning, sa att även om HUDs Facebook-åtgärd är ett viktigt steg, det är nödvändigt att gräva djupare för att ta itu med de "skadliga sätten" som diskriminering fungerar på tekniska plattformar, ibland oavsiktligt.

Booker sa att partiska algoritmer orsakar samma typ av diskriminerande fastighetspraxis som försökte styra hans föräldrar i New Jersey och andra svarta par bort från vissa amerikanska stadsdelar i slutet av 1960-talet. Den här gången, han sa, det är svårare att upptäcka och slåss.

Lagförslaget som han och Wyden har lagt fram skulle göra det möjligt för Federal Trade Commission att fastställa och genomdriva nya regler för företag att kontrollera om de är riktiga, partiskhet och potentiella integritets- eller säkerhetsproblem i deras automatiserade system, och korrigera dem om problem upptäcks. Det undantar mindre företag som tjänar mindre än 50 miljoner dollar per år, såvida de inte är datamäklare med information om minst 1 miljon konsumenter.

New Yorks demokratiska representant Yvette Clarke, som presenterar ett följeslag i kammaren, sa att målet är att fixa problem, inte bara för att bedöma dem. Hon sa att det är vettigt att ge FTC-myndigheten att regelbundet övervaka hur dessa system fungerar eftersom de "har fingret på pulsen om vad som händer med konsumenterna."

© 2019 The Associated Press. Alla rättigheter förbehållna.