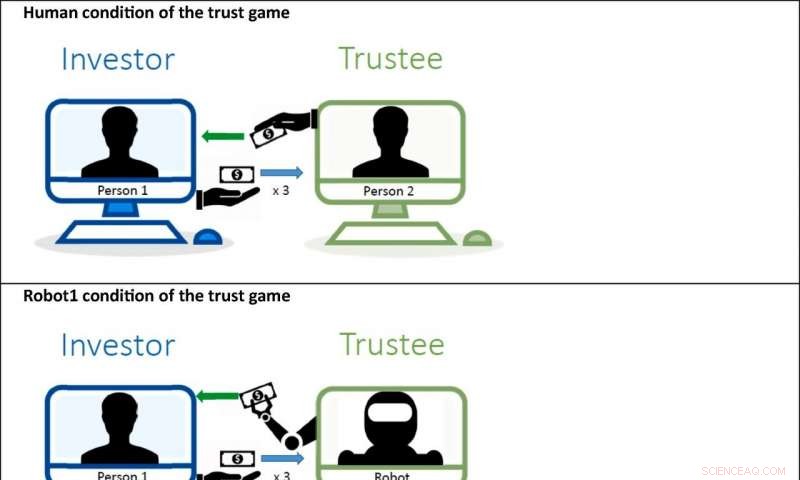

I det mänskliga tillståndet kopplas en mänsklig deltagare (person 1) i rollen som investerare ihop med en mänsklig deltagare (person 2) i rollen som förvaltare. I Robot1 -tillståndet kopplas en människa (person 1) i rollen som investerare ihop med en robot i rollen som förvaltare. I Robot2 -tillståndet kopplas en mänsklig deltagare (person 1) i rollen som investerare ihop med en robot i rollen som förvaltare som agerar på uppdrag av en passiv deltagare (person 2). Upphovsman:Chapman University

I forskning publicerad i Journal of Economic Psychology , forskare undersöker om människor litar på robotar som medmänniskor. Dessa interaktioner är viktiga att förstå eftersom tillitsbaserade interaktioner med robotar blir allt vanligare på marknaden, arbetsplats, på vägen och i hemmet. Resultaten visar att människor ökar förtroendet på samma sätt som människor och robotar, men människors känslomässiga reaktioner i tillitsbaserade interaktioner varierar beroende på partners typ.

Studien leddes av Chapman University Eric Schniter, Ph.D. och Timothy Shields, Ph.D. tillsammans med University of Montreal Daniel Sznycer, Ph.D.

Forskarna använde ett anonymt förtroende -spellexperiment under vilket en mänsklig förtroendevårdare bestämde hur mycket av en gåva på $ 10 att ge till en förvaltare - en människa, en robot, eller en robot vars utbetalningar går till en annan människa. Den mänskliga förtroendemannen vet att det fanns potentiella vinster från överföringen och förvaltaren skulle avgöra om han skulle återvända genom att överföra tillbaka ett belopp. Robotar programmerades för att efterlikna tidigare observerade ömsesidigheter från mänskliga förvaltare.

Det är väl etablerat att i förtroende spel som detta, de flesta människor fattar beslut som leder till både förtroende- och förvaltarförmån. Efter interaktionen, deltagarna betygsatte olika positiva och negativa känslor.

Den experimentella designen gjorde det möjligt för forskare att förklara två viktiga aspekter av tillit till förklarbara robotar:hur mycket människor litar på robotar jämfört med medmänniskor och mönster för hur människor reagerar känslomässigt efter interaktioner med robotar kontra andra människor.

Experimentet visar att människor utvidgar liknande förtroende till människor och robotar. Detta är inte vad vi skulle hitta om människor blint litade på eller vägrade lita på robotar. Detta skulle inte heller bli resultatet om vi tror att människor utvidgar förtroende med den enda avsikten att förbättra andra människors välfärd, eftersom att lita på en robot inte förbättrar en annans välfärd.

Resultatet överensstämmer med uppfattningen att människor ger förtroende för både monetär vinst och för att upptäcka information om mänskliga beteendemässiga benägenheter. Genom deras förtroendeinteraktioner med robotarna, deltagarna lärde sig om medmänniskors samarbetsförmåga.

Sociala känslor är mer än känslor - de reglerar socialt beteende. Mer specifikt, sociala känslor som skuld, tacksamhet, ilska, och stolthet påverkar hur vi behandlar andra och påverkar hur andra behandlar oss i tillitsbaserade interaktioner.

Deltagarna i detta experiment upplevde sociala känslor olika beroende på om deras partner var en robot eller människa. Ett misslyckande med att återgälda förtroendemannens investering i förvaltaren utlöste mer ilska när förvaltaren var en människa än när förvaltaren var en robot. Liknande, ömsesidighet utlöste mer tacksamhet när förvaltaren var en människa än när förvaltaren var en robot.

Ytterligare, deltagarnas känslor diskrimineras fint mellan robottyper. De rapporterade att de kände mer intensiv stolthet och skuld när robotförvaltarens utbetalning gick till en människa än när roboten agerade ensam.

Med tanke på att det ursprungliga förtroendet inte skilde sig från partnertyp, men sociala känslor gjorde det en tydlig möjlighet är att förtroendeutvidgning i upprepade interaktioner kommer att skilja sig när partnern är en människa, en robot, eller en robot kopplad till en mänsklig förmånstagare.

I framtiden, körning kommer att ge interaktionsmöjligheter där det spelar roll om beslut fattas av människor eller robotar och om de tjänar människor eller inte. Vissa bilar som används för leverans eller upphämtning kan köra utan människor, andra bilar kommer att köra med passiva människor och ännu andra bilar kommer att köras av mänskliga förare. Analoga interaktioner sker med automatiska eller robotiska incheckningsagenter, banktjänsteman, kirurger, etc.

Partnerskap med konsekventa återvändare kan konsolideras till starkare, mer produktiva partnerskap när reciprocatorerna är medmänniskor, eftersom människor väcker mer tacksamhet än robotar gör. Omvänt, partnerskap med inkonsekventa reciprocatorer kan vara mer stabila när reciprocatorerna är robotar, eftersom robotar väcker mindre ilska än människor gör. Ytterligare, människor upplevde stolthet och skuld mer intensivt i interaktioner där robotar tjänade en förmånstagare, vilket tyder på att människor kommer att vara mer benägna att återutöka förtroendet till liknande partners.

Den mänskliga kognitiva arkitekturen utvecklades till att ha tillräckligt med struktur och innehåll för att främja våra förfäders överlevnad och reproduktion samtidigt som de hade flexibiliteten att navigera i nya utmaningar och möjligheter. Dessa funktioner gör det möjligt för människor att utforma och rationellt interagera med artificiell intelligens och robotar. Fortfarande, interaktioner med automat, och vetenskapens förmåga att förklara dessa interaktioner är ofullkomliga eftersom automaterna saknar de psykofysiska ledtrådarna som vi förväntar oss i en interaktion och ofta styrs av oförklarliga eller ointuitiva beslutslogiker.