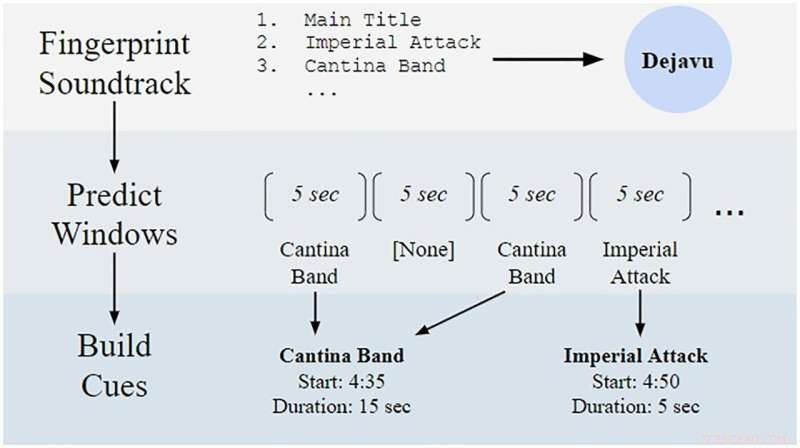

Fig 1. Score Stamper pipeline. En film är uppdelad i icke-överlappande femsekunderssegment. För varje segment kommer Dejavu att förutsäga om ett spår i filmens soundtrack spelas. Ledtrådar, eller instanser av en låts användning i en film, skapas genom att kombinera fönsterförutsägelser. I det här exemplet varar "Cantina Band"-signalen i 15 sekunder eftersom den förutspåddes av Dejavu i två närliggande fönster. Kredit:DOI:10.1371/journal.pone.0249957

Musik är ett oumbärligt element i film:den skapar atmosfär och stämning, driver tittarens känslomässiga reaktioner och påverkar avsevärt publikens tolkning av berättelsen.

I en ny artikel publicerad i PLOS ONE , ett forskarlag vid USC Viterbi School of Engineering, ledd av professor Shrikanth Narayanan, försökte objektivt undersöka musikens effekt på filmiska genrer. Deras studie syftade till att avgöra om AI-baserad teknik skulle kunna förutsäga genren för en film enbart baserat på soundtracket.

"Genom att bättre förstå hur musik påverkar tittarens uppfattning av en film, får vi insikter i hur filmskapare kan nå sin publik på ett mer övertygande sätt", säger Narayanan, universitetsprofessor och Niki och Max Nikias professor i teknik, professor i elektriska och datateknik och datavetenskap och chef för USC Viterbis Signal Analysis and Interpretation Laboratory (SAIL).

Uppfattningen att olika filmgenrer är mer benägna att använda vissa musikaliska element i sitt soundtrack är ganska intuitiv:en lättsam romans kan innehålla rika stråkpassager och frodiga, lyriska melodier, medan en skräckfilm istället kan innehålla oroande, genomträngande frekvenser och kusligt disharmoniska toner .

Men även om tidigare arbete kvalitativt indikerar att olika filmgenrer har sina egna uppsättningar av musikaliska konventioner – konventioner som får den där romansfilmen att låta annorlunda än den skräckfilmen – gav Narayanan och teamet sig för att hitta kvantitativa bevis för att delar av en films soundtrack skulle kunna användas för att karaktärisera filmens genre.

Narayanan och teamets studie var den första som tillämpade djupinlärningsmodeller på musiken som används i en film för att se om en dator kunde förutsäga genren för en film enbart baserat på soundtracket. De fann att dessa modeller kunde klassificera en films genre korrekt med hjälp av maskininlärning, vilket stöder uppfattningen att musikaliska egenskaper kan vara kraftfulla indikatorer för hur vi uppfattar olika filmer.

Enligt Timothy Greer, Ph.D. student vid USC Viterbi vid institutionen för datavetenskap som arbetade med Narayanan i studien, deras arbete kan ha värdefulla tillämpningar för medieföretag och kreatörer för att förstå hur musik kan förbättra andra former av media. Det skulle kunna ge produktionsbolag och musikövervakare en bättre förståelse för hur man skapar och placerar musik i tv, filmer, reklam och dokumentärer för att väcka vissa känslor hos tittarna.

Förutom Narayanan och Greer inkluderade forskargruppen för studien Dillon Knox, en Ph.D. student vid avdelningen för el- och datateknik, och Benjamin Ma, som tog examen från USC 2021 med en B.S. i datavetenskap, en magisterexamen i datavetenskap och en biämne i musikproduktion. (Ma utsågs också till en av de två 2021 USC Schwarzman Scholars.) Teamet arbetade inom Center for Computational Media Intelligence, en forskargrupp inom SAIL.

Förutsäga genre från soundtrack

I sin studie undersökte gruppen en datauppsättning av 110 populära filmer som släpptes mellan 2014 och 2019. De använde genreklassificering listad i Internet Movie Database (IMDb), för att märka varje film som action, komedi, drama, skräck, romantik eller vetenskap -fiktion, med många av filmerna som spänner över mer än en av dessa genrer.

Därefter tillämpade de ett nätverk för djupinlärning som extraherade den auditiva informationen, som klangfärg, harmoni, melodi, rytm och ton från musiken och partituren i varje film. Det här nätverket använde maskininlärning för att analysera dessa musikaliska funktioner och visade sig kunna klassificera genren för varje film enbart baserat på dessa funktioner.

Gruppen tolkade också dessa modeller för att avgöra vilka musikaliska egenskaper som var mest indikativa för skillnader mellan genrer. Modellerna gav inga detaljer om vilka typer av toner eller instrument som var förknippade med varje genre, men de kunde fastställa att tonala och klangliga egenskaper var viktigast för att förutsäga filmens genre.

"Att lägga den här grunden är verkligen spännande eftersom vi nu kan vara mer exakta i den typ av frågor som vi vill ställa om hur musik används i film", säger Knox. "Den övergripande filmupplevelsen är mycket komplicerad och att kunna beräkningsmässigt analysera dess inverkan och de val och trender som ingår i dess konstruktion är mycket spännande."

Framtida vägbeskrivningar

Narayanan och hans team undersökte den auditiva informationen från varje film med hjälp av en teknik som kallas ljudfingeravtryck, samma teknik som gör det möjligt för tjänster som Shazam att identifiera låtar från en databas genom att lyssna på inspelningar, även när det finns ljudeffekter eller annat bakgrundsljud. Denna teknik gjorde det möjligt för dem att titta på var de musikaliska signalerna händer i en film och hur länge.

"Att använda ljudfingeravtryck för att lyssna på allt ljud från filmen gjorde att vi kunde övervinna en begränsning av tidigare filmmusikstudier, som vanligtvis bara tittade på filmens hela soundtrackalbum utan att veta om eller när låtar från albumet dyker upp i filmen, " sa mamma. I framtiden är gruppen intresserade av att dra nytta av denna förmåga för att studera hur musik används i specifika ögonblick i en film och hur musikaliska signaler dikterar hur filmens berättelse utvecklas under dess gång.

"Med den ständigt ökande tillgången till både film och musik har det aldrig varit mer avgörande att kvantitativt studera hur denna media påverkar oss", sa Greer. "Att förstå hur musik fungerar i kombination med andra former av media kan hjälpa oss att skapa bättre tittarupplevelser och göra konst som är rörande och effektfull."