Kredit:Shutterstock/Sergey Tinyakov

Konstgjorda system som hemvårdsrobotar eller förarassistansteknik blir allt vanligare, och det är dags att undersöka om människor eller algoritmer är bättre på att läsa känslor, särskilt med tanke på den extra utmaning som ansiktsbeläggningar medför.

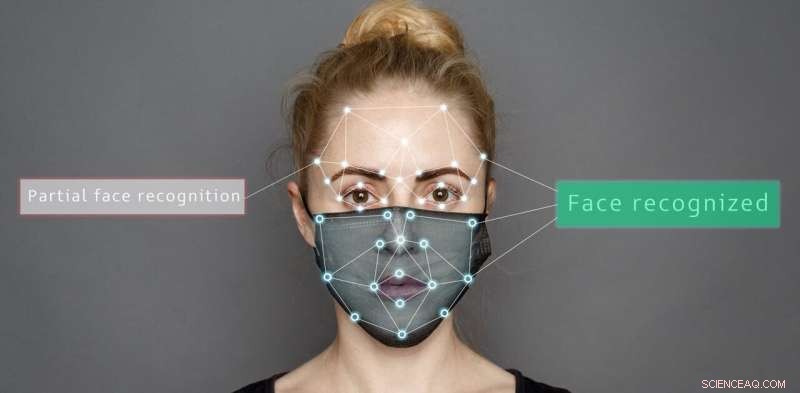

I vår senaste studie jämförde vi hur ansiktsmasker eller solglasögon påverkar vår förmåga att bestämma olika känslor jämfört med noggrannheten hos artificiella system.

Vi presenterade bilder av känslomässiga ansiktsuttryck och la till två olika typer av masker – helmasken som används av frontlinjearbetare och en nyligen introducerad mask med ett genomskinligt fönster för att möjliggöra läppavläsning.

Våra fynd visar algoritmer och människor kämpar båda när ansikten är delvis skymd. Men artificiella system är mer benägna att misstolka känslor på ovanliga sätt.

Konstgjorda system presterade betydligt bättre än människor i att känna igen känslor när ansiktet inte var täckt – 98,48 % jämfört med 82,72 % för sju olika typer av känslor.

Men beroende på typ av beläggning varierade noggrannheten för både människor och konstgjorda system. Till exempel döljde solglasögon rädsla för människor medan partiella masker hjälpte både människor och konstgjorda system att identifiera lyckan korrekt.

Viktigt är att människor klassificerade okända uttryck främst som neutrala, men artificiella system var mindre systematiska. De valde ofta felaktigt ilska för bilder som döljs med en hel mask, och antingen ilska, lycka, neutral eller överraskning för delvis maskerade uttryck.

Studien använde hel- och partiella masker och solglasögon för att skymma delar av ansiktet. Författare tillhandahålls

Avkoda ansiktsuttryck

Vår förmåga att känna igen känslor använder hjärnans visuella system för att tolka det vi ser. Vi har till och med ett område i hjärnan som är specialiserat på ansiktsigenkänning, känt som det fusiforma ansiktsområdet, som hjälper till att tolka information som avslöjas av människors ansikten.

Tillsammans med sammanhanget för en viss situation (socialt samspel, tal och kroppsrörelse) och vår förståelse av tidigare beteenden och sympati för våra egna känslor, kan vi avkoda hur människor känner.

Ett system med ansiktsåtgärdsenheter har föreslagits för att avkoda känslor baserat på ansiktssignaler. Den innehåller enheter som "kindhöjaren" och "läpphörnavdragaren", som båda anses vara en del av ett uttryck för lycka.

Däremot analyserar artificiella system pixlar från bilder av ett ansikte när de kategoriserar känslor. De skickar pixelintensitetsvärden genom ett nätverk av filter som efterliknar det mänskliga visuella systemet.

Upptäckten att konstgjorda system felklassificerar känslor från delvis mörka ansikten är viktigt. Det kan leda till oväntade beteenden hos robotar som interagerar med människor som bär ansiktsmasker.

Föreställ dig om de felklassificerar en negativ känsla, såsom ilska eller sorg, som ett positivt känslomässigt uttryck. De artificiella systemen skulle försöka interagera med en person som vidtar åtgärder på den missriktade tolkningen som de är nöjda med. Detta kan ha skadliga effekter för säkerheten för dessa konstgjorda system och interagerande människor.

Kan du läsa forskarnas känslor från deras täckta ansikten? Både artificiella system och människor kompromissar med att kategorisera känslor när ansikten är mörka. Författare tillhandahålls

Risker med att använda algoritmer för att läsa känslor

Vår forskning upprepar att algoritmer är mottagliga för fördomar i sina bedömningar. Till exempel påverkas prestanda hos artificiella system i hög grad när det gäller att kategorisera känslor från naturliga bilder. Även bara solens vinkel eller skugga kan påverka resultatet.

Algoritmer kan också vara rasistiska. Som tidigare studier har funnit, kan även en liten förändring av bildens färg, som inte har något att göra med känslomässiga uttryck, leda till att algoritmer som används i artificiella system minskar.

Som om det inte vore ett problem nog, kan även små visuella störningar, omärkliga för det mänskliga ögat, få dessa system att felidentifiera en ingång som något annat.

Vissa av dessa felklassificeringsproblem kan åtgärdas. Algoritmer kan till exempel utformas för att ta hänsyn till känslorelaterade funktioner som munformen, snarare än att hämta information från färgen och intensiteten hos pixlar.

Ett annat sätt att ta itu med detta är genom att ändra träningsdataegenskaperna – översampling av träningsdata så att algoritmer efterliknar mänskligt beteende bättre och gör mindre extrema misstag när de felklassificerar ett uttryck.

Men totalt sett sjunker prestandan för dessa system när bilder tolkas i verkliga situationer när ansikten är delvis täckta.

Även om robotar kan göra anspråk på högre än mänsklig noggrannhet i emotionsigenkänning för statiska bilder av helt synliga ansikten, i verkliga situationer som vi upplever varje dag, är deras prestanda fortfarande inte mänsklig.