Programvara och teknik kan behandla stora mängder data omedelbart, vilket gör dem mycket attraktiva för statlig användning. Kredit:Shutterstock

2019 sa tidigare FN:s specialrapportör Philip Alston att han var orolig för att vi "snabblade zombieliknande in i en digital välfärdsdystopi." Han hade forskat om hur statliga myndigheter runt om i världen vänder sig till automatiserade beslutssystem (ADS) för att minska kostnaderna, öka effektiviteten och rikta resurser. ADS är tekniska system utformade för att hjälpa eller ersätta mänskligt beslutsfattande med hjälp av algoritmer.

Alston var orolig av goda skäl. Forskning visar att ADS kan användas på sätt som diskriminerar, förvärrar ojämlikhet, inkräktar på rättigheter, sorterar in människor i olika sociala grupper, felaktigt begränsar tillgången till tjänster och intensifierar övervakningen.

Till exempel har familjer försatts i konkurs och tvingats in i kriser efter att ha blivit falskt anklagade för bidragsbedrägeri.

Forskare har identifierat hur ansiktsigenkänningssystem och riskbedömningsverktyg är mer benägna att felaktigt identifiera personer med mörkare hudtoner och kvinnor. Dessa system har redan lett till felaktiga arresteringar och felaktigt informerade straffbeslut.

Ofta får folk veta att de har påverkats av en ADS-applikation först när en av två saker händer:efter att saker går fel, som var fallet med A-nivåskandalen i Storbritannien; eller när kontroverser offentliggörs, vilket var fallet med användningen av teknik för ansiktsigenkänning i Kanada och USA.

Automatiska problem

Större transparens, ansvar, ansvarighet och allmänhetens engagemang i utformningen och användningen av ADS är viktigt för att skydda människors rättigheter och integritet. Det finns tre huvudorsaker till detta:

Vårt senaste forskningsprojekt, Automating Public Services:Learning from Cancelled Systems , ger resultat som syftar till att förhindra skada och bidra till meningsfull debatt och handling. Rapporten ger den första heltäckande översikten av system som ställs in i västerländska demokratier.

Att undersöka faktorerna och skälen som leder till att ADS-system avbryts hjälper oss att bättre förstå deras gränser. I vår rapport identifierade vi 61 ADS som avbröts i Australien, Kanada, Europa, Nya Zeeland och USA. Vi presenterar en detaljerad redovisning av system som avbrutits inom områdena bedrägeriupptäckt, barnskydd och polisarbete. Våra resultat visar vikten av noggrant övervägande och omsorg om rättvisa.

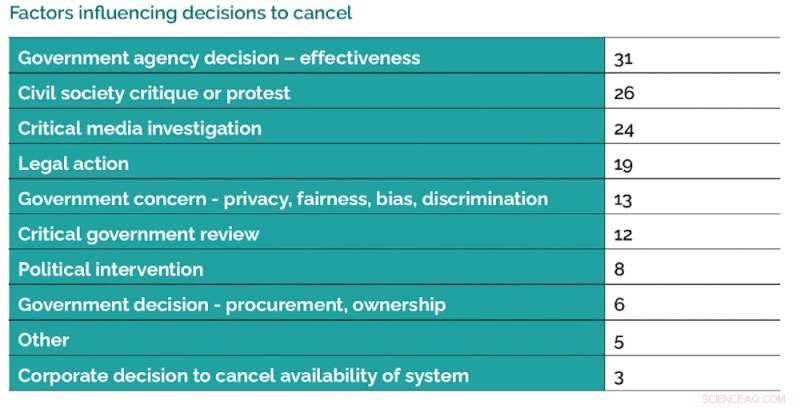

Det finns en rad faktorer som påverkar beslut att avbryta användningen av ADS-system. Kredit:Data Justice Lab, författare tillhandahållen

Skäl till avbokning

Det finns en rad faktorer som påverkar beslut att avbryta användningen av ADS. Ett av våra viktigaste resultat är hur ofta system avbryts eftersom de inte är så effektiva som förväntat. Ett annat nyckelresultat är den viktiga roll som samhällsmobilisering och forskning, utredningsrapportering och rättsliga åtgärder spelar.

Våra resultat visar att det finns konkurrerande förståelser, visioner och politik kring användningen av ADS.

Förhoppningsvis kommer våra rekommendationer att leda till ökat medborgardeltagande och förbättrad tillsyn, ansvarighet och förebyggande av skada.

I rapporten pekar vi på utbredda uppmaningar till regeringar att upprätta ADS-register med resurser som ett grundläggande första steg mot större öppenhet. Vissa länder som Storbritannien har uttalat planer på att göra det, medan andra länder som Kanada ännu inte har gått i denna riktning.

Våra resultat visar att användningen av ADS kan leda till större ojämlikhet och systemisk orättvisa. Detta förstärker behovet av att vara uppmärksam på hur användningen av ADS kan skapa olika system med fördelar och nackdelar.

Ansvarighet och transparens

ADS måste utvecklas med omsorg och ansvar genom att på ett meningsfullt sätt engagera sig i drabbade samhällen. Det kan få skadliga konsekvenser när statliga myndigheter inte engagerar allmänheten i diskussioner om lämplig användning av ADS före implementering.

Detta engagemang bör inkludera möjligheten för communitymedlemmar att bestämma områden där de inte vill att ADS ska användas. Exempel på god myndighetssed kan vara att ta sig tid att säkerställa att oberoende expertgranskningar och konsekvensanalyser som fokuserar på jämställdhet och mänskliga rättigheter genomförs.

Regeringar kan ta flera olika tillvägagångssätt för att implementera ADS-system på ett mer ansvarsfullt sätt. Kredit:Data Justice Lab, författare tillhandahållen

Vi rekommenderar att stärka ansvarsskyldigheten för dem som vill implementera ADS genom att kräva bevis på noggrannhet, effektivitet och säkerhet, samt granskning av laglighet. Åtminstone bör människor kunna ta reda på om en ADS har använt deras data och vid behov ha tillgång till resurser för att utmana och rätta till felaktiga bedömningar.

Det finns ett antal fall listade i vår rapport där statliga myndigheters samarbete med privata företag för att tillhandahålla ADS-tjänster har inneburit problem. I ett fall beslutade en statlig myndighet att inte använda ett borgenssystem eftersom systemets patentskyddade karaktär innebar att åtalade och tjänstemän inte skulle kunna förstå varför ett beslut fattades, vilket gjorde en effektiv utmaning omöjlig.

Statliga myndigheter måste ha resurser och kompetens för att noggrant undersöka hur de skaffar ADS-system.

En omsorgspolitik

Alla dessa rekommendationer pekar på vikten av en vårdpolitik. Detta kräver att de som vill implementera ADS förstår komplexiteten hos människor, samhällen och deras rättigheter.

Nyckelfrågor måste ställas om hur användningen av ADS leder till blinda fläckar på grund av hur de ökar avståndet mellan administratörer och de människor som de är avsedda att tjäna genom poängsättning och sorteringssystem som förenklar, sluter sig till skuld, felaktigt riktar in sig på och stereotypa personer. genom kategoriseringar och kvantifieringar.

God praxis, i termer av en vårdpolitik, innebär att man tar sig tid att noggrant överväga de potentiella effekterna av ADS innan implementering och att vara lyhörd för kritik, säkerställa kontinuerlig tillsyn och granskning och att söka oberoende granskning och granskning av samhället. + Utforska vidare

Den här artikeln är återpublicerad från The Conversation under en Creative Commons-licens. Läs originalartikeln.