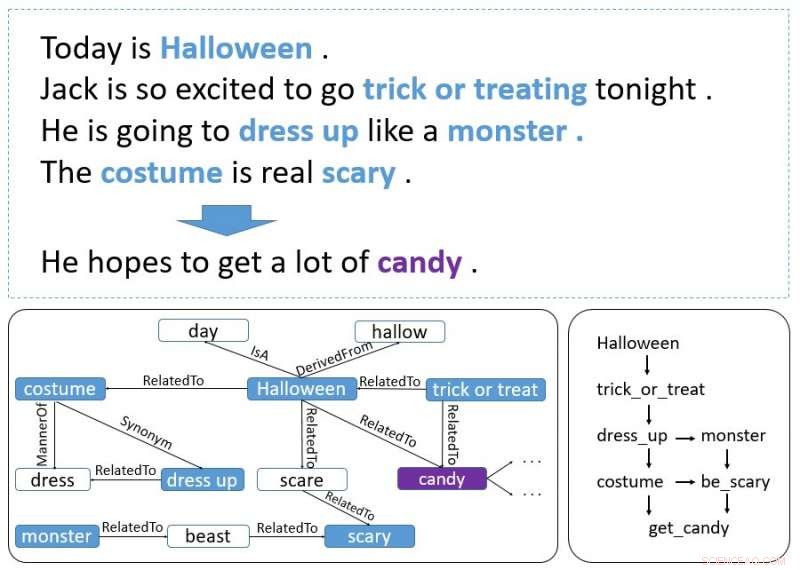

Ett berättelseexempel. Ord i fetstil är händelser och enheter. Den nedre vänstra grafen hämtas från ConceptNet och den nedre högra grafen representerar hur händelser och entiteter bildar kontextledtråden. Kredit:Guan, Wang och Huang

Forskare vid AI Lab vid Tsinghua University har nyligen utvecklat en inkrementell kodarbaserad modell som kan generera berättelseslut. En inkrementell kodare är en typ av kodningskomprimeringsalgoritm som ofta används för att komprimera sorterad data, som listor med ord eller meningar.

Den nya modellen, beskrivs i en tidning som förpublicerats på arXiv, använder ett inkrementellt kodningsschema med uppmärksamhet från flera källor för att bearbeta kontextledtrådar som spänner över en berättelse, skapa ett lämpligt slut.

Initialt, forskarna var intresserade av Story Cloze Test (SCT), där ett system väljer ett korrekt slut för en berättelse av två tillgängliga möjligheter. Tidigare forskning fokuserade på detta speciella test för att utveckla verktyg för att skapa berättelseavslut, men den senaste studien tar denna idé ett steg längre.

"Vi trodde, varför inte utveckla en modell som kan skapa ett slut på egen hand? Så vi kom på uppgiften att skapa berättelseavslut, "Yansen Wang, en av forskarna som genomförde studien berättade för TechXplore. "Dock, snart, vi fann att att skapa ett rimligt berättelseslut är en mycket mer utmanande uppgift än den ursprungliga eftersom det kräver att fånga logik- och kausalitetsinformation som kan sträcka sig över flera meningar i en berättelsekontext. Att använda sunt förnuft är också nödvändigt i denna uppgift, vilket inte är lika viktigt om två möjliga slut ges."

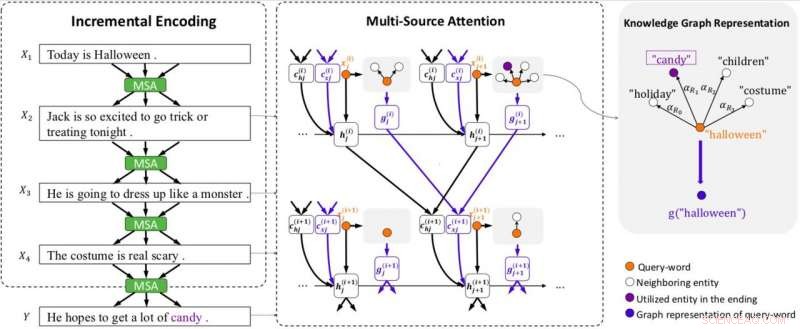

Modellöversikt. Modellen är utrustad med inkrementell kodning (IE) och multi-source uppmärksamhet (MSA) (inklusive grafisk uppmärksamhet för att representera kunskapsgrafer). MSA producerar tillståndskontextvektorer (c(i)hj) genom att ta hand om de dolda tillstånden (h(i)j), och kunskapskontextvektorer (c (i) xj ) genom att ta hänsyn till grafvektorer (g (i) j ) i föregående mening. IE använder tillstånds- och kunskapskontextvektorerna för att bygga kontextkodningar stegvis. Varje graf representeras av en vektor (g (i) j ) som använder grafens uppmärksamhet. x (i) j betecknar det j:te ordet i mening i. Kredit:Guan, Wang och Huang

För att möta dessa två utmaningar, forskarna utvecklade ett inkrementellt kodningsschema med en uppmärksamhetsmekanism med flera källor som kan generera effektiva berättelseslut. Detta system fungerar genom att koda en berättelses kontext stegvis, med sin uppmärksamhetsmekanism med flera källor som använder både kontextledtrådar och kunskap om sunt förnuft.

"Det inkrementella kodningsschemat vi utvecklade kan koda de tidigare tillstånden som innehåller information och relationer mellan ord stegvis, " Wang sade. "Mekanismen för uppmärksamhet med flera källor kommer att hitta och fånga den kronologiska ordningen eller orsakssambandet mellan enheter eller händelser i angränsande meningar. För att använda sunt förnuft kunskap, en chef för multi-source uppmärksamhet kommer att peka på en logisk representation av ord, som innehåller sunt förnuft kunskap hämtad från ConceptNet."

Att designa denna modell visade sig vara en svår och komplex uppgift, eftersom flera utmaningar måste övervinnas för att säkerställa att systemet gav vettiga avslut. Faktiskt, ett effektivt slut på berättelsen bör ta hänsyn till flera aspekter av berättelsen, passar väl in i dess sammanhang och är också rimligt vettigt.

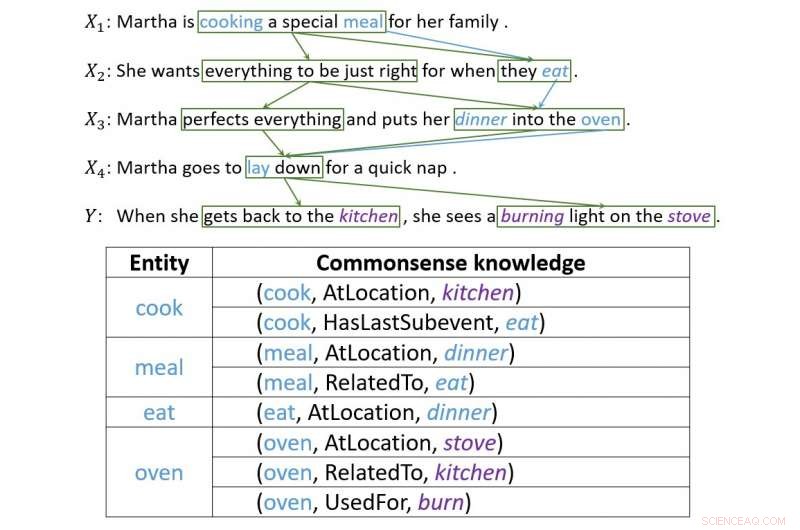

"Generering av berättelser kräver att man fångar informationens logik och kausalitet, " Wang förklarade. "Den här typen av information är inte bara punkt-till-punkt. I de flesta fallen, den bildar en mer komplex struktur, som folk kallar "kontext ledtråd". Vi ägnade mycket tid åt att designa vår modell, sedan kom det inkrementella kodningsschemat upp. Uppmärksamheten mellan meningar bildar naturligtvis en nätliknande struktur, och den logiska informationen som skickas av uppmärksamheten är precis vad vi ville ha."

Ett exempel som illustrerar hur inkrementell kodning bygger kopplingar mellan sammanhangsledtrådar. Kredit:Guan, Wang och Huang

Forskarna utvärderade sin modell och jämförde den med andra system för berättelseavslutning. De fann att det kunde generera mycket mer lämpliga och rimliga berättelseslut än toppmoderna baslinjer.

"När man testar modellen, vi uppnådde charmiga resultat, " sa Wang. "I följande experiment, vi fann också att detta system kunde skicka mer information, inklusive sunt förnuft kunskap, bara om vi kan representera denna typ av information på rätt sätt. Detta visar flexibiliteten i vårt system."

Modellen designad av Wang och hans kollegor bevisar hur långt den senaste tekniken kan gå, även i uppgifter som hittills i första hand utförts av människor. Även om det har uppnått mycket lovande resultat, forskarna anser att det fortfarande finns stort utrymme för förbättringar.

"Vi försöker nu tillämpa detta ramverk på längre berättelsekorpus, eftersom längden på berättelserna i SCT inte är för långa, sade Wang. Dessutom eftersom ramverket för inkrementell kodning kan bära olika typer av information, vi försöker tillämpa det på andra typer av uppgifter som involverar långsiktig informationsöverföring, till exempel generering av konversationer i flera svängar."

© 2018 Tech Xplore