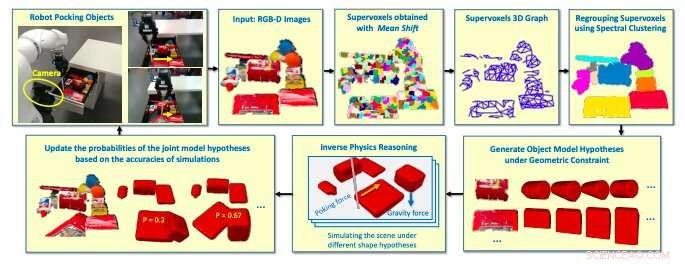

Arbetsflöde för det integrerade systemet. Kredit:Song &Boularias.

Forskare vid Rutgers University har nyligen utvecklat en probabilistisk metod för att bygga 3D-modeller av okända objekt medan de manipuleras av en robot. Deras tillvägagångssätt, beskrivs i ett papper som för publicerats på arXiv, använder en fysikmotor för att verifiera antagna geometrier i simuleringar.

De flesta primater lär sig naturligtvis att manipulera en mängd olika föremål under sina första år av livet. Att replikera denna till synes triviala förmåga i robotar, dock, har hittills visat sig vara mycket utmanande.

Tidigare studier har försökt uppnå detta med en mängd olika manipulationsalgoritmer, som vanligtvis kräver kunskap om de geometriska modeller som är associerade med objekten som roboten kommer att manipulera. Dessa modeller kan vara användbara om objekten som roboten stöter på är kända i förväg, ändå misslyckas de ofta när dessa objekt är okända.

"Vi överväger specifikt manipulationsuppgifter i högar av skräp som innehåller tidigare osynliga föremål, " skrev forskarna vid Rutgers University i sin uppsats. "En av de nya aspekterna av detta arbete är användningen av en fysikmotor för att verifiera antagna geometrier i simulering. Bevisen som tillhandahålls av fysiksimuleringar används i ett probabilistiskt ramverk som förklarar det faktum att objektens mekaniska egenskaper är osäkra."

Det integrerade systemet som utvecklats av forskarna har flera komponenter:en robotmanipulator, en segmenterings- och klustringsmodul, och en omvänd fysisk resonemangsenhet. Robotmanipulatorn är utformad för att trycka eller peta föremål i en hög med röran, medan segmenterings- och klustringsmodulen kan upptäcka objekt i RGB-D-bilder.

Till sist, den omvända fysiska resonemangsenheten, vilket är det utmärkande för deras tillvägagångssätt, sluter sig till saknade delar av objekt genom att spela upp robotens handlingar i simulering. Väsentligen, enheten använder flera hypotesformer och tilldelar högre sannolikheter till de som bäst matchar de observerade RGB-D-bilderna.

Forskarna utvecklade en algoritm för omvänd fysikresonemang (IPR) som kan sluta sig till ockluderade delar av objekt baserat på deras observerade rörelser och ömsesidiga interaktioner. Att träna och utvärdera sitt system, de använde två datamängder:en Voxlets-datauppsättning och en ny datauppsättning skapad med YCB benchmark-objekt. Voxlets dataset innehåller statiska bilder av bordsobjekt, medan den nya databasen som de sammanställt innehåller tätare högar av föremål.

Teamet utvärderade det nya tillvägagångssättet i en serie experiment med en Kuka robotarm monterad på en Clearpath mobil plattform och utrustad med en Robotiq hand- och djupavkännande kamera. I dessa tester, roboten presenterades för okända föremål i olika scenarier. Resultaten som samlats in av forskarna var mycket lovande, med deras IPR-algoritm härleder former bättre än andra tillvägagångssätt.

"Experiment med en robot visar att detta tillvägagångssätt är effektivt för att konstruera fysiskt realistiska 3D-modeller, vilket kan vara användbart för manipulationsplanering, ", skrev forskarna. "Experiment visar också att det föreslagna tillvägagångssättet avsevärt överträffar alternativa tillvägagångssätt när det gäller formnoggrannhet."

Det nya probabilistiska tillvägagångssättet som presenteras av forskarna kan bidra till att förbättra prestanda hos robotar i manipulationsuppgifter. I deras framtida arbete, de planerar att utveckla sitt tillvägagångssätt ytterligare, så att den kan sluta sig till 3D och mekaniska modeller samtidigt.

© 2019 Science X Network