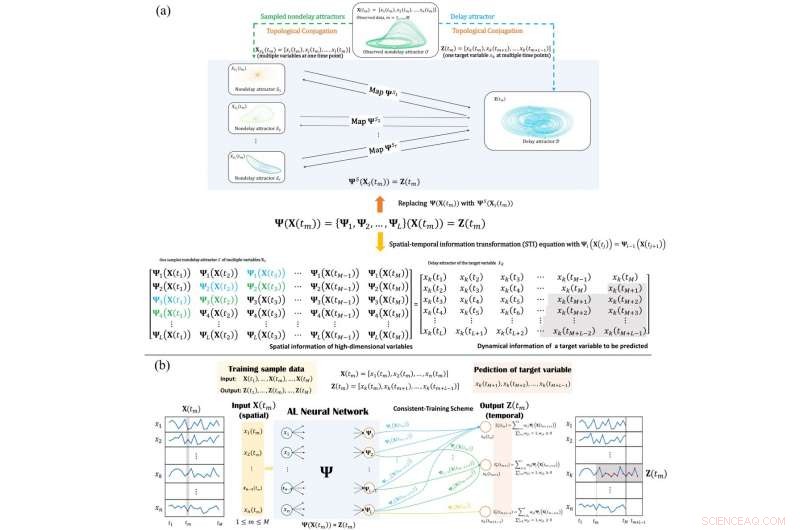

(a) Den allmänna principen för Anticipated Learning Machine (ALM). Den observerade attraktionen, en fördröjningsattraktor och samplade icke-fördröjningsattraktorer är alla topologiskt konjugerade med varandra. Varje samplade icke-fördröjningsattraktor bevarar den dynamiska informationen i systemet på olika sätt. Genom att integrera informationen i dessa samplade icke-fördröjningsattraktorer, vi kunde hitta en exakt en-till-en-karta även under brusförsämring.(b) Förväntad inlärningsmaskin. För varje framtida värde, dessa kartor tränas till en enhetlig karta Ψ. När kartorna är tränade, den viktade summan används som förutsägelse. Det förutsagda värdet används sedan som etiketten när andra kartor tränas för att förutsäga nästa tidpunkt. Klart, ALM Ψ omvandlar rumslig ingång X(tm) till tidsutgång Z(tm) vid varje punkt tm. Kredit:©Science China Press

Att göra en korrekt förutsägelse baserat på observerade data, särskilt från kortsiktiga tidsserier, är av stor oro inom olika discipliner – från molekylärbiologi, neurovetenskap, geovetenskap, och ekonomi till atmosfäriska vetenskaper - på grund av antingen datatillgänglighet eller tidsvarierande icke-stationaritet. Dock, de flesta av befintliga metoder kräver tillräckligt långa mätningar av tidsserier eller ett stort antal prover, och det finns ingen effektiv metod tillgänglig för förutsägelse med kortsiktiga tidsserier på grund av brist på information.

För att lösa detta problem, Prof. Chen Luonan (Institutet för biokemi och cellbiologi, Chinese Academy of Sciences) med Dr. Chen Chuan (Sun Yat-sen University), Prof. Ma Huanfei (Soochow University) och Prof. Aihara Kazuyuki (University of Tokyo) föreslog en ny dynamikbaserad datadriven metod, förväntad inlärningsmaskin (ALM), för att uppnå exakta framtida förutsägelser baserade på kortsiktiga men högdimensionella data. ALM är ett flerskiktigt neuralt nätverk där högdimensionella variabler tas som ingångsneuroner (flera variabler men vid en enda tidpunkt) men en målvariabel tas som utmatningsneuroner (enkel variabel men vid flera tidpunkter). På det här sättet, ALM kan omvandla den senaste korrelations/rumsliga informationen för högdimensionella variabler till framtida dynamisk/temporal information för vilken målvariabel som helst, dvs genom spatial-temporal information transformation transformation (STI) ekvationer.

Specifikt, ALM kan vara vältränad att representera den slumpmässigt fördelade inbäddningskartan (RDE) för STI-ekvationer av ett stort antal av de genererade träningsproverna med Dropout-schemat och det föreslagna konsekventa träningsschemat, på så sätt förutsäga målvariabeln på ett exakt och robust sätt, även från korttidsdata. Omfattande experiment med kortsiktiga högdimensionella data från både syntetiska och verkliga system visade betydligt bättre prestanda för ALM jämfört med befintliga metoder.

Jämfört med traditionella neurala nätverk (eller andra metoder för maskininlärning) som gräver fram den historiska statistiken för det ursprungliga högdimensionella systemet och därför kräver ett stort antal prover, ALM rekonstruerar effektivt och robust sin dynamik även med ett litet antal sampel genom att begränsa till ett lågdimensionellt utrymme som faktiskt är en inneboende egenskap hos ett sådant dissipativt system. Baserat på olinjär dynamik för att omvandla den rumsliga informationen för alla uppmätta högdimensionella variabler till den tidsmässiga utvecklingen av målvariabeln genom att lära sig STI-ekvationerna, ALM öppnar en ny väg för dynamikbaserad maskininlärning eller "intelligent" förväntad inlärning.

"Hur man överväger den starka olinjäriteten eller/och stokasticiteten hos de dynamiska systemen också med de observerade brusiga data, och vidare hur man gör en mer djupgående teoretisk analys och vidareutvecklar ett lämpligt ramverk som tar hänsyn till dessa frågor förblir ett öppet och intressant problem i framtiden, "uppger författarna.