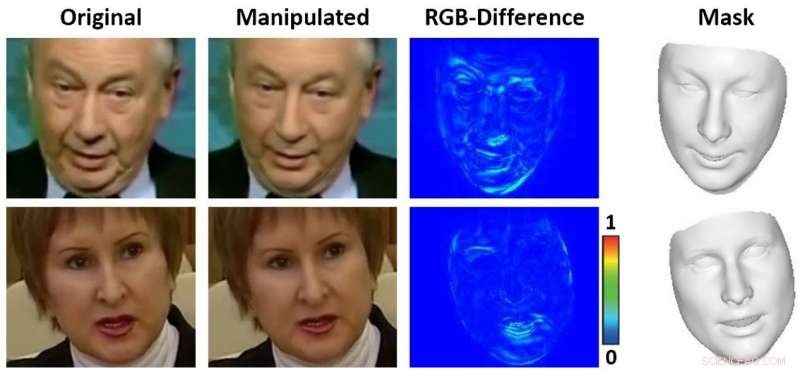

Falsk eller verklig? Exempel på FaceForensics datauppsättning för självåterställning. Från vänster till höger:originalinmatningsbild, självreaktiverad utmatningsbild, färgskillnadsdiagram och ansiktsmask som används under syntes av utdatabilden. Kredit:arXiv:1803.09179 [cs.CV]

Bildmanipulering i detta avancerade skede av den digitala tidsåldern är inte lika roligt utan ett dicey vapen, i skuggorna av falska nyheter, att sväva åsikter och gnista skandaler.

Byte av ansikte, särskilt, låter kul om du tänker på det som ett skratt vid ett familjebord medan barn och vuxna provar olika ansikten på olika människor. Dock, Det är också ett verktyg för mycket värre motiv. Swapna Krishna in Engadget påpekade att "människor har, självklart, utnyttjat detta verktyg för vissa störande användningsområden, inklusive ansiktsbyte av människor till pornografiska videor-den ultimata hämndpornen. "

I MIT Technology Review , "Emerging Technology from the arXiv" sa, "pornografiska videor som kallas" deepfakes "har dykt upp på webbplatser som visar kända individers ansikten överlagda på skådespelarkroppar."

Forskare, dock, intresserad av att utforska verktyget och hur man berättar om det används, har kommit på en algoritm, säga observatörer, som kan överträffa andra tillgängliga tekniker. De kom på ett sätt att upptäcka en ansiktsbyte via algoritmen, plockar upp förfalskade videor så snart de publiceras.

Analytics Vidhya kommenterade, "Något som liknar den här algoritmen krävdes desperat för att utkämpa kampen mot ansiktsbyten som används av fel skäl. Genom att publicera forskningsrapporten för allmänheten, forskarna hoppas att andra också tar upp stafettpinnen och arbetar med denna studie för att göra den mer exakt och exakt. "

Andreas Rossler var gruppledare för deltagarna från Münchens tekniska universitet, Universitetet Federico II i Neapel och universitetet i Erlangen-Nürnberg.

De tränade algoritmen, XceptionNet, med en stor uppsättning ansiktsbyten, sa Engadget .

"Vi sätter en stark baslinje av resultat för att upptäcka en ansiktsmanipulation med moderna djupinlärningsarkitekturer, "sa Rossler och team in MIT Technology Review . Storleken spelade roll.

Storleken på denna databas var en betydande förbättring jämfört med vad som tidigare varit tillgängligt. "Vi introducerar en ny datauppsättning med manipulerade videor som överskrider alla befintliga offentligt tillgängliga kriminaltekniska datamängder med storleksordningar, sa Rossler.

I deras papper, författarna sa att de introducerade en datasats för ansiktsmanipulation, FaceForensics, "av ungefär en halv miljon redigerade bilder (från över 1000 videor)."

Tidningen har titeln "FaceForensics:A Large-scale Video Dataset for Forgery Detection in Human Faces, "på arXiv. Författare är Andreas Rössler, Davide Cozzolino, Luisa Verdoliva, Christian Riess, Justus Thies och Matthias Nießner.

Författarna uppmärksammade svårigheten - för människor och datorer - att försöka skilja på original och manipulerad video, "särskilt när videorna är komprimerade eller har låg upplösning, som det ofta händer på sociala nätverk. "

De uppmärksammade också det faktum att "Forskning om upptäckt av ansiktsmanipulationer har allvarligt hämmats av bristen på tillräckliga datamängder."

Det finns en nyans i deras framgångar, fastän, som också förtjänar uppmärksamhet. Artikeln "Emerging Technology from the arXiv" kallade det "sticket i svansen". Vad är det? "Samma djupinlärningsteknik som kan upptäcka ansiktsbytesvideor kan också användas för att förbättra kvaliteten på ansiktsbyten i första hand-och det kan göra dem svårare att upptäcka."

Engadget på samma sätt sagt, "XceptionNet överträffar tydligt sina rivaliserande tekniker för att upptäcka denna typ av falsk video, men det förbättrar också kvaliteten på förfalskningarna. Rosslers team kan använda de största kännetecknen för en ansiktsbyte för att göra manipulationen mer sömlös. Det lurar inte XceptionNet, men i längden, Det kan göra det svårare för andra metoder att upptäcka falska videor. "

Pranav Dar, i Analytics Vidhya , vägde också in vad han kallade "en varning med denna algoritm - den kan också potentiellt användas för att förbättra kvaliteten på ansiktsbytena vilket kommer att göra det svårare att upptäcka falska. Dessutom kan så snart en förfalskningsdetekteringsalgoritm startas, bedragarna försöker alltid förfina sin modell för att ligga steget före. "

Ändå, författarna sa, "vår raffinör förbättrar främst den visuella kvaliteten, men det begränsar bara förfalskningsdetektering för djupinlärningsmetod som tränas exakt på förfalskade utdata. "

© 2018 Tech Xplore