Basketspelarna Darren Collision (vänster) och Gordon Hayward (höger). Kredit:basketball-reference.com

Tekniken för ansiktsigenkänning har utvecklats till en punkt där den nu tolkar känslor i ansiktsuttryck. Denna typ av analys används allt mer i det dagliga livet. Till exempel, företag kan använda mjukvara för ansiktsigenkänning för att hjälpa till med anställningsbeslut. Andra program skannar ansiktena i folkmassor för att identifiera hot mot allmän säkerhet.

Tyvärr, denna teknik kämpar för att tolka känslorna hos svarta ansikten. Min nya studie, publicerades förra månaden, visar att emotionell analysteknik tilldelar svarta mäns ansikten fler negativa känslor än vita mäns ansikten.

Det här är inte första gången som ansiktsigenkänningsprogram har visat sig vara partiska. Google stämplade svarta ansikten som gorillor. Kameror identifierade asiatiska ansikten som blinkande. Ansiktsigenkänningsprogram kämpade för att korrekt identifiera kön för personer med mörkare hud.

Mitt arbete bidrar till en växande uppmaning att bättre förstå den dolda fördomen i programvara med artificiell intelligens.

Mätning av bias

Att undersöka partiskheten i ansiktsigenkänningssystem som analyserar människors känslor, Jag använde en datauppsättning med 400 NBA-spelarbilder från säsongen 2016 till 2017, eftersom spelare är lika i sina kläder, atleticism, ålder och kön. Också, eftersom dessa är professionella porträtt, spelarna tittar på kameran på bilden.

Jag körde bilderna genom två välkända typer av mjukvara för emotionell igenkänning. Båda tilldelade svarta spelare mer negativa känslomässiga poäng i genomsnitt, hur mycket de än log.

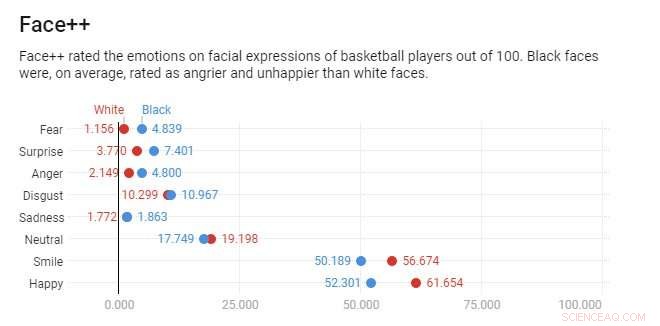

Kredit:Diagram:The Conversation, CC-BY-ND Källa:SSRN (2018)

Till exempel, tänk på de officiella NBA-bilderna på Darren Collison och Gordon Hayward. Båda spelarna ler, och, enligt ansiktsigenkännings- och analysprogrammet Face++, Darren Collison och Gordon Hayward har liknande leendepoäng – 48,7 och 48,1 av 100, respektive.

Dock, Face++ betygsätter Haywards uttryck som 59,7 procent glad och 0,13 procent arg och Collisons uttryck som 39,2 procent glad och 27 procent arg. Collison ses som nästan lika arg som han är glad och mycket argare än Hayward – trots att ansiktsigenkänningsprogrammet själv inser att båda spelarna ler.

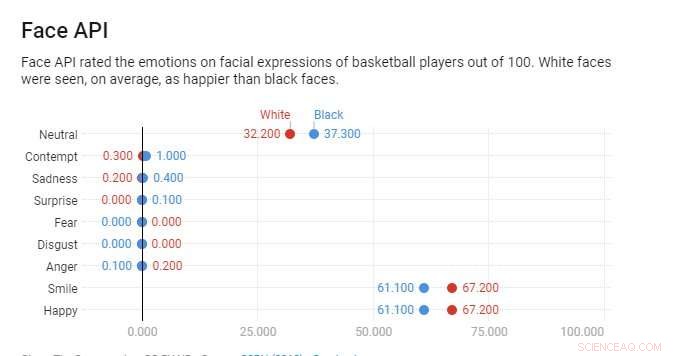

I kontrast, Microsofts Face API såg båda männen som glada. Fortfarande, Collison ses som mindre lycklig än Hayward, med 98 och 93 procent glädjepoäng, respektive. Trots hans leende, Collison får till och med ett litet förakt, medan Hayward inte har någon.

Över alla NBA-bilder, samma mönster framträder. I genomsnitt, Face++ betygsätter svarta ansikten som dubbelt så arga som vita ansikten. Face API bedömer svarta ansikten som tre gånger mer föraktfulla än vita ansikten. Efter att ha matchat spelare baserat på deras leenden, båda ansiktsanalysprogrammen är fortfarande mer benägna att tilldela svarta ansikten negativa känslor av ilska eller förakt.

Stereotypad av AI

Min studie visar att ansiktsigenkänningsprogram uppvisar två distinkta typer av fördomar.

Kredit:Diagram:The Conversation, CC-BY-ND Källa:SSRN (2018)

Först, svarta ansikten bedömdes konsekvent som argare än vita ansikten för varje leende. Face++ visade denna typ av partiskhet. Andra, svarta ansikten bedömdes alltid som argare om det fanns någon tvetydighet om deras ansiktsuttryck. Face API visade denna typ av skillnad. Även om svarta ansikten delvis ler, min analys visade att systemen antog mer negativa känslor jämfört med sina vita motsvarigheter med liknande uttryck. De genomsnittliga känslomässiga poängen var mycket närmare över loppen, men det fanns fortfarande märkbara skillnader för svarta och vita ansikten.

Denna observation överensstämmer med annan forskning, vilket tyder på att svarta yrkesverksamma måste förstärka positiva känslor för att få jämställdhet i sina prestationsutvärderingar på arbetsplatsen. Studier visar att människor uppfattar svarta män som mer fysiskt hotande än vita män, även när de är lika stora.

Vissa forskare hävdar att ansiktsigenkänningsteknik är mer objektiv än människor. Men min studie tyder på att ansiktsigenkänning speglar samma fördomar som människor har. Svarta mäns ansiktsuttryck bedöms oftare med känslor förknippade med hotfulla beteenden än vita män, även när de ler. Det finns goda skäl att tro att användningen av ansiktsigenkänning skulle kunna formalisera redan existerande stereotyper till algoritmer, automatiskt bädda in dem i vardagen.

Tills ansiktsigenkänning bedömer svarta och vita ansikten på liknande sätt, svarta människor kan behöva överdriva sina positiva ansiktsuttryck – i huvudsak le mer – för att minska tvetydighet och potentiellt negativa tolkningar av tekniken.

Även om det är innovativt, artificiell intelligens kan utöva och förvärra befintlig maktdynamik, leder till olika inverkan mellan ras/etniska grupper. Viss samhällelig ansvarighet är nödvändig för att säkerställa rättvisa mot alla grupper eftersom ansiktsigenkänning, som de flesta artificiell intelligens, är ofta osynlig för de människor som påverkas mest av dess beslut.

Den här artikeln är återpublicerad från The Conversation under en Creative Commons-licens. Läs originalartikeln.