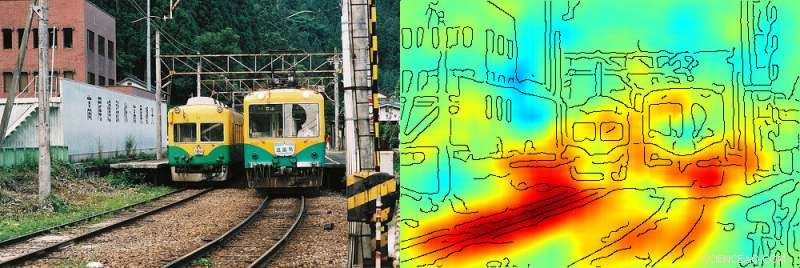

Här klassificerar AI -systemet en bild som ett tåg eftersom spår finns. Kredit:Fraunhofer HHI

Artificiell intelligens (AI) är redan fast inbäddad i våra vardagliga liv och erövrar allt mer territorium. Till exempel, röstassistenter är redan en vardagsartikel i många människors smartphones, bilar och hem. Framsteg inom AI-området baseras främst på användningen av neurala nätverk. Efterliknar funktionaliteten hos den mänskliga hjärnan, neurala nätverk länkar matematiskt definierade enheter med varandra. Men tidigare var det inte känt hur ett neuralt nätverk fattar beslut. Forskare vid Fraunhofer Institute for Telecommunications, Heinrich Hertz-institutet, HHI och Technische Universität Berlin har utvecklat en teknik som avslöjar de kriterier som AI-system använder när de fattar beslut. Den innovativa metoden Spectral Relevance Analysis (SpRAy) baserad på Layer-wise Relevance Propagation-teknologi ger en första titt in i den "svarta lådan".

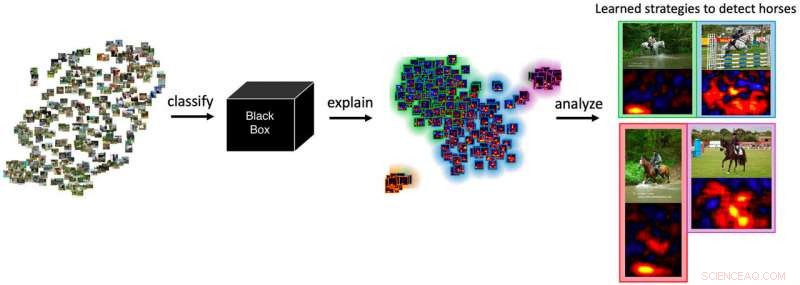

Idag är det nästan omöjligt att hitta ett område där artificiell intelligens är irrelevant, oavsett om det gäller tillverkning, reklam eller kommunikation. Många företag använder lärande och nätverksanslutna AI-system, till exempel för att generera exakta efterfrågeprognoser och för att exakt förutsäga kundbeteende. Detta tillvägagångssätt kan också användas för att anpassa regionala logistikprocesser. Sjukvården använder också specifika AI-aktiviteter, såsom prognosgenerering på basis av strukturerade data. Detta spelar en roll till exempel vid bildigenkänning:röntgenbilder matas in i ett AI-system som sedan matar ut en diagnos. Korrekt detektering av bildinnehåll är också avgörande för autonom körning, där trafikskyltar, träd, fotgängare och cyklister måste identifieras med fullständig noggrannhet. Och detta är kärnan i saken:AI-system måste tillhandahålla absolut tillförlitliga problemlösningsstrategier i känsliga applikationsområden som medicinsk diagnostik och i säkerhetskritiska områden. Dock, tidigare har det inte varit helt klart hur AI-system fattar beslut. Vidare, förutsägelserna beror på kvaliteten på indata. Forskare vid Fraunhofer Institute for Telecommunications, Heinrich Hertz-institutet, HHI och Technische Universität Berlin har nu utvecklat en teknik, Lagervis relevansförökning (LRP), vilket gör AI-prognoserna förklarliga och på så sätt avslöjar opålitliga problemlösningsstrategier. En vidareutveckling av LRP-teknik, kallad Spectral Relevance Analysis (SpRAy), identifierar och kvantifierar ett brett spektrum av inlärda beslutsbeteenden och identifierar därmed oönskade beslut även i enorma datamängder.

Genomskinlig AI

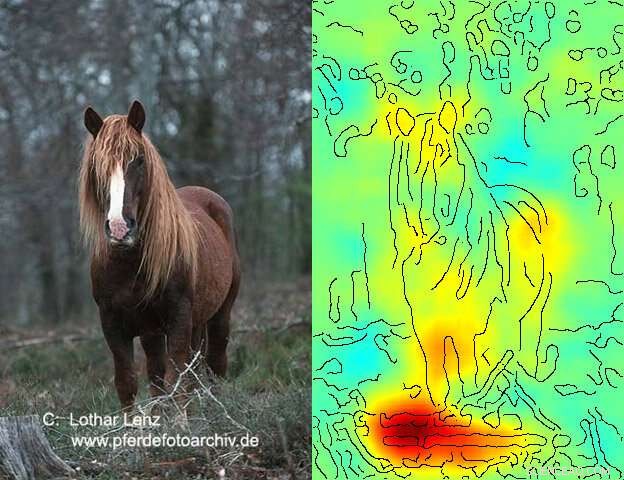

Här allokerar AI-systemet bilden till rätt kategori baserat på copyright-bannern. Ändå, lösningsstrategin är defekt. Kredit:Fraunhofer HHI

I praktiken identifierar tekniken de individuella ingångselement som har använts för att göra en förutsägelse. Så till exempel när en bild av ett vävnadsprov matas in i ett AI-system, påverkan av varje enskild pixel kvantifieras i klassificeringsresultaten. Med andra ord, samt att förutsäga hur "malign" eller "godartad" den avbildade vävnaden är, systemet ger också information om grunden för denna klassificering. "Inte bara ska resultatet vara korrekt, lösningsstrategin är också. Förr, AI-system har behandlats som svarta lådor. Man litade på systemen för att göra rätt saker. Med vår programvara med öppen källkod, som använder Layer-Wise Relevance Propagation, vi har lyckats göra lösningssökningsprocessen för AI-system transparent, " säger Dr Wojciech Samek, chef för forskargruppen "Machine Learning" vid Fraunhofer HHI. "Vi använder LRP för att visualisera och tolka neurala nätverk och andra maskininlärningsmodeller. Vi använder LRP för att mäta påverkan av varje indatavariabel i den övergripande förutsägelsen och analysera de beslut som klassificerarna har fattat, " tillägger Dr. Klaus-Rob-ert Müller, Professor för maskininlärning vid TU Berlin.

Otillförlitliga lösningsstrategier

Att lita på resultaten av neurala nätverk innebär nödvändigtvis att förstå hur de fungerar. Enligt forskargruppens tester, AI-system tillämpar inte alltid de bästa strategierna för att nå en lösning. Till exempel, ett välkänt AI-system klassificerar bilder baserat på sammanhang. Den tilldelade fotografier till kategorin "Skepp" när en stor mängd vatten var synlig i bilden. Det löste inte själva uppgiften att känna igen bilder av fartyg, även om den i de flesta fall valde ut rätt bilder. "Många AI-algoritmer använder opålitliga strategier och kommer fram till mycket opraktiska lösningar, säger Samek, sammanfattar resultaten av undersökningarna.

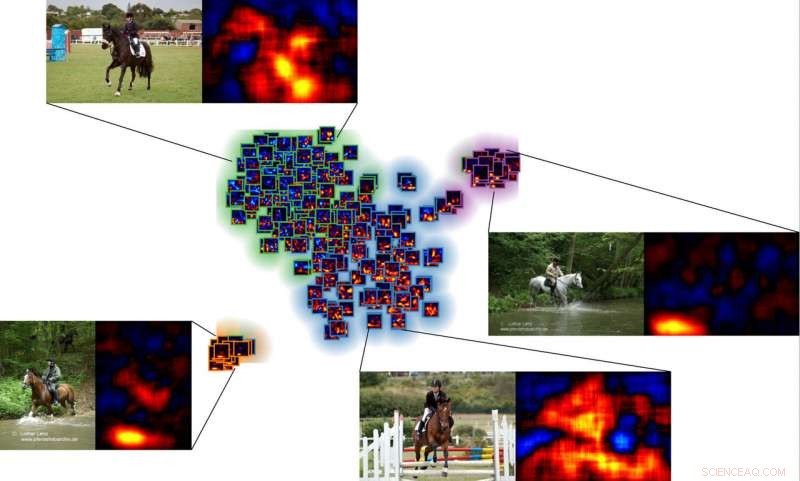

Den nya spektralmässiga relevansanalystekniken gör synliga kriterier som används av AI-system när de fattar beslut. Kredit:Fraunhofer HHI

Titta på neurala nätverk tänka

LRP-tekniken avkodar funktionaliteten hos neurala nätverk och tar reda på vilka karakteristiska egenskaper som används, till exempel att identifiera en häst som en häst och inte som en åsna eller en ko. Den identifierar informationen som flödar genom systemet vid varje nod i nätverket. Detta gör det möjligt att undersöka även mycket djupa neurala nätverk.

Fraunhofer HHI och TU Berlins forskarteam formulerar för närvarande nya algoritmer för utredning av ytterligare frågor för att göra AI-system ännu mer tillförlitliga och robusta. Projektpartnerna har publicerat sina forskningsresultat i tidskriften Naturkommunikation .

Lagermässig relevansförökning ger en titt inuti den "svarta lådan". Kredit:Fraunhofer HHI

AI, maskininlärning och mer

Artificiell intelligens handlar om utvecklingen av system som självständigt kan lösa problem och agera analogt med mänskliga tanke- och beteendemönster. För närvarande görs de största framstegen när det gäller maskininlärning, ett underområde till AI. Maskininlärning handlar om metoder för att extrahera kunskap från data och självständigt lärande sammanhang som finns i datan. Framstegen är ett resultat av att man använder artificiella neurala nätverk baserade på kopplingar mellan matematiska beräkningsenheter som i princip imiterar den mänskliga hjärnans neurala struktur. Ett underområde av maskininlärning, Djup lärning, täcker en klass av nya procedurer som gör det möjligt att lära ut och träna komplexa artificiella neurala nätverk. Dessa nätverk består av ett stort antal nivåer som är sammanlänkade med varandra i mångskiktade strukturer.