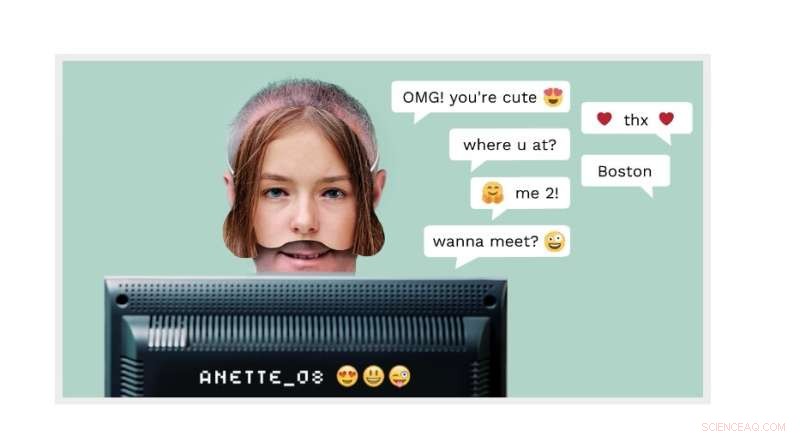

Cybervård:En vuxen man kan låtsas vara en 14-årig pojke online. Nu kan NTNUs upptäcktsteknik som används vid en kommersiell spin-off kallad AiBA upptäcka gärningsmannen. Kredit:AiBAs hemsida

Miljontals barn loggar in på chattrum varje dag för att prata med andra barn. Ett av dessa "barn" kan mycket väl vara en man som låtsas vara en 12-årig flicka med mycket mer olycksbådande avsikter än att ha en pratstund om "My Little Pony"-avsnitt.

Uppfinnaren och NTNU-professorn Patrick Bours vid AiBA arbetar för att förhindra just denna typ av rovbeteende. AiBA, en AI-digital moderator som Bours hjälpt till att hitta, kan erbjuda ett verktyg baserat på beteendebiometri och algoritmer som upptäcker sexuella övergrepp i onlinechattar med barn.

Och nu, som nyligen rapporterats av Dagens Næringsliv, en nationell finanstidning, har företaget tagit in kapital på 7,5 norska kronor. miljoner, med investerare inklusive Firda och Wiski Capital, två norskbaserade företag.

I sina senaste insatser arbetar företaget med 50 miljoner chattlinjer för att utveckla ett verktyg som ska hitta högriskkonversationer där missbrukare försöker komma i kontakt med barn. Målet är att identifiera särdrag i vad missbrukare lämnar efter sig på spelplattformar och i sociala medier.

"Vi riktar oss mot de stora spelproducenterna och hoppas få några hundra spel på plattformen", säger Hege Tokerud, medgrundare och general manager, till Dagens Næringsliv.

Cybervård ett växande problem

Cybergrooming är när vuxna blir vänner på nätet, ofta med hjälp av en falsk profil.

Men "en del sexuella rovdjur kommer bara ut och frågar om barnet är intresserad av att chatta med en äldre person, så det finns inget behov av en falsk identitet," sa Bours.

Gärningsmannens syfte är ofta att locka barnen till en privat kanal så att barnen kan skicka bilder på sig själva, med och utan kläder, och kanske så småningom ordna med att träffa den unge.

Gärningsmännen bryr sig inte lika mycket om att skicka bilder på sig själva, sa Bours. "Exhibitionism är bara en liten del av deras motivation," sa han. "Att få bilder är mycket mer intressant för dem, och inte bara stillbilder, utan livebilder via en webbkamera."

"Att övervaka alla dessa konversationer för att förhindra missbruk från att inträffa är omöjligt för moderatorer som övervakar systemet manuellt. Det som behövs är automatisering som meddelar moderatorer om pågående konversation", säger Bours.

AiBA har utvecklat ett system som använder flera algoritmer som erbjuder stora chattföretag ett verktyg som kan urskilja om vuxna eller barn chattar. Det är här beteendebiometri kommer in.

En vuxen man kan låtsas vara en 14-årig pojke på nätet. Men sättet han skriver på – till exempel hans skrivrytm eller hans val av ord – kan avslöja att han är en vuxen man.

Maskininlärningsnyckel

AiBA-verktyget använder maskininlärningsmetoder för att analysera alla chattar och bedöma risken utifrån vissa kriterier. Risknivån kan gå upp och ner lite under samtalet när systemet bedömer varje meddelande. Den röda varningssymbolen tänder chatten om risknivån blir för hög, vilket meddelar moderatorn som sedan kan titta på konversationen och bedöma den vidare.

På så sätt kan algoritmerna upptäcka konversationer som bör kontrolleras medan de pågår, snarare än efteråt när skadan eller missbruket redan kan ha inträffat. Algoritmerna fungerar alltså som en varningssignal.

Kallt och cyniskt

Bours analyserade mängder av chattkonversationer från gamla loggar för att utveckla algoritmen.

"Genom att analysera de här samtalen lär vi oss hur sådana män "sköter" mottagarna med komplimanger, presenter och annat smicker, så att de avslöjar mer och mer. Det är kallt, cyniskt och noggrant planerat, säger han. "Att granska chattar är också en del av inlärningsprocessen så att vi kan förbättra AI och få den att reagera bättre i framtiden."

"Risken för att den här typen av kontakt slutar med ett övergrepp är stor, speciellt om förövaren skickar mottagaren till andra plattformar med video, till exempel. I en livesituation skulle algoritmen markera den här chatten som en som måste övervakas ."

Analys i realtid

"Syftet är att avslöja en förövare så snabbt som möjligt", säger Bours.

"Om vi väntar på att hela samtalet ska avslutas, och chattarna redan har gjort överenskommelser, kan det vara för sent. Monitorn kan också berätta för barnet i chatten att de pratar med en vuxen och inte ett annat barn."

AiBA har samarbetat med spelbolag för att installera algoritmen och arbetar med en dansk spel- och chattplattform som heter MoviestarPlanet, som riktar sig till barn och har 100 miljoner spelare.

Vid utvecklingen av algoritmerna fann forskaren att användare skriver olika på olika plattformar som Snapchat och TikTok.

"Vi måste ta hänsyn till dessa distinktioner när vi tränar algoritmen. Samma sak med språk. Tjänsten måste utvecklas för alla typer av språk", säger Bours.

Titta på chattmönster

Senast har Bours och hans kollegor tittat på chattmönster för att se vilka mönster som avviker från vad som skulle anses vara normalt.

"Vi har analyserat chattmönstren – istället för texter – från 2,5 miljoner chattar och har kunnat hitta flera fall av grooming som inte skulle ha upptäckts annars," sa Bours.

"Denna inledande forskning tittade på data i efterhand, men för närvarande undersöker vi hur vi kan använda detta i ett system som följer sådana chattmönster direkt och kan fatta omedelbara beslut att rapportera en användare till en moderator", sa han. + Utforska vidare