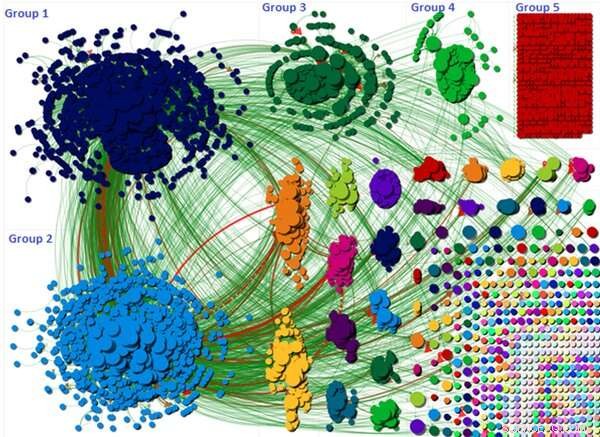

Diagrammet visar hur konspirationsteoridiskussionen bröts upp i olika grupper. Kredit:Wasim Ahmed, Författare tillhandahålls

Det är en allmän uppfattning att sociala mediers konspirationsteorier drivs av skadliga och anonyma "botar" som skapats av skumma tredje parter. Men min nya forskning – som undersökte en extremt framgångsrik COVID-19-konspirationsteori – har visat att vanliga medborgarkonton kan vara lika skyldiga när det gäller att sprida farliga lögner och desinformation.

Pandemin har lett till minst tio konspirationsteorier i år. Vissa kopplade spridningen av sjukdomen till 5G-nätverket, leder till att telefonmaster vandaliserades. Andra hävdade att COVID-19 var ett biologiskt vapen. Forskning har visat att konspirationsteorier kan bidra till att människor ignorerar regler för social distansering.

#FilmYourHospital-rörelsen var en sådan teori. Det uppmuntrade människor att spela in videor av sig själva i till synes tomma, eller mindre än trångt, sjukhus för att bevisa att pandemin är en bluff. Många videor som visar tomma korridorer och avdelningar delades.

Vår forskning försökte identifiera drivkrafterna bakom konspirationen och undersöka om kontona som drev den i april 2020 var bots eller riktiga människor.

Omfattningen av konspirationen

5G-konspirationen lockade 6, 556 Twitter-användare under en enda vecka. De #FilmDittSjukhus konspirationen var mycket större än 5G, med totalt 22, 785 tweets skickade under en sjudagarsperiod av 11, 333 användare. Den hade också stark internationell uppbackning.

Visualiseringen ovan visar varje Twitter-användare som en liten cirkel och den övergripande diskussionen är samlad i ett antal olika grupper. Dessa grupper bildas baserat på hur användare nämnde och återtweetade varandra.

Visualiseringen belyser hur de tre största grupperna var ansvariga för att sprida konspirationen längst. Till exempel, diskussionen i grupp ett och två var centrerad kring en enskild tweet som var mycket omtwittad. Tweeten antydde att allmänheten blev vilseledd och att sjukhusen inte var upptagna eller överkörda – vilket hade rapporterats av mainstreammedia. Tweeten bad sedan andra användare att filma sina sjukhus med hashtaggen så att det kunde bli ett trendämne. Grafiken visar räckvidden och storleken för dessa grupper.

Var är botarna?

Vi använde Botometer för att upptäcka bots som bygger på en maskininlärningsalgoritm. Verktyget beräknar en poäng där låga poäng indikerar mänskligt beteende och en hög poäng indikerar en bot. Botometer fungerar genom att extrahera olika funktioner från ett konto som dess profil, vänner, socialt nätverk, mönster i temporal aktivitet, språk och känslor. Vår studie tog ett 10 % systematiskt representativt urval av användare att köra genom Botometer.

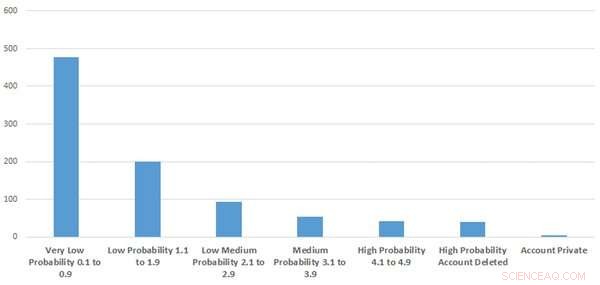

Figuren visar hur många av kontona som var misstänkta eller botliknande. Kredit:Wasim Ahmed, Författare tillhandahålls

Våra resultat visade att frekvensen av automatiserade konton sannolikt var låg. Vi använde råpoängen från Botometer för att bifoga en sannolikhetsetikett på om kontot sannolikt var en bot. Dessa varierade från mycket låga, låg, låg-medel och hög sannolikhet.

I bästa fall, endast 9,2 % av provet som vi tittade på liknade mycket misstänkt kontobeteende eller bots. Det betyder att över 90 % av konton vi granskade förmodligen var äkta.

Intressant, vi fann också att borttagna konton och automatiserade konton innehöll sökord som "Trump" och "Make America Great Again" i deras användarbios. Ungefär samtidigt hade president Donald Trump varit oense med vetenskapliga rådgivare om när man skulle häva låsningsreglerna.

Var kom det ifrån?

När vi undersökte de mest inflytelserika användarna kopplade till hashtaggen fann vi att konspirationsteorin drevs av inflytelserika konservativa politiker såväl som högerextrema politiska aktivister. Forskare har noterat hur extremhögern har utnyttjat pandemin. Till exempel, några av har satt upp kanaler på Telegram, en molnbaserad snabbmeddelandetjänst, för att diskutera covid-19 och ha förstärkt desinformation.

Men när konspirationsteorin väl började väcka uppmärksamhet stöddes den av vanliga medborgare. Kampanjen verkade också stödjas och drivas av pro-Trump Twitter-konton och vår forskning fann att vissa konton som betedde sig som "bots" och borttagna konton tenderade att vara pro-Trump. Det är viktigt att notera att inte alla konton som beter sig som bots är bots, eftersom det kan finnas användare som är mycket aktiva som kan få en hög poäng. Och, omvänt, inte alla botar är skadliga eftersom vissa har konfigurerats för legitima ändamål.

Twitter-användare delade ofta YouTube-videor till stöd för teorin och YouTube var en inflytelserik källa.

Kan de stoppas?

Sociala medieorganisationer kan övervaka för misstänkta konton och innehåll och om de bryter mot användarvillkoren, innehållet bör tas bort snabbt. Twitter experimenterade med att fästa varningsetiketter på tweets. Detta misslyckades till en början eftersom Twitter av misstag märkt några tweets fel, vilket oavsiktligt kan ha drivit konspirationer ytterligare. Men om de lyckas sätta ihop en bättre märkningsteknik kan detta vara en effektiv metod.

Konspirationer kan också motverkas genom att tillhandahålla pålitlig information, levereras från folkhälsomyndigheter samt populärkultur "influencers". Till exempel, Oldham City Council i Storbritannien, tog hjälp av skådespelaren James Buckley – känd för sin roll som Jay i E4 sitcom The Inbetweeners – för att sprida folkhälsobudskap.

Och annan forskning visar att förklarande av felaktiga argument och beskrivning av vetenskaplig konsensus kan bidra till att minska effekten av desinformation. Tyvärr, oavsett vilka procedurer och steg som införs, det kommer alltid att finnas människor som kommer att tro på konspirationer. Det måste ligga på plattformarna för att se till att dessa teorier inte sprids så lätt.

Den här artikeln är återpublicerad från The Conversation under en Creative Commons-licens. Läs originalartikeln.